Les logiciels et la technologie peuvent traiter de grandes quantités de données instantanément, ce qui les rend très attrayants pour une utilisation gouvernementale. Crédit :Shutterstock

En 2019, l'ancien rapporteur spécial de l'ONU, Philip Alston, a déclaré qu'il craignait que nous "trébuchions comme des zombies dans une dystopie du bien-être numérique". Il avait étudié comment les agences gouvernementales du monde entier se tournaient vers les systèmes automatisés de prise de décision (ADS) pour réduire les coûts, augmenter l'efficacité et cibler les ressources. Les ADS sont des systèmes techniques conçus pour aider ou remplacer la prise de décision humaine à l'aide d'algorithmes.

Alston était inquiet pour une bonne raison. La recherche montre que l'ADS peut être utilisé de manière à discriminer, exacerber les inégalités, enfreindre les droits, répartir les gens en différents groupes sociaux, limiter à tort l'accès aux services et intensifier la surveillance.

Par exemple, des familles ont été mises en faillite et contraintes à des crises après avoir été faussement accusées de fraude aux prestations.

Les chercheurs ont identifié comment les systèmes de reconnaissance faciale et les outils d'évaluation des risques sont plus susceptibles d'identifier à tort les personnes à la peau plus foncée et les femmes. Ces systèmes ont déjà conduit à des arrestations injustifiées et à des décisions de condamnation mal informées.

Souvent, les gens n'apprennent qu'ils ont été touchés par une application ADS que lorsque l'une des deux choses suivantes se produit :après que les choses tournent mal, comme ce fut le cas avec le scandale des A-levels au Royaume-Uni; ou lorsque des controverses sont rendues publiques, comme ce fut le cas avec les utilisations de la technologie de reconnaissance faciale au Canada et aux États-Unis.

Problèmes automatisés

Une plus grande transparence, responsabilité, responsabilisation et implication du public dans la conception et l'utilisation de l'ADS sont importantes pour protéger les droits et la vie privée des personnes. Il y a trois raisons principales à cela :

Notre dernier projet de recherche, Automatisation des services publics :apprendre des systèmes annulés , fournit des conclusions visant à aider à prévenir les dommages et à contribuer à un débat et à une action significatifs. Le rapport fournit le premier aperçu complet des systèmes annulés dans les démocraties occidentales.

La recherche des facteurs et des justifications conduisant à l'annulation des systèmes ADS nous aide à mieux comprendre leurs limites. Dans notre rapport, nous avons identifié 61 ADS annulés en Australie, au Canada, en Europe, en Nouvelle-Zélande et aux États-Unis. Nous présentons un compte rendu détaillé des systèmes annulés dans les domaines de la détection des fraudes, de la protection de l'enfance et de la police. Nos conclusions démontrent l'importance d'un examen attentif et d'un souci d'équité.

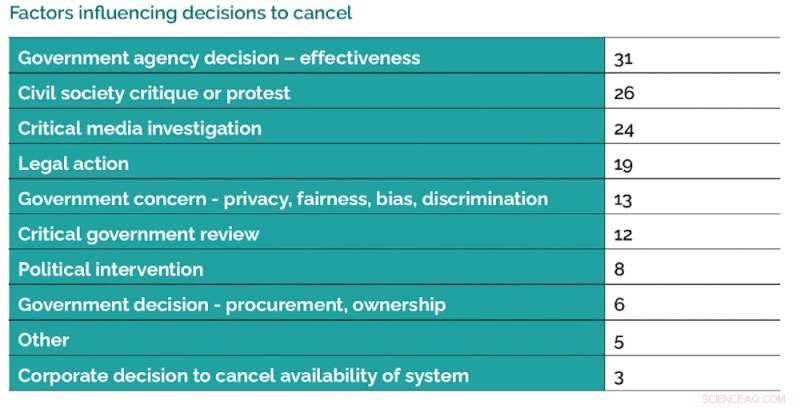

Il existe une série de facteurs qui influencent les décisions d'annuler les utilisations des systèmes ADS. Crédit :Data Justice Lab, fourni par l'auteur

Motifs d'annulation

Il existe une série de facteurs qui influencent les décisions d'annuler les utilisations de l'ADS. L'une de nos conclusions les plus importantes est la fréquence à laquelle les systèmes sont annulés parce qu'ils ne sont pas aussi efficaces que prévu. Une autre constatation clé est le rôle important joué par la mobilisation communautaire et la recherche, les reportages d'enquête et les poursuites judiciaires.

Nos résultats démontrent qu'il existe des compréhensions, des visions et des politiques concurrentes entourant l'utilisation de l'ADS.

Espérons que nos recommandations conduiront à une participation civique accrue et à une surveillance, une responsabilisation et une prévention des préjudices améliorées.

Dans le rapport, nous soulignons les appels généralisés aux gouvernements pour qu'ils établissent des registres ADS dotés de ressources comme première étape fondamentale vers une plus grande transparence. Certains pays, comme le Royaume-Uni, ont annoncé leur intention de le faire, tandis que d'autres pays comme le Canada n'ont pas encore pris cette direction.

Nos résultats démontrent que l'utilisation de l'ADS peut conduire à une plus grande inégalité et à une injustice systémique. Cela renforce la nécessité d'être attentif à la façon dont l'utilisation de l'ADS peut créer des systèmes différentiels d'avantages et de désavantages.

Responsabilité et transparence

Les ADS doivent être développés avec soin et responsabilité en s'engageant de manière significative avec les communautés affectées. Il peut y avoir des conséquences néfastes lorsque les agences gouvernementales n'engagent pas le public dans des discussions sur l'utilisation appropriée de l'ADS avant la mise en œuvre.

Cet engagement devrait inclure la possibilité pour les membres de la communauté de décider des domaines dans lesquels ils ne souhaitent pas que l'ADS soit utilisé. Des exemples de bonnes pratiques gouvernementales peuvent inclure le fait de prendre le temps de s'assurer que des examens d'experts indépendants et des évaluations d'impact axés sur l'égalité et les droits de l'homme sont effectués.

Les gouvernements peuvent adopter plusieurs approches différentes pour mettre en œuvre les systèmes ADS de manière plus responsable. Crédit :Data Justice Lab, fourni par l'auteur

Nous recommandons de renforcer la responsabilité de ceux qui souhaitent mettre en œuvre l'ADS en exigeant des preuves d'exactitude, d'efficacité et de sécurité, ainsi que des examens de la légalité. Au minimum, les gens devraient être en mesure de savoir si un ADS a utilisé leurs données et, si nécessaire, avoir accès à des ressources pour contester et corriger les évaluations erronées.

Il existe un certain nombre de cas répertoriés dans notre rapport où le partenariat des agences gouvernementales avec des entreprises privées pour fournir des services ADS a posé des problèmes. Dans un cas, un organisme gouvernemental a décidé de ne pas utiliser de système de mise en liberté sous caution parce que la nature exclusive du système signifiait que les accusés et les fonctionnaires ne seraient pas en mesure de comprendre pourquoi une décision avait été prise, rendant impossible une contestation efficace.

Les agences gouvernementales doivent disposer des ressources et des compétences nécessaires pour examiner en profondeur la manière dont elles se procurent les systèmes ADS.

Une politique de soins

Toutes ces recommandations soulignent l'importance d'une politique de soins. Cela exige que ceux qui souhaitent mettre en œuvre l'ADS apprécient les complexités des personnes, des communautés et de leurs droits.

Des questions clés doivent être posées sur la manière dont les utilisations de l'ADS conduisent à des angles morts en raison de la manière dont elles augmentent la distance entre les administrateurs et les personnes qu'ils sont censés servir grâce à des systèmes de notation et de tri qui simplifient à l'extrême, infèrent la culpabilité, ciblent à tort et stéréotypent les personnes. à travers des catégorisations et des quantifications.

Les bonnes pratiques, en termes de politique de soins, impliquent de prendre le temps d'examiner attentivement les impacts potentiels de l'ADS avant la mise en œuvre et de répondre aux critiques, d'assurer une surveillance et un examen continus et de rechercher un examen indépendant et communautaire.

Cet article est republié de The Conversation sous une licence Creative Commons. Lire l'article d'origine. La reconnaissance faciale, les caméras et d'autres outils utilisés par la police soulèvent des questions sur la responsabilité