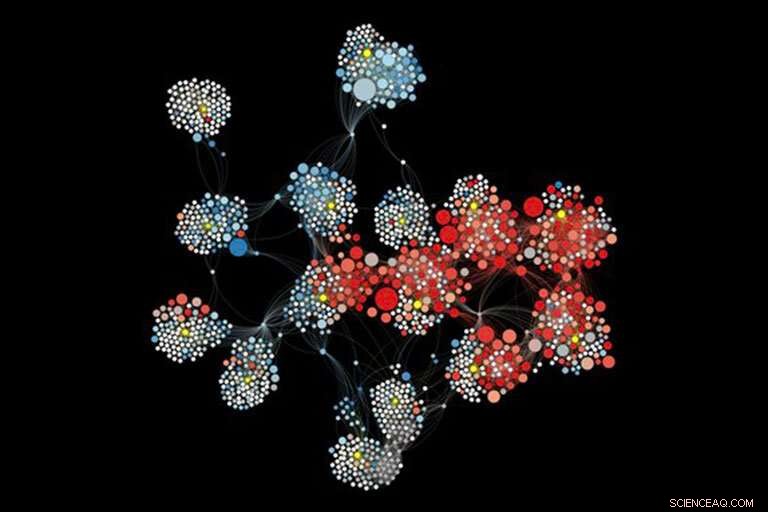

Bots "drifters" neutres, en jaune, et un échantillon de leurs amis et adeptes colorés selon l'alignement politique. Les gros nœuds sont des comptes partageant de nombreux liens peu crédibles. Crédit :Université de l'Indiana

En cette ère de polarisation politique, beaucoup accusent les plateformes de médias sociaux en ligne telles que Twitter de parti pris libéral, favoriser et amplifier intentionnellement le contenu et les utilisateurs libéraux tout en supprimant d'autres contenus politiques.

Mais une nouvelle étude de l'Université de l'Indiana révèle que ce n'est pas le cas. Les biais politiques, les chercheurs ont trouvé, découlent des interactions sociales de nos comptes - nous recevons un contenu étroitement aligné avec tout ce que nos amis en ligne produisent, surtout nos tout premiers amis en ligne. Aussi, les préjugés politiques sur Twitter favorisent les contenus conservateurs.

"Notre principale conclusion est que les informations que les utilisateurs de Twitter voient dans leur fil d'actualité dépendent de l'orientation politique de leurs premières connexions, ", a déclaré Filippo Menczer, co-auteur de l'étude. "Nous n'avons trouvé aucune preuve d'interférence intentionnelle de la part de la plate-forme. Au lieu, biais peut s'expliquer par l'utilisation, et d'abus, de la plateforme par ses utilisateurs."

L'étude, "Les robots neutres sondent les préjugés politiques sur les réseaux sociaux, " est publié en ligne dans la revue Communication Nature . Les auteurs sont une équipe de chercheurs de l'Observatoire des médias sociaux (OSoMe, prononcé génial) à IU Bloomington, dirigé par Menczer, qui est directeur d'OSoMe et professeur distingué Luddy d'informatique et d'informatique à la Luddy School of Informatics, L'informatique, et Ingénierie.

Pour découvrir les biais dans les nouvelles et les informations en ligne auxquels les gens sont exposés sur Twitter, les chercheurs ont déployé 15 bots, appelés « drifters » pour distinguer leur comportement neutre des autres types de robots sociaux sur Twitter. Les dériveurs imitaient les utilisateurs humains mais étaient contrôlés par des algorithmes qui les activaient au hasard pour effectuer des actions.

Après avoir initialisé chaque bot avec un premier ami d'une source d'actualités populaire alignée sur la gauche, centre-gauche, centre, centre-droit, ou à droite du spectre politique américain, les chercheurs ont lâché les vagabonds "dans la nature" sur Twitter.

L'équipe de recherche a collecté quotidiennement des données sur les dériveurs. Au bout de cinq mois, ils ont examiné le contenu consommé et généré par les dériveurs, analyser l'alignement politique des amis et adeptes des bots et leur exposition aux informations provenant de sources d'informations et d'informations peu crédibles.

La recherche a révélé que l'alignement politique d'un ami initial sur les médias sociaux a un impact majeur sur la structure du réseau social d'un utilisateur et son exposition à des sources peu crédibles.

« Les choix précoces concernant les sources à suivre ont un impact sur les expériences des utilisateurs des médias sociaux, " a déclaré Menczer.

L'étude a révélé que les vagabonds avaient tendance à être attirés par la droite politique. Les vagabonds avec des amis initiaux de droite ont été progressivement intégrés dans des réseaux homogènes où ils ont été exposés à un contenu plus à droite et à faible crédibilité. Ils ont même commencé à diffuser eux-mêmes du contenu de droite. Ils avaient également tendance à suivre des comptes plus automatisés.

Parce que les bouées dérivantes ont été conçues pour être neutres, le caractère partisan des contenus qu'ils ont consommés et produits reflète des biais dans « l'écosystème de l'information en ligne » créé par les interactions des utilisateurs, selon Menczer.

"L'influence en ligne est affectée par les caractéristiques de la chambre d'écho du réseau social, ", dit-il. " Les vagabonds qui suivent des sources d'information plus partisanes ont reçu plus d'adeptes politiquement s'encastrer dans des chambres d'écho plus denses."

Pour éviter de rester coincé dans les chambres d'écho en ligne, les utilisateurs doivent faire des efforts supplémentaires pour modérer les contenus qu'ils consomment et les liens sociaux qu'ils tissent, selon Diogo Pacheco, un ancien boursier postdoctoral au Center for Complex Networks and Systems Research à IU Bloomington et co-auteur de l'étude.

"Nous espérons que cette étude sensibilisera les utilisateurs des médias sociaux aux biais implicites de leurs connexions en ligne et à leur vulnérabilité à l'exposition à des informations sélectives, ou pire, telles que les campagnes d'influence, manipulation, désinformation, et polarisation, " a déclaré Pacheco. "Comment concevoir des mécanismes capables d'atténuer les biais dans les écosystèmes d'information en ligne est une question clé qui reste ouverte au débat."