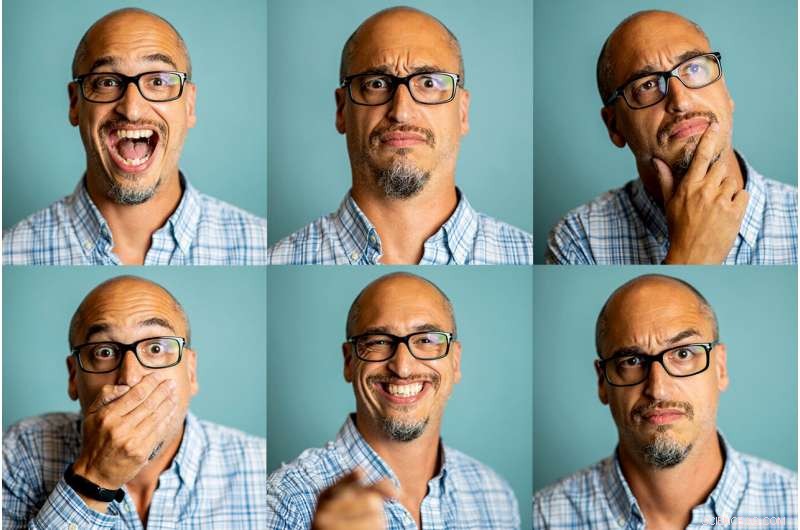

De nouvelles recherches menées par Lisa Feldman Barrett, neuroscientifiques du nord-est, montrent que l'interprétation de l'expression faciale d'une personne ne peut pas se faire dans le vide; ça dépend du contexte. Crédit :Matthew Modoono/Université Northeastern

Si vous voyiez une personne avec le front plissé, bouche baissée, et les yeux plissés, devineriez-vous qu'ils sont en colère ? Et si vous appreniez qu'ils avaient oublié leurs lunettes de lecture et déchiffraient un menu de restaurant ?

L'interprétation des mouvements du visage d'une personne ne peut se faire dans le vide; cela dépend du contexte - quelque chose que la neuroscientifique du nord-est Lisa Feldman Barrett montre dans une nouvelle étude révolutionnaire publiée jeudi dans la revue scientifique Communication Nature .

Barrett, un éminent professeur universitaire de psychologie à Northeastern, et des collègues de plusieurs autres institutions à travers le monde ont utilisé des photographies d'acteurs professionnels décrivant des scénarios richement construits pour montrer que les gens utilisent non seulement des mouvements faciaux différents pour communiquer différentes instances de la même catégorie d'émotion (quelqu'un peut renfrogner, froncer les sourcils, ou même rire quand ils représentent la colère), ils utilisent également des configurations faciales similaires pour communiquer une gamme d'instances de différentes catégories d'émotions (un air renfrogné peut parfois exprimer la concentration, par exemple) - des résultats qui ont de sérieuses implications pour la technologie de reconnaissance des émotions qui prétend « lire » les émotions sur le visage.

"L'implication de cette étude est qu'il y a beaucoup plus de variabilité dans la façon dont les gens expriment différents cas d'une catégorie d'émotion donnée. Et une configuration faciale peut exprimer des cas de colère, joie, ou d'autres catégories d'émotions, selon le contexte, " dit Barrett.

Les gens peuvent écarquiller les yeux parce qu'ils sont en colère ou parce qu'ils sont surpris, et le cerveau humain dépend du contexte pour résoudre ce puzzle.

Des études scientifiques antérieures sur les expressions émotionnelles se sont appuyées sur des personnes ordinaires ou des acteurs amateurs pour représenter un seul exemple de chaque catégorie d'émotion dans un contexte appauvri :« Votre cousin vient de mourir et vous vous sentez très triste. Quelle expression feriez-vous ? »

De tels rendus incitent les gens à s'appuyer sur des expressions stéréotypées d'émotion (froncer les sourcils de tristesse), plutôt que des expressions qui reflètent une vie émotionnelle plus riche, pleine de nuances et de variations situées, dit Barrett.

Alors pour leur étude, Barrett et ses co-auteurs ont utilisé des photographies d'acteurs professionnels - des personnes ayant une « expertise en matière d'émotion » parce que leur gagne-pain dépend de « leur représentation authentique d'expériences émotionnelles dans les films, télévision, et théâtre, " d'une manière qui diffuse des informations crédibles, écrivent les chercheurs.

Les acteurs ont reçu une description détaillée, scénario émouvant à jouer, puis photographié par Howard Schatz (qui a également créé les scénarios) pour deux volumes publiés :In Character :Actors Acting, et Pris en flagrant délit :Acteurs agissant.

Un exemple tiré des livres de Schatz :« C'est un mec à moto qui sort d'un bar de motards tout comme un gars dans une Porsche recule dans sa rutilante Harley, " selon le document des chercheurs.

"Ce qui est important, c'est que ces acteurs célèbres ont reçu un scénario sans mots d'émotion, " Barrett dit, ce qui élimine le lien immédiat que l'on pourrait faire entre, par exemple, le mot « triste » et l'expression du visage « froncer les sourcils ».

Les chercheurs ont utilisé 604 des 731 photographies des livres de Schatz, en éliminant uniquement celles dans lesquelles les poses faciales des acteurs ne pouvaient pas être analysées parce que leurs mains couvraient leurs visages ou parce que leurs têtes étaient extrêmement inclinées.

Ils ont utilisé ces photos et scénarios pour mener deux études. En premier, les chercheurs ont demandé à 839 volontaires de juger les seules significations émotionnelles des descriptions de scénarios. Chaque volontaire a évalué environ 30 scénarios, en utilisant une échelle de 1 à 4 pour indiquer dans quelle mesure l'une des 13 émotions a été évoquée dans la description :amusement, colère, admiration, mépris, dégoûter, embarras, peur, joie, l'intérêt, Orgueil, tristesse, la honte, et surprendre.

Ils ont utilisé la note médiane de chaque scénario pour le classer dans l'une de ces 13 catégories d'émotions. Les chercheurs ont également fait appel à trois experts pour coder les 604 photographies à l'aide du système de codage d'action faciale, qui spécifie un ensemble d'unités d'action qui représentent chacune le mouvement d'un ou plusieurs muscles faciaux.

Selon une hypothèse de longue date, certaines catégories d'émotions sont exprimées de manière cohérente et spécifique avec certains ensembles de mouvements du visage. Si tel était le cas, alors toutes les descriptions de scénarios classées comme évoquant des instances d'une catégorie d'émotion donnée devraient correspondre à des photographies qui dépeignent systématiquement un ensemble spécifique de mouvements du visage.

Ou, comme le dit Barrett, "Si les configurations faciales en question - renfrogné, souriant, renfrogné, et ainsi de suite - sont des expressions qui ont évolué pour communiquer des émotions spécifiques, vous devriez voir des acteurs célèbres poser des sourcils renfrognés lorsqu'ils représentent des exemples de colère et seulement de la colère, poser des sourcils lorsqu'il représente la tristesse, etc."

Les chercheurs ont effectué des analyses d'apprentissage automatique, qui a révélé que les acteurs représentaient des instances des mêmes catégories d'émotions en contorsionnant leurs visages de diverses manières. Aussi, des poses faciales similaires n'exprimaient pas de manière fiable la même catégorie émotionnelle.

Pour tester si les mouvements du visage, seul, porter toute information émotionnelle indépendante du contexte, les chercheurs ont demandé à deux autres groupes de volontaires de juger de la signification émotionnelle de chaque pose faciale, soit lorsqu'il est présenté seul ou avec son scénario correspondant.

Le premier groupe, 842 personnes, évalué à environ 30 visages chacun. Le deuxième groupe, 845 personnes, évalué environ 30 paires visage-scénario. Les deux groupes ont été invités à juger dans quelle mesure leurs visages ou paires visage-scénario appartenaient à chacune des 13 catégories d'émotions.

Si les mouvements du visage véhiculent des informations émotionnelles indépendantes du contexte, alors les évaluations des visages seuls auraient dû être très similaires aux évaluations des paires visage-scénario. Si le sens émotionnel des mouvements du visage vient avant tout du contexte auquel ils sont associés, alors les cotes initiales des scénarios seuls seraient plus similaires aux cotes des scénarios de face.

Les chercheurs ont découvert que les jugements des personnes sur les poses faciales à eux seuls ne correspondaient pas de manière fiable aux évaluations des visages lorsqu'ils étaient visualisés avec le scénario; ils ne correspondaient pas non plus à la catégorie d'émotion désignée du scénario. Les significations émotionnelles des poses faciales provenaient principalement des scénarios avec lesquels elles étaient associées, c'est à dire., le contexte.

« Les présents résultats rejoignent d'autres résumés récents des preuves empiriques pour suggérer que les regards renfrognés, sourires, et d'autres configurations faciales appartiennent à un plus grand, répertoire plus variable des manières significatives dont les gens bougent leur visage pour exprimer leurs émotions, " écrivent les chercheurs.

En d'autres termes, Barrett dit, "les gens déduisent le sens de ton sourire, et leurs inférences sont informées par le contexte. Lorsqu'il s'agit d'exprimer une émotion, un visage ne parle pas de lui-même."

Les découvertes des chercheurs ont des implications pour les types de systèmes artificiellement intelligents que certains ingénieurs prétendent être capables de déchiffrer l'émotion d'une personne en suivant uniquement les mouvements de son visage.

Les entreprises utilisent déjà des systèmes alimentés par l'IA pour évaluer les émotions des enfants au fur et à mesure qu'ils apprennent, porter des jugements sur les candidats potentiels à un emploi, et devinez les intentions néfastes potentielles d'un passager aérien.

"Notre recherche s'oppose directement à l'approche traditionnelle de l'IA émotionnelle, " dit Barrett. " Certaines entreprises prétendent avoir des algorithmes qui peuvent détecter la colère, par exemple, quand ce qu'ils ont vraiment, dans des circonstances optimales, ce sont des algorithmes qui peuvent probablement détecter la grimace, qui peut être ou non une expression de colère. Il est important de ne pas confondre la description d'une configuration faciale avec des inférences sur sa signification émotionnelle."