Dans les essais, un prototype de pipeline a augmenté la capacité de détection des manipulations d'environ 45 % à plus de 90 % sans sacrifier la qualité de l'image. Crédit :NYU Tandon

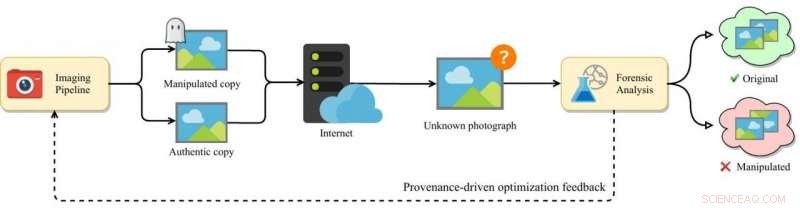

Pour contrecarrer les méthodes sophistiquées de modification des photos et des vidéos, des chercheurs de la NYU Tandon School of Engineering ont démontré une technique expérimentale pour authentifier les images tout au long du pipeline, de l'acquisition à la livraison, utilisant l'intelligence artificielle (IA).

Dans les essais, ce prototype de pipeline d'imagerie a augmenté les chances de détection de manipulation d'environ 45 % à plus de 90 % sans sacrifier la qualité de l'image.

Déterminer si une photo ou une vidéo est authentique devient de plus en plus problématique. Les techniques sophistiquées pour modifier les photos et les vidéos sont devenues si accessibles que les soi-disant « deep fakes » – des photos ou des vidéos manipulées qui sont remarquablement convaincantes et incluent souvent des célébrités ou des personnalités politiques – sont devenues monnaie courante.

Pawel Korus, professeur assistant de recherche au Département d'informatique et d'ingénierie de NYU Tandon, pionnier de cette approche. Il remplace le pipeline de développement photo typique par un réseau de neurones - une forme d'IA - qui introduit des artefacts soigneusement conçus directement dans l'image au moment de l'acquisition de l'image. Ces artefacts, semblable à des "filigranes numériques, " sont extrêmement sensibles à la manipulation.

"Contrairement aux techniques de filigrane précédemment utilisées, ces artefacts appris par l'IA peuvent révéler non seulement l'existence de manipulations de photos, mais aussi leur caractère, " dit Korus.

Le processus est optimisé pour l'intégration dans l'appareil photo et peut survivre à la distorsion d'image appliquée par les services de partage de photos en ligne.

Les avantages de l'intégration de tels systèmes dans les caméras sont clairs.

« Si la caméra elle-même produit une image plus sensible à la falsification, tout ajustement sera détecté avec une forte probabilité, " dit Nasir Memon, professeur d'informatique et d'ingénierie à NYU Tandon et co-auteur, avec Korus, d'un papier détaillant la technique. "Ces filigranes peuvent survivre au post-traitement ; cependant, ils sont assez fragiles en matière de modification :si vous modifiez l'image, le filigrane se brise, " dit Mémon.

La plupart des autres tentatives pour déterminer l'authenticité de l'image n'examinent que le produit final, une entreprise notoirement difficile.

Korus et Mémon, par contre, raisonné que l'imagerie numérique moderne repose déjà sur l'apprentissage automatique. Chaque photo prise sur un smartphone subit un traitement quasi instantané pour s'adapter à la faible luminosité et stabiliser les images, les deux ont lieu grâce à l'IA embarquée. Dans les années à venir, Les processus basés sur l'IA sont susceptibles de remplacer complètement les pipelines d'imagerie numérique traditionnels. Au fur et à mesure de cette transition, Memon a déclaré que « nous avons la possibilité de changer radicalement les capacités des appareils de nouvelle génération en ce qui concerne l'intégrité et l'authentification des images. Des pipelines d'imagerie optimisés pour la criminalistique pourraient aider à restaurer un élément de confiance dans les domaines où la frontière entre le vrai et le faux peut être difficile à dessiner avec confiance."

Korus et Memon notent que bien que leur approche soit prometteuse dans les tests, des travaux supplémentaires sont nécessaires pour affiner le système. Cette solution est open source et est accessible sur github.com/pkorus/neural-imaging.

Les chercheurs présenteront leur article, "Authentification de contenu pour les pipelines d'imagerie neuronale :optimisation de bout en bout de la provenance des photos dans les canaux de distribution complexes, " à la conférence sur la vision par ordinateur et la reconnaissance de formes à Long Beach, Californie, en juin.