Poursuites pour messages offensants. Crédit :Sur la base des chiffres obtenus du ministère de la Justice, Auteur fourni

Facebook a pour la première fois mis à disposition des données sur l'ampleur des commentaires abusifs postés sur son site. Cela a peut-être été fait sous la pression croissante des organisations pour que les sociétés de médias sociaux soient plus transparentes sur les abus en ligne, ou pour gagner en crédibilité après le scandale des données de Cambridge Analytica. Dans les deux cas, les chiffres ne rendent pas la lecture agréable.

Sur une période de six mois d'octobre 2017 à mars 20178, 21 millions d'images sexuellement explicites, 3,5 millions de messages graphiquement violents et 2,5 millions de formes de discours haineux ont été supprimés de son site. Ces chiffres permettent de révéler quelques points marquants.

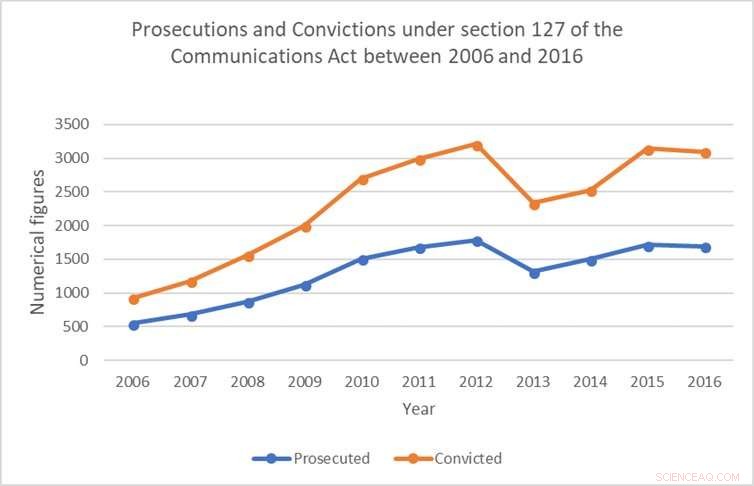

Comme prévu, les données indiquent que le problème s'aggrave. Par exemple, entre janvier et mars, on a estimé que pour 10, 000 messages en ligne, entre 22 et 27 contenaient de la violence graphique, de 16 à 19 au cours des trois mois précédents. Cela met en évidence le fait qu'au Royaume-Uni, les poursuites pour abus en ligne ont diminué, comme le montre le graphique ci-dessous.

Pourtant, ce que Facebook ne nous a pas dit est tout aussi important.

Le réseau social subit une pression croissante pour lutter contre les abus sur son site, en particulier, la suppression de la propagande terroriste après des événements tels que l'attentat de Westminster en 2017 et l'attentat à la bombe de Manchester Arena. Ici, l'entreprise a été proactive. Entre janvier et mars 2018, Facebook a supprimé 1,9 million de messages encourageant la propagande terroriste, une augmentation de 800, 000 commentaires par rapport aux trois mois précédents. Au total, 99,5 % de ces messages ont été localisés à l'aide de technologies avancées.

A première vue, il semble que Facebook ait développé avec succès un logiciel capable de supprimer ce contenu de son serveur. Mais Facebook n'a pas publié de chiffres montrant à quel point la propagande terroriste est répandue sur son site. Donc, nous ne savons vraiment pas à quel point le logiciel réussit à cet égard.

Supprimer les messages violents

Facebook a également utilisé la technologie pour faciliter la suppression de la violence graphique de son site. Entre les deux périodes de trois mois, il y a eu une augmentation de 183% du nombre de messages supprimés qui étaient étiquetés graphiquement violents. Au total, 86 % de ces commentaires ont été signalés par un système informatique.

Mais nous savons aussi que les chiffres de Facebook montrent également que jusqu'à 27 sur 10, Les milliers de commentaires qui ont dépassé la technologie de détection contenaient de la violence graphique. Cela ne semble pas être beaucoup, mais cela vaut la peine de considérer le nombre total de commentaires publiés sur le site par ses plus de 2 milliards d'utilisateurs actifs. Une estimation suggère que 510, 000 commentaires sont postés chaque minute. Si précis, cela signifierait 1, 982, 880 commentaires violents sont postés toutes les 24 heures.

Pour pallier les défaillances de son logiciel de détection, Facebook, comme les autres réseaux sociaux, s'est appuyé pendant des années sur l'autorégulation, les utilisateurs étant encouragés à signaler les commentaires qui, selon eux, ne devraient pas figurer sur le site. Par exemple, entre janvier et mars 2018, Facebook a supprimé 2,5 millions de commentaires considérés comme des discours de haine, pourtant seulement 950, 000 (38%) de ces messages avaient été signalés par son système. Les 62 % restants ont été signalés par les utilisateurs. Cela montre que la technologie de Facebook ne parvient pas à lutter adéquatement contre les discours de haine sur son réseau, malgré l'inquiétude croissante que les sites de réseaux sociaux alimentent les crimes haineux dans le monde réel.

Combien de commentaires sont signalés ?

Cela nous amène à l'autre chiffre significatif non inclus dans les données publiées par Facebook :le nombre total de commentaires signalés par les utilisateurs. Comme il s'agit d'un mécanisme fondamental pour lutter contre les abus en ligne, le nombre de rapports présentés à l'entreprise doit être rendu public. Cela nous permettra de comprendre toute l'étendue des commentaires abusifs faits en ligne, tout en précisant le nombre total de messages que Facebook ne supprime pas du site.

La décision de Facebook de publier des données révélant l'ampleur des abus sur son site est un pas en avant significatif. Twitter, par contre, a demandé des informations similaires mais a refusé de les divulguer, prétendre qu'il serait trompeur. Clairement, tous les commentaires signalés par les utilisateurs des sites de réseaux sociaux ne violeront pas ses termes et conditions. Mais l'échec de Twitter à divulguer ces informations suggère que l'entreprise n'est pas disposée à révéler l'ampleur des abus sur son propre site.

Cependant, même Facebook a encore un long chemin à parcourir pour parvenir à une transparence totale. Idéalement, tous les sites de réseaux sociaux publieraient des rapports annuels sur la manière dont ils luttent contre les abus en ligne. Cela permettrait aux régulateurs et au public de tenir les entreprises plus directement responsables des échecs de suppression des abus en ligne de leurs serveurs.

Cet article a été initialement publié sur The Conversation. Lire l'article original.