Quand l'information en ligne fait peur, il peut déclencher la haine et la violence. Crédit :UVgreen/Shutterstock.com

Lorsqu'un sénateur américain a demandé au PDG de Facebook, Mark Zuckerberg, « Pouvez-vous définir le discours de haine ? » c'était sans doute la question la plus importante à laquelle les réseaux sociaux sont confrontés :comment identifier l'extrémisme au sein de leurs communautés.

Les crimes haineux au 21e siècle suivent un schéma familier dans lequel une tirade en ligne dégénère en actions violentes. Avant d'ouvrir le feu dans la synagogue Tree of Life à Pittsburgh, le tireur accusé s'était exprimé sur le réseau social d'extrême droite Gab au sujet de migrants honduriens se dirigeant vers la frontière américaine, et la prétendue conspiration juive derrière tout cela. Puis il déclara, "Je ne peux pas rester assis à regarder mon peuple se faire massacrer. Vissez vos optiques, J'y vais. » La tendance des extrémistes à décharger leur intolérance en ligne a été une caractéristique inquiétante de certains crimes haineux récents. Mais la plupart des haines en ligne ne sont pas si flagrantes, ou aussi facile à repérer.

Comme je l'ai trouvé dans mon étude de 2017 sur l'extrémisme dans les réseaux sociaux et les blogs politiques, plutôt que le sectarisme manifeste, la plupart des haines en ligne ressemblent beaucoup à de la peur. Ce n'est pas exprimé par des insultes raciales ou des appels à la confrontation, mais plutôt dans des allégations infondées d'envahisseurs hispaniques affluant dans le pays, le crime noir sur blanc ou la charia infiltrant les villes américaines. Les récits hystériques comme ceux-ci sont devenus le véhicule préféré des extrémistes d'aujourd'hui - et peuvent être plus efficaces pour provoquer la violence dans le monde réel que les discours de haine stéréotypés.

La facilité de répandre la peur

Sur Twitter, un mème populaire circulant récemment dépeint le « réseau terroriste islamique » réparti sur une carte des États-Unis, tandis qu'un compte Facebook appelé « America Under Attack » partage un article avec ses 17, 000 followers sur les "Angry Young Men and Gangbangers" marchant vers la frontière. Et sur Gab, d'innombrables profils parlent de plans juifs pour saboter la culture américaine, souveraineté et le président.

Crédit :Graphique :La conversation, CC-BY-ND Source :HuffPost/YouGov

Sans être ouvertement hostile, ces notes jouent bien à un public qui a trouvé dans les médias sociaux un endroit où ils peuvent exprimer ouvertement leur intolérance, tant qu'ils colorent dans les lignes. Ils peuvent éviter l'exposition qu'attire le discours de haine traditionnel. Alors que le rassemblement nationaliste blanc à Charlottesville était très médiatisé et révélateur, les réseaux sociaux peuvent être anonymes et discrets, et donc libératrice pour le raciste non déclaré. Cela représente un défi de taille pour les plateformes comme Facebook, Twitter et YouTube.

Combattre la haine

Bien sûr, ce n'est pas seulement un défi pour les entreprises de médias sociaux. Le grand public est confronté à la question complexe de savoir comment réagir aux récits incendiaires et préjugés qui alimentent les peurs raciales et l'hostilité qui en découle. Cependant, les réseaux sociaux ont la capacité unique de baisser le volume de l'intolérance s'ils déterminent qu'un utilisateur a en fait enfreint ses conditions d'utilisation. Par exemple, en avril 2018, Facebook a supprimé deux pages associées au nationaliste blanc Richard Spencer. Quelques mois après, Twitter a suspendu plusieurs comptes associés au groupe d'extrême droite The Proud Boys pour avoir enfreint sa politique "interdisant les groupes extrémistes violents".

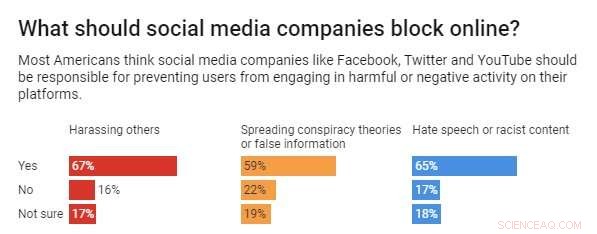

Toujours, certains critiques soutiennent que les réseaux n'avancent pas assez vite. Il y a une pression croissante pour que ces sites Web contrôlent l'extrémisme qui a prospéré dans leurs espaces, ou bien devenir eux-mêmes surveillés. Une récente enquête Huffpost/YouGov a révélé que les deux tiers des Américains voulaient que les réseaux sociaux empêchent les utilisateurs de publier des "discours de haine ou du contenu raciste".

En réponse, Facebook a intensifié ses efforts de lutte contre l'extrémisme, rapportant en mai qu'il avait supprimé « 2,5 millions de discours de haine, " dont plus d'un tiers a été identifié grâce à l'intelligence artificielle, le reste par des moniteurs humains ou signalés par des utilisateurs. Mais même si Zuckerberg a promis plus d'action en novembre 2018, l'entreprise a reconnu que l'enseignement de sa technologie pour identifier le discours de haine est extrêmement difficile en raison de tous les contextes et nuances qui peuvent considérablement modifier ces significations.

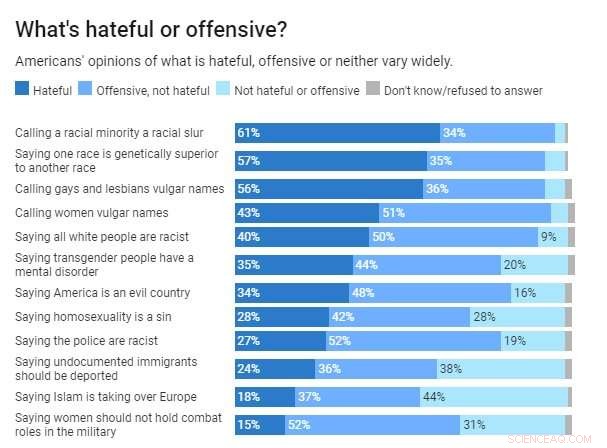

Les pourcentages totaux peuvent ne pas être exactement égaux à 100 en raison des arrondis. Crédit :Graphique :La conversation, CC-BY-ND Source :Institut Caton

De plus, le consensus public sur ce qui constitue réellement un discours de haine est au mieux ambigu. Le conservateur Cato Institute a constaté un large désaccord parmi les Américains sur le type de discours qui devrait être qualifié de haine, ou discours offensant, ou une critique juste. Et donc, ces divergences soulèvent la question évidente :comment un algorithme peut-il identifier le discours de haine si nous, les humains, pouvons à peine le définir nous-mêmes ?

La peur allume le fusible

L'ambiguïté de ce qui constitue un discours de haine offre une large couverture aux extrémistes modernes pour insuffler des angoisses culturelles dans les réseaux populaires. Cela présente peut-être le danger le plus évident :amorcer la paranoïa raciale des gens peut également être extrêmement puissant pour stimuler l'hostilité.

Le regretté spécialiste de la communication George Gerbner a découvert que, contrairement aux croyances populaires, une forte exposition à la violence médiatique n'a pas rendu les gens plus violents. Plutôt, cela les a rendus plus craintifs que les autres leur fassent violence, ce qui conduit souvent à une méfiance corrosive et à un ressentiment culturel. C'est précisément ce que les racistes d'aujourd'hui exploitent, et ce que les réseaux sociaux doivent apprendre à repérer.

Les messages qui parlent de complots juifs pour détruire l'Amérique, ou crime en noir sur blanc, n'appellent pas directement à la violence, mais ils amplifient les préjugés qui peuvent pousser les adeptes à agir. C'est précisément ce qui s'est passé avant les agressions meurtrières d'une église noire historique à Charleston en 2015, et la synagogue de Pittsburgh le mois dernier.

Pour les réseaux sociaux, le défi est double. Ils doivent d'abord décider s'ils continuent à accueillir des racistes non violents comme Richard Spencer, qui a appelé au "nettoyage ethnique pacifique, " et reste actif sur Twitter. Ou d'ailleurs, Le leader de la Nation de l'Islam Louis Farrakhan, qui a récemment comparé les Juifs aux termites, et continue de publier sur sa page Facebook.

Lorsque Twitter et Facebook laissent ces profils rester actifs, les entreprises prêtent la crédibilité de leurs communautés en ligne à ces provocateurs de racisme ou d'antisémitisme. Mais ils signalent également que leurs définitions de la haine peuvent être trop étroites.

Le discours de haine le plus dangereux n'est apparemment plus diffusé avec des insultes ethniques ou une rhétorique délirante sur la suprématie blanche. Plutôt, c'est partout sur les réseaux sociaux, en pleine vue, portant des hashtags comme #WhiteGenocide, #Crimes Noirs, #MigrantInvasion et #AmericaUnderAttack. Ils créent une illusion de menace imminente sur laquelle les radicaux prospèrent, et à laquelle les violents d'entre eux ont répondu.

Cet article est republié à partir de The Conversation sous une licence Creative Commons. Lire l'article original.