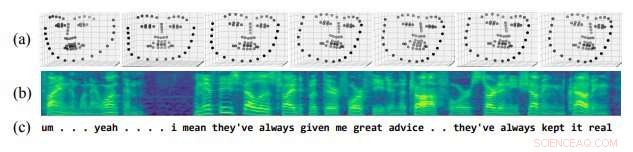

Données multimodales. Pour chaque entretien clinique, les chercheurs utilisent :(a) une vidéo de scans 3D du visage, (b) enregistrement audio, visualisé sous forme de spectrogramme log-mel, et (c) transcription textuelle du discours du patient. Le modèle prédit la gravité des symptômes dépressifs en utilisant les trois modalités. Crédit :Haque et al.

Des chercheurs de Stanford ont récemment exploré l'utilisation de l'apprentissage automatique pour mesurer la gravité des symptômes dépressifs en analysant le langage parlé et les expressions faciales en 3D des personnes. Leur méthode multi-modèle, décrit dans un article prépublié sur arXiv, obtenu des résultats très prometteurs, avec une sensibilité de 83,3% et une spécificité de 82,6%.

Actuellement, plus de 300 millions de personnes dans le monde souffrent de troubles dépressifs à des degrés divers. Dans des cas extrêmes, la dépression peut conduire au suicide, avec une moyenne d'environ 800, 000 personnes se suicident chaque année.

Les troubles de santé mentale sont actuellement diagnostiqués après un examen minutieux par un large éventail de prestataires de soins de santé, y compris les médecins généralistes, psychologues cliniciens et psychiatres. Néanmoins, détecter les maladies mentales est souvent beaucoup plus difficile que diagnostiquer les maladies physiques.

Plusieurs facteurs, y compris la stigmatisation sociale, coût et disponibilité du traitement, pourrait empêcher les personnes touchées de demander de l'aide. Actuellement, les chercheurs estiment que 60 pour cent des personnes atteintes de maladies mentales ne reçoivent pas de traitement.

Le développement de méthodes capables de détecter automatiquement les symptômes dépressifs pourrait améliorer la précision et la disponibilité des outils de diagnostic, conduisant à des interventions plus rapides et plus efficaces. Une équipe de chercheurs de Stanford a récemment étudié l'utilisation de l'apprentissage automatique pour mesurer la gravité des symptômes dépressifs.

"Dans ce travail, nous présentons une méthode d'apprentissage automatique pour mesurer la gravité des symptômes dépressifs, ", ont écrit les chercheurs dans leur article. "Notre méthode multimodale utilise des expressions faciales en 3D et un langage parlé, couramment disponibles sur les téléphones portables modernes.

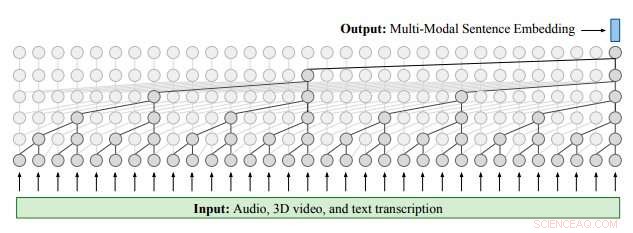

Apprentissage d'un plongement de phrase multimodal. Globalement, le modèle est un CNN causal. L'entrée pour le modèle est :audio, Scans faciaux 3D, et texte. L'incorporation de phrases multimodales est transmise à un classificateur de dépression et à un modèle de régression PHQ (non illustré ci-dessus). Crédit :Haque et al.

Les personnes déprimées présentent souvent une série de symptômes verbaux et non verbaux, y compris le pas monotone, taux d'articulation réduit, des volumes de parole plus faibles, moins de gestes, et plus de regards vers le bas. L'un des tests les plus courants pour évaluer la gravité des symptômes de dépression est le questionnaire de santé du patient (PHQ).

La méthode mise au point par les chercheurs analyse les pistes audio de la voix des patients, vidéo 3D de leurs expressions faciales, et des transcriptions textuelles de leurs entretiens cliniques. Sur la base de ces données, le modèle produit soit un score PHQ soit une étiquette de classification indiquant un trouble dépressif majeur.

Dans une première évaluation, le modèle a obtenu une erreur moyenne de 3,67 points (15,3 pour cent relatifs), à l'échelle PHQ, détection du trouble dépressif majeur avec une sensibilité de 83,3% et une spécificité de 82,6%. Les chercheurs ont choisi de collecter les données utilisées dans leur étude via des entretiens homme-ordinateur, plutôt que d'humain à humain.

« Par rapport à un intervieweur humain, la recherche a montré que les patients rapportent moins de peur de la divulgation et affichent plus d'intensité émotionnelle lorsqu'ils conversent avec un avatar, " les chercheurs ont écrit. " De plus, les gens ressentent des avantages psychologiques en révélant leurs expériences émotionnelles aux chatbots."

À l'avenir, cette nouvelle méthode de machine learning pourrait être déployée dans les smartphones du monde entier, contribuer à la mission de rendre les soins de santé mentale moins chers et plus accessibles. Selon les chercheurs, leur modèle est conçu pour augmenter et compléter les méthodes cliniques existantes, plutôt que d'émettre des diagnostics formels.

"Nous avons présenté une méthode d'apprentissage automatique multimodale qui combine des techniques de reconnaissance vocale, vision par ordinateur, et le traitement du langage naturel, ", ont écrit les chercheurs. "Nous espérons que ce travail inspirera d'autres personnes à créer des outils basés sur l'IA pour comprendre les troubles de santé mentale au-delà de la dépression."

© 2018 Réseau Science X