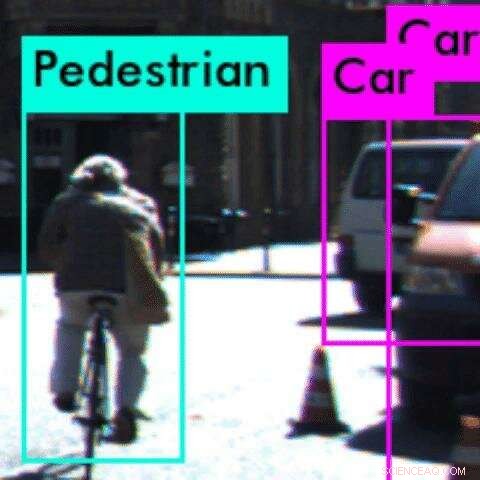

Dans cet exemple, un algorithme de perception classe à tort le cycliste en piéton Crédit :Anand Balakrishnan

C'est une grande question pour de nombreuses personnes dans les villes à forte densité de circulation comme Los Angeles :quand les voitures autonomes arriveront-elles ? Mais à la suite d'une série d'accidents très médiatisés aux États-Unis, les problèmes de sécurité pourraient mettre un terme brutal au rêve autonome.

À l'USC, des chercheurs ont publié une nouvelle étude qui aborde un problème de longue date pour les développeurs de véhicules autonomes :tester les algorithmes de perception du système, qui permettent à la voiture de « comprendre » ce qu'elle « voit ».

En collaboration avec des chercheurs de l'Arizona State University, la nouvelle méthode mathématique de l'équipe est capable d'identifier des anomalies ou des bogues dans le système avant que la voiture ne prenne la route.

Les algorithmes de perception sont basés sur des réseaux de neurones convolutifs, alimenté par l'apprentissage automatique, un type d'apprentissage en profondeur. Ces algorithmes sont notoirement difficiles à tester, car nous ne comprenons pas pleinement comment ils font leurs prédictions. Cela peut avoir des conséquences dévastatrices dans les systèmes critiques pour la sécurité comme les véhicules autonomes.

« Rendre les algorithmes de perception robustes est l'un des enjeux majeurs des systèmes autonomes, " a déclaré l'auteur principal de l'étude, Anand Balakrishnan, un doctorat en informatique de l'USC. étudiant.

« En utilisant cette méthode, les développeurs peuvent cibler les erreurs dans les algorithmes de perception beaucoup plus rapidement et utiliser ces informations pour perfectionner le système. De la même manière que les voitures doivent subir des crash tests pour assurer la sécurité, cette méthode offre un test préventif pour détecter les erreurs dans les systèmes autonomes."

Le papier, intitulé Spécification et évaluation des métriques de qualité pour les systèmes de perception basés sur la vision, a été présenté au Design, Conférence Automation and Test in Europe en Italie, 28 mars.

Apprendre le monde

Les véhicules généralement autonomes « apprennent » sur le monde via des systèmes d'apprentissage automatique, qui sont alimentés par d'énormes ensembles de données d'images de route avant de pouvoir identifier des objets par eux-mêmes.

Mais le système peut mal tourner. Dans le cas d'un accident mortel entre une voiture autonome et un piéton en Arizona en mars dernier, le logiciel a classé le piéton comme "faux positif" et a décidé qu'il n'avait pas besoin de s'arrêter.

"Nous pensions, il y a clairement un problème avec la façon dont cet algorithme de perception a été formé, " a déclaré le co-auteur de l'étude Jyo Deshmukh, professeur d'informatique à l'USC et ancien ingénieur en recherche et développement chez Toyota, spécialisée dans la sécurité des véhicules autonomes.

"Quand un être humain perçoit une vidéo, il existe certaines hypothèses sur la persistance que nous utilisons implicitement :si nous voyons une voiture dans une image vidéo, nous nous attendons à voir une voiture à proximité dans la prochaine image vidéo. C'est l'une des nombreuses « conditions de bon sens » que nous voulons que l'algorithme de perception satisfasse avant le déploiement. »

Par exemple, un objet ne peut pas apparaître et disparaître d'une image à l'autre. Si c'est le cas, il viole une "condition de santé mentale, " ou loi fondamentale de la physique, ce qui suggère qu'il y a un bug dans le système de perception.

Deshmukh et son doctorat. étudiant Balakrishnan, avec USC Ph.D. étudiant Xin Qin et étudiant à la maîtrise Aniruddh Puranic, fait équipe avec trois chercheurs de l'Université d'État de l'Arizona pour enquêter sur le problème.

Pas de place à l'erreur

L'équipe a formulé une nouvelle logique mathématique, appelée Logique Temporelle de Qualité Temporisée, et l'a utilisé pour tester deux outils d'apprentissage automatique populaires, Squeeze Det et YOLO, à l'aide d'ensembles de données vidéo brutes de scènes de conduite.

La logique a réussi à affiner les instances d'outils d'apprentissage automatique violant les « conditions de santé mentale » sur plusieurs images de la vidéo. Le plus souvent, les systèmes d'apprentissage automatique n'ont pas réussi à détecter un objet ou ont mal classé un objet.

Par exemple, dans un exemple, le système n'a pas reconnu un cycliste de dos, quand le pneu du vélo ressemblait à une fine ligne verticale. Au lieu, il a classé à tort le cycliste comme un piéton. Dans ce cas, le système peut ne pas anticiper correctement le prochain mouvement du cycliste, ce qui pourrait conduire à un accident.

Les objets fantômes, où le système perçoit un objet alors qu'il n'y en a pas, étaient également courants. Cela pourrait amener la voiture à claquer par erreur sur les freins, un autre mouvement potentiellement dangereux.

La méthode de l'équipe pourrait être utilisée pour identifier des anomalies ou des bugs dans l'algorithme de perception avant le déploiement sur la route et permet au développeur d'identifier des problèmes spécifiques.

L'idée est de détecter les problèmes d'algorithme de perception dans les tests virtuels, rendre les algorithmes plus sûrs et plus fiables. Surtout, parce que la méthode repose sur une bibliothèque de « conditions de santé mentale, " les humains n'ont pas besoin d'étiqueter les objets dans l'ensemble de données de test, un processus long et souvent défectueux.

À l'avenir, l'équipe espère incorporer la logique pour recycler les algorithmes de perception lorsqu'elle trouve une erreur. Il pourrait également être étendu à une utilisation en temps réel, pendant que la voiture roule, comme moniteur de sécurité en temps réel.