Crédit :MIT

Apprendre ce que les gens voient sur leurs tests de Rorschach (ce test psychologique où votre perception d'une tache d'encre est analysée pour examiner la personnalité et le fonctionnement émotionnel) est intéressant.

Ces images abstraites aident les psychologues à évaluer l'état d'esprit d'un patient, a déclaré BBC News, en particulier « qu'ils perçoivent le monde sous un jour négatif ou positif ».

Tout aussi intéressant est ce que nous pouvons apprendre sur le travail sur les performances de l'IA sur le même test.

Une équipe du MIT Media Lab a créé Norman, la première IA psychopathe au monde. Il s'agit d'un projet de la coopération évolutive du laboratoire.

Jane Wakefield de la BBC, journaliste technologique, décrit Norman comme un algorithme formé pour comprendre des images.

Quoi, Normand? Oui, Celui-la, sur le modèle de Norman Bates, Le célèbre personnage d'Alfred Hitchcock dans son psychopathe . En ce qui concerne les icônes des personnages à l'écran, Norman a été aussi inoubliable que Mary Poppins et le Père Noël.

L'équipe à l'origine du projet a formé Norman pour effectuer le sous-titrage des images. L'activité est une méthode d'apprentissage en profondeur pour générer une description textuelle d'une image.

Pour s'entraîner, les légendes des images particulières provenaient de ce qu'ils appelaient "un infâme subreddit (son nom est expurgé en raison de son contenu graphique) qui est dédié à la documentation et à l'observation de la réalité troublante de la mort".

Wakefield a déclaré que le logiciel avait montré des images de personnes mourant dans des circonstances horribles, extrait du groupe sur Reddit.

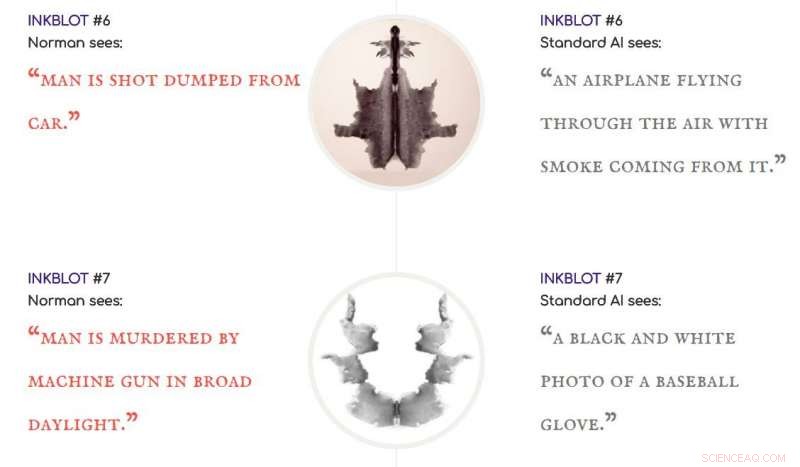

Les sous-titres du côté de Norman ont été comparés aux sous-titres du réseau de neurones de sous-titrage d'images standard. Comme l'équipe l'a décrit, Les sous-titres normands ont été comparés à "un réseau de neurones de sous-titrage d'images standard (formé sur l'ensemble de données MSCOCO) sur des taches d'encre Rorschach".

Crédit :MIT

Pourquoi faire ce genre de chose ? Le but est un exercice pour obtenir une prise en main utile de ce qui peut mal tourner. "Norman est né du fait que les données utilisées pour enseigner un algorithme d'apprentissage automatique peuvent influencer considérablement son comportement. Ainsi, lorsque les gens parlent d'algorithmes d'IA biaisés et injustes, le coupable n'est souvent pas l'algorithme lui-même, mais les données biaisées qui lui ont été fournies. La même méthode permet de voir des choses très différentes dans une image, même des choses malades, s'il est mal entraîné (ou, le droit !) ensemble de données."

Normand, l'équipe a dit, « représente une étude de cas sur les dangers de l'intelligence artificielle qui tournent mal lorsque des données biaisées sont utilisées dans des algorithmes d'apprentissage automatique. »

Cela devient assez clair lorsque vous regardez les deux IA, Normande et standard, répondre aux tests de tache d'encre. Norman :Un homme est électrocuté. IA standard :oiseaux assis au sommet d'une branche d'arbre. Norman :Homme assassiné à la mitrailleuse en plein jour. Standard :Une photo N&B d'un gant de baseball. Norman :L'homme est abattu devant sa femme qui hurle. Standard :La personne tient un parapluie en l'air.

Comme Wakefield l'a dit, Le point de vue de Norman était « sans cesse sombre - il a vu des cadavres, du sang et de la destruction dans chaque image."

Et l'IA standard ? Ayant été formé sur des images "plus normales", il offrait des explications plus gaies sur ce qui se passait.

le professeur Iyad Rahwan, membre de l'équipe de trois personnes du Media Lab du MIT qui a développé Norman, a été cité par nouvelles de la BBC . "'Les données comptent plus que l'algorithme. Cela met en évidence l'idée que les données que nous utilisons pour entraîner l'IA se reflètent dans la façon dont l'IA perçoit le monde et comment elle se comporte.'"

Il y a deux façons de considérer les médias sociaux :comme un fléau qui nous entraîne dans des vies effondrées à regarder des photos et des vidéos et à frapper anonymement des ennemis imaginaires. Ensuite, il y a les réseaux sociaux, le monstre envahissant la vie privée qui veut monétiser tous nos likes et clignements d'yeux.

Ensuite, il y a ces gens.

« Au fil des millénaires, les humains ont inventé diverses formes d'organisation sociale pour se gouverner, des tribus et des cités aux royaumes et aux démocraties. Ces institutions nous permettent d'augmenter notre capacité de coordination, coopérer, échanger des informations, et prendre des décisions. Aujourd'hui, les médias sociaux offrent de nouvelles façons de se connecter et de créer des institutions virtuelles, nous permettant d'aborder les problèmes de société à l'échelle planétaire de manière critique dans le temps. Plus significativement, progrès de l'intelligence artificielle, apprentissage automatique, et l'optimisation informatique nous aident à réinventer la résolution de problèmes humains."

Wakefield a écrit que si l'expérience avec Norman prouve quelque chose, c'est que l'IA entraînée sur de mauvaises données peut elle-même devenir mauvaise.

© 2018 Tech Xplore