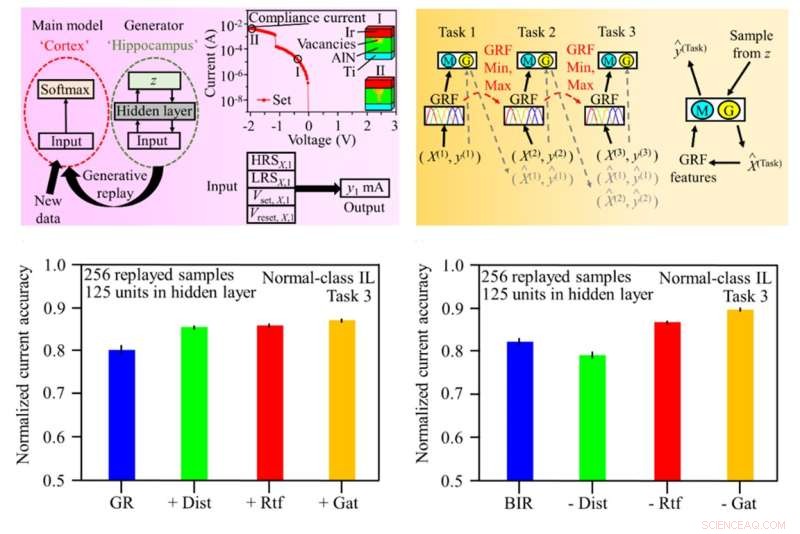

Graphiques de la configuration de relecture générative (panneau supérieur gauche) et schéma de formation du réseau de neurones artificiels (ANN) avec relecture générative (panneau supérieur droit). La précision du courant électrique normalisé pour les modèles conventionnels (panneau inférieur gauche) et de relecture inspirée du cerveau (BIR) (panneau inférieur droit). Crédit :SUTD

Comme en témoignent les percées dans divers domaines de l'intelligence artificielle (IA), tels que le traitement d'images, les soins de santé intelligents, les véhicules autonomes et les villes intelligentes, c'est sans aucun doute la période dorée de l'apprentissage en profondeur. Au cours de la prochaine décennie, l'IA et les systèmes informatiques finiront par être équipés de la capacité d'apprendre et de penser comme les humains, de traiter un flux continu d'informations et d'interagir avec le monde réel.

Cependant, les modèles d'IA actuels souffrent d'une perte de performance lorsqu'ils sont entraînés consécutivement sur de nouvelles informations. En effet, chaque fois que de nouvelles données sont générées, elles sont écrites au-dessus des données existantes, effaçant ainsi les informations précédentes. Cet effet est connu sous le nom d'"oubli catastrophique". Une difficulté découle du problème de stabilité-plasticité, où le modèle d'IA doit mettre à jour sa mémoire pour s'adapter en permanence aux nouvelles informations, et en même temps, maintenir la stabilité de ses connaissances actuelles. Ce problème empêche l'IA de pointe d'apprendre en permanence à partir d'informations du monde réel.

Les systèmes d'informatique de pointe permettent de déplacer l'informatique du stockage en nuage et des centres de données vers la source d'origine, comme les appareils connectés à l'Internet des objets (IoT). L'application efficace de l'apprentissage continu sur les systèmes informatiques de pointe à ressources limitées reste un défi, bien que de nombreux modèles d'apprentissage continu aient été proposés pour résoudre ce problème. Les modèles traditionnels nécessitent une puissance de calcul élevée et une grande capacité de mémoire.

Un nouveau type de code pour réaliser un système d'apprentissage continu économe en énergie a été récemment conçu par une équipe de chercheurs de l'Université de technologie et de design de Singapour (SUTD), comprenant Shao-Xiang Go, Qiang Wang, Bo Wang, Yu Jiang et Natasa Bajalović. L'équipe était dirigée par le chercheur principal, le professeur adjoint Desmond Loke du SUTD. L'étude de ces chercheurs, "Continual Learning Electrical Conduction in Resistive-Switching-Memory Materials", a été publiée dans la revue Advanced Theory and Simulations .

L'équipe a proposé le Brain-Inspired Replay (BIR), un modèle inspiré du cerveau, qui effectue naturellement un apprentissage continu. Le modèle BIR, basé sur l'utilisation d'un réseau de neurones artificiels et d'un auto-encodeur variationnel, imite les fonctions du cerveau humain et peut bien fonctionner dans des situations d'apprentissage incrémentiel de classe sans stocker de données. Les chercheurs ont également utilisé le modèle BIR pour représenter la croissance des filaments conducteurs à l'aide du courant électrique dans les systèmes de mémoire numérique.

"Dans ce modèle, les connaissances sont préservées dans des modèles entraînés afin de minimiser la perte de performances lors de l'introduction de tâches supplémentaires, sans qu'il soit nécessaire de se référer aux données des travaux précédents", a expliqué le professeur adjoint Loke. "Donc, cela nous permet d'économiser une quantité substantielle d'énergie."

"De plus, une précision de pointe de 89 % sur la conformité difficile aux tâches d'apprentissage actuelles sans stocker de données a été atteinte, ce qui est environ deux fois supérieur à celui des modèles d'apprentissage continu traditionnels, ainsi qu'une efficacité énergétique élevée", " ajouta-t-il.

Pour permettre au modèle de traiter indépendamment les informations sur place dans le monde réel, l'équipe prévoit d'étendre la capacité ajustable du modèle dans la prochaine phase de ses recherches.

"Basée sur des démonstrations à petite échelle, cette recherche en est encore à ses débuts", a déclaré le professeur adjoint Loke. "L'adoption de cette approche devrait permettre aux systèmes d'IA de pointe de progresser indépendamment sans contrôle humain." Une synapse artificielle ultrabasse consommation pour les systèmes d'IA de nouvelle génération