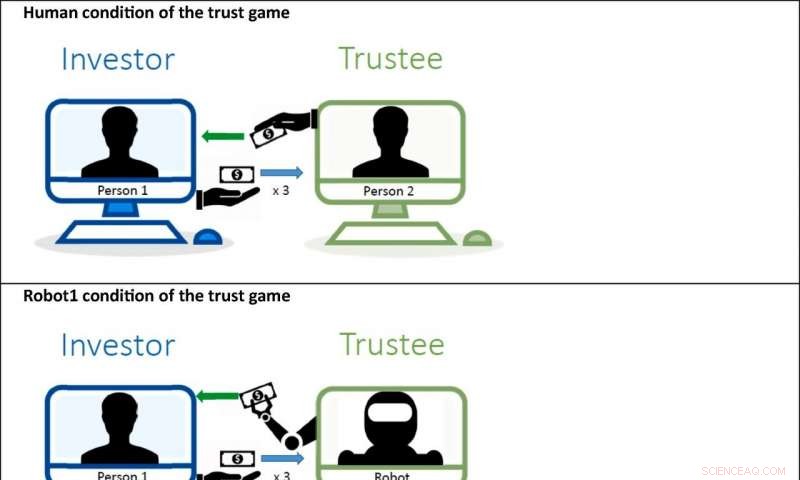

Dans la condition humaine, un participant humain (Personne 1) dans le rôle d'investisseur est jumelé à un participant humain (Personne 2) dans le rôle de fiduciaire. Dans la condition Robot1, un humain (Personne 1) dans le rôle d'investisseur est associé à un robot dans le rôle de fiduciaire. Dans la condition Robot2, un participant humain (Personne 1) dans le rôle d'investisseur est associé à un robot dans le rôle de fiduciaire qui agit au nom d'un participant passif (Personne 2). Crédit :Université Chapman

Dans une recherche publiée dans le Revue de psychologie économique , les scientifiques cherchent à savoir si les gens font confiance aux robots comme ils le font avec leurs semblables. Ces interactions sont importantes à comprendre car les interactions basées sur la confiance avec les robots sont de plus en plus courantes sur le marché, lieu de travail, sur la route et à la maison. Les résultats montrent que les gens étendent la confiance de la même manière que les humains et les robots, mais les réactions émotionnelles des gens dans les interactions basées sur la confiance varient en fonction du type de partenaire.

L'étude a été dirigée par Eric Schniter de l'Université Chapman, doctorat et Timothy Shields, doctorat avec Daniel Sznycer de l'Université de Montréal, doctorat

Les chercheurs ont utilisé une expérience de jeu de confiance anonyme au cours de laquelle un homme de confiance décidait du montant d'une dotation de 10 $ à donner à un fiduciaire - un être humain, un robot, ou un robot dont les gains vont à un autre humain. Le fiduciaire humain sait qu'il y avait des gains potentiels du transfert et le fiduciaire déterminerait s'il doit rendre la pareille en transférant un montant. Les robots ont été programmés pour imiter la réciprocité précédemment observée par des administrateurs humains.

Il est bien établi que dans des jeux de confiance comme celui-ci, la plupart des gens prennent des décisions qui profitent à la fois au fiduciaire et au fiduciaire. Après l'interaction, les participants ont évalué diverses émotions positives et négatives.

La conception expérimentale a permis aux chercheurs d'expliquer deux aspects importants de la confiance dans les robots explicables :à quel point les humains font confiance aux robots par rapport à leurs semblables et les modèles de réaction des humains à la suite d'interactions avec des robots par rapport à d'autres humains.

L'expérience montre que les gens accordent des niveaux de confiance similaires aux humains et aux robots. Ce n'est pas ce que nous trouverions si les humains faisaient aveuglément confiance ou refusaient de faire confiance aux robots. Ce ne serait pas non plus le résultat si nous pensons que les gens accordent leur confiance dans le seul but d'améliorer le bien-être des autres humains, puisque faire confiance à un robot n'améliore pas le bien-être d'une autre personne.

Le résultat est cohérent avec le point de vue selon lequel les gens font confiance à la fois pour un gain monétaire et pour découvrir des informations sur les propensions comportementales humaines. Grâce à leurs interactions de confiance avec les robots, les participants ont découvert la coopération entre les humains.

Les émotions sociales sont plus que des sentiments :elles régulent le comportement social. Plus précisement, émotions sociales telles que la culpabilité, Reconnaissance, colère, et la fierté affectent la façon dont nous traitons les autres et influencent la façon dont les autres nous traitent dans des interactions basées sur la confiance.

Les participants à cette expérience ont vécu les émotions sociales différemment selon que leur partenaire était un robot ou un humain. Un défaut de réciprocité de l'investissement du fiduciaire dans le fiduciaire a déclenché plus de colère lorsque le fiduciaire était un être humain que lorsque le fiduciaire était un robot. De la même manière, la réciprocité déclenchait plus de gratitude lorsque le fiduciaire était un être humain que lorsque le fiduciaire était un robot.

Plus loin, les émotions des participants ont été finement discriminées entre les types de robots. Ils ont déclaré ressentir une fierté et une culpabilité plus intenses lorsque la récompense du robot fiduciaire est allée à un humain que lorsque le robot a agi seul.

Étant donné que la confiance initiale ne différait pas selon le type de partenaire, mais les émotions sociales l'ont fait, une possibilité distincte est que la réextension de la confiance dans les interactions répétées diffère lorsque le partenaire est un être humain, un robot, ou un robot lié à un bénéficiaire humain.

À l'avenir, la conduite présentera des opportunités d'interaction où il importera de savoir si les décisions sont prises par des humains ou des robots et si elles servent les humains ou non. Certaines voitures utilisées pour la livraison ou le ramassage peuvent rouler sans occupants humains, d'autres voitures conduiront avec des occupants humains passifs et pourtant d'autres voitures seront conduites par des conducteurs humains. Des interactions analogues se produisent avec des agents d'enregistrement automatisés ou robotisés, caissiers de banque, chirurgiens, etc.

Les partenariats avec des réciprocateurs cohérents peuvent se consolider en des des partenariats plus productifs lorsque les réciprocateurs sont des frères humains, parce que les humains suscitent plus de gratitude que les robots. Inversement, les partenariats avec des réciprocateurs incohérents peuvent être plus stables lorsque les réciprocateurs sont des robots, parce que les robots suscitent moins de colère que les humains. Plus loin, les humains ont ressenti la fierté et la culpabilité plus intensément dans les interactions où les robots ont servi un bénéficiaire, ce qui suggère que les gens seront plus susceptibles de faire confiance à des partenaires similaires.

L'architecture cognitive humaine a évolué pour avoir suffisamment de structure et de contenu pour promouvoir la survie et la reproduction de nos ancêtres tout en ayant également la flexibilité de naviguer dans de nouveaux défis et opportunités. Ces fonctionnalités permettent aux humains de concevoir et d'interagir rationnellement avec l'intelligence artificielle et les robots. Toujours, interactions avec les automates, et la capacité de la science à expliquer ces interactions est imparfaite parce que les automates manquent des indices psychophysiques que nous attendons dans une interaction et sont souvent guidés par des logiques de décision inexplicables ou peu intuitives.