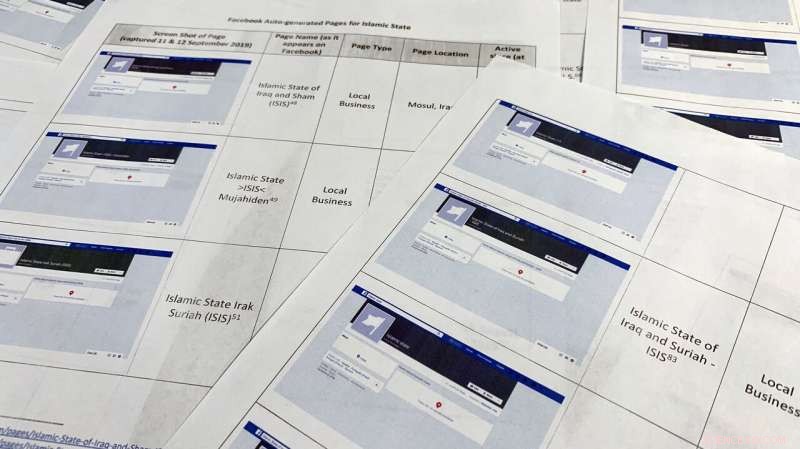

Pages d'un rapport confidentiel d'un dénonciateur obtenu par l'Associated Press, ainsi que deux pages Facebook imprimées qui étaient actives mardi, 17 septembre, 2019, sont photographiés à Washington. Facebook aime dire que ses systèmes automatisés suppriment la grande majorité des contenus interdits glorifiant le groupe État islamique et al-Qaida avant qu'ils ne soient signalés. Mais la plainte d'un dénonciateur montre que Facebook lui-même a produit par inadvertance des dizaines de pages à leur nom. (Photo AP/Jon Elswick)

Face aux critiques selon lesquelles Facebook ne fait pas assez pour lutter contre les messages extrémistes, la société aime à dire que ses systèmes automatisés suppriment la grande majorité des contenus interdits glorifiant le groupe État islamique et al-Qaida avant qu'ils ne soient signalés.

Mais la plainte d'un lanceur d'alerte montre que Facebook lui-même a fourni par inadvertance aux deux groupes extrémistes un outil de réseautage et de recrutement en produisant des dizaines de pages à leur nom.

La société de réseautage social semble avoir fait peu de progrès sur la question au cours des quatre mois écoulés depuis que l'Associated Press a détaillé comment les pages que Facebook génère automatiquement pour les entreprises aident les extrémistes du Moyen-Orient et les suprémacistes blancs aux États-Unis.

Mercredi, Les sénateurs américains du Comité du commerce, Science, et Transport interrogeront les représentants des entreprises de médias sociaux, dont Monika Bickert, qui dirige les efforts de Facebook pour endiguer les messages extrémistes.

Les nouveaux détails proviennent d'une mise à jour d'une plainte auprès de la Securities and Exchange Commission que le National Whistleblower Center prévoit de déposer cette semaine. Le classement obtenu par l'AP recense près de 200 pages générées automatiquement, certaines pour les entreprises, d'autres pour les écoles ou d'autres catégories – qui font directement référence au groupe État islamique et des dizaines d'autres représentant al-Qaida et d'autres groupes connus. Une page répertoriée comme une « idéologie politique » est intitulée « J'aime l'État islamique ». Il comporte un logo IS à l'intérieur des contours de la célèbre icône de pouce levé de Facebook.

En réponse à une demande de commentaire, un porte-parole de Facebook a déclaré à l'AP :"Notre priorité est de détecter et de supprimer le contenu publié par des personnes qui enfreignent notre politique contre les individus et les organisations dangereux pour rester en avance sur les mauvais acteurs. Les pages générées automatiquement ne sont pas comme les pages Facebook normales car les gens ne peuvent pas commenter ou publier sur eux et nous supprimons tout ce qui enfreint nos politiques. Bien que nous ne puissions pas attraper tout le monde, nous restons vigilants dans cet effort."

Facebook a un certain nombre de fonctions qui génèrent automatiquement des pages à partir du contenu publié par les utilisateurs. La plainte mise à jour examine une fonction destinée à aider le réseautage d'affaires. Il récupère les informations sur l'emploi des pages des utilisateurs pour créer des pages pour les entreprises. Dans ce cas, cela peut aider les groupes extrémistes car cela permet aux utilisateurs d'aimer les pages, fournir potentiellement une liste de sympathisants pour les recruteurs.

Pages d'un rapport confidentiel d'un dénonciateur obtenu par l'Associated Press, sont photographiés à Washington, mardi, 17 septembre, 2019. Facebook aime dire que ses systèmes automatisés suppriment la grande majorité des contenus interdits glorifiant le groupe État islamique et al-Qaida avant qu'ils ne soient signalés. Mais la plainte d'un dénonciateur montre que Facebook lui-même a produit par inadvertance des dizaines de pages à leur nom. (Photo AP/Jon Elswick)

Le nouveau dossier a également révélé que les pages des utilisateurs faisant la promotion de groupes extrémistes restent faciles à trouver avec de simples recherches utilisant leurs noms. Ils ont découvert une page de "Mohammed Atta" avec une photo emblématique de l'un des adhérents d'Al-Qaida, qui était un pirate de l'air dans les attentats du 11 septembre. La page répertorie le travail de l'utilisateur comme « Al Qaidah » et l'éducation comme « Maître d'université Ben Laden » et « School Terrorist Afghanistan ».

Facebook s'efforce de limiter la diffusion de matériel extrémiste sur son service, pour l'instant avec un succès mitigé. En mars, il a élargi sa définition de contenu interdit pour inclure le matériel nationaliste blanc américain et séparatiste blanc ainsi que celui de groupes extrémistes internationaux. Il dit avoir interdit 200 organisations suprémacistes blanches et 26 millions de contenus liés à des groupes extrémistes mondiaux comme l'EI et al-Qaida.

Il a également élargi sa définition du terrorisme pour inclure non seulement les actes de violence commis pour atteindre un objectif politique ou idéologique, mais aussi des tentatives de violence, en particulier lorsqu'elles visent des civils dans l'intention de contraindre et d'intimider. C'est vague, bien que, à quel point l'application fonctionne bien si l'entreprise a toujours du mal à débarrasser sa plate-forme des partisans d'organisations extrémistes bien connues.

Mais comme le montre le rapport, beaucoup de matériau passe à travers les fissures et est généré automatiquement.

L'histoire d'AP en mai a mis en évidence le problème de la génération automatique, mais le nouveau contenu identifié dans le rapport suggère que Facebook ne l'a pas résolu.

Le rapport indique également que les chercheurs ont découvert que de nombreuses pages référencées dans le rapport AP ont été supprimées plus de six semaines plus tard, le 25 juin. la veille de Bickert a été interrogé pour une autre audience du Congrès.

Le problème a été signalé dans la plainte initiale de la SEC déposée par le directeur exécutif du centre, John Kostyack, qui allègue que la société de médias sociaux a exagéré son succès dans la lutte contre les messages extrémistes.

"Facebook voudrait nous faire croire que ses algorithmes magiques nettoient en quelque sorte son site Web de contenu extrémiste, " a déclaré Kostyack. " Pourtant, ces mêmes algorithmes sont des pages à génération automatique avec des titres comme " J'aime l'État islamique, ' qui sont idéales pour les terroristes à utiliser pour le réseautage et le recrutement."

© 2019 La Presse Associée. Tous les droits sont réservés.