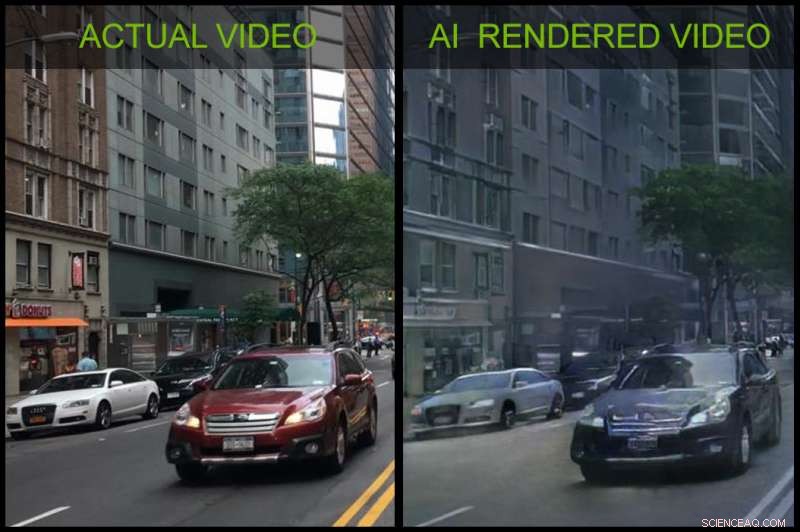

Crédit :Nvidia

Voici une chaîne de mots que vous pouvez méditer :Graphiques interactifs AI. Nvidia est l'acte principal. Les cerveaux du GPU sont entièrement derrière un prochain chapitre, "IA, " pour l'industrie graphique. Des choses impressionnantes se produisent lorsque vous apportez un système de réseau neuronal à la table pour des mondes virtuels basés sur des séquences vidéo.

Créer une scène numérique réaliste nécessite normalement beaucoup (et beaucoup) de patience. "Maintenant, nous pouvons simplement décharger le travail sur un algorithme d'IA, " dit Will Knight, dans son regard sur ce sur quoi travaille Nvidia, dans Examen de la technologie du MIT .

Nvidia annonce ce qu'il dit être le premier monde virtuel interactif rendu par l'IA, et l'a appelé une "percée de l'IA". L'équipe de chercheurs était dirigée par Bryan Catanzaro, vice-président, Apprentissage profond appliqué. « En fait, nous enseignons au modèle à dessiner sur la base d'une vidéo réelle, " a-t-il dit en Examen de la technologie du MIT .

Les images sont rendues par la technologie AI, ledit chercheur scientifique, Ting Chun Wang. En d'autres termes, l'équipe a formé un réseau de neurones pour rendre des environnements 3D après avoir été formé sur des vidéos existantes.

Les percées commencent par la question de quelqu'un. Chez Nvidia, la question et si était, Et si nous pouvions former un modèle d'IA pour dessiner de nouveaux mondes uniquement à partir d'une vidéo du monde réel ? Donc, c'est maintenant chose faite dans le domaine de la technologie montrant une telle génération d'images.

Les utilisateurs ciblés sont les développeurs et les artistes. L'idée est pour eux de créer des mondes virtuels 3D interactifs pour l'automobile, jeu ou réalité virtuelle.

Des vidéos de villes pour rendre l'environnement urbain ont été sélectionnées sur lesquelles ils ont entraîné le réseau de neurones.

"On nous a donné des séquences de conduite de différentes villes, " a déclaré Ting-Chun Wang. Ensuite, ils ont utilisé un autre réseau de segmentation, extraire la sémantique de haut niveau, il a dit, à partir de ces séquences.

Le moteur UE4 a aidé à générer les mises en page colorisées - différents objets ont reçu des couleurs différentes. Le réseau convertit à son tour la représentation en images.

[UE4 fait référence à Unreal Engine 4. Le bord l'a décrit comme "un moteur populaire utilisé pour des titres tels que Fortnite, PUBG, Engrenages de guerre 4, et bien d'autres." Le site Unreal Engine 4 a déclaré qu'il s'agissait "d'une suite complète d'outils de développement de jeux conçus par des développeurs de jeux, pour les développeurs de jeux."]

Nvidia a montré ses progrès lors de la conférence NeurIPS à Montréal, Canada, une émission axée sur la recherche en IA.

Oui, mais, autre que le facteur gee-whiz, à quoi ça sert? La création de contenu coûte cher et cette voie d'IA permet d'économiser de l'argent et du temps. Nouvel Atlas fait l'observation que "Pour rendre les mondes virtuels plus immersifs, les artistes doivent les remplir de bâtiments, rochers, des arbres, et autres objets. La création et le placement de tous ces objets virtuels s'ajoutent rapidement à un temps et à un coût de développement assez élevés."

Pour le développement de jeux ou d'autres applications, Nvidia a exploré une méthode qui permettrait aux développeurs de créer à moindre coût, en utilisant une IA qui apprend du monde réel. Le communiqué de presse a souligné que puisque la sortie est générée de manière synthétique, "une scène peut être facilement modifiée pour être supprimée, modifier, ou ajouter des objets."

Jacques Vincent dans Le bord a guidé les lecteurs à travers les efforts de recherche de Nvidia :

"Le problème est, si les algorithmes d'apprentissage en profondeur génèrent les graphiques pour le monde à une cadence de 25 images par seconde, comment font-ils pour que les objets restent identiques ? Catanzaro dit que ce problème signifiait que les résultats initiaux du système étaient « douloureux à regarder », car les couleurs et les textures « changeaient à chaque image ». L'équipe a donné au système une mémoire à court terme, et ainsi il pourrait comparer un nouveau cadre avec ce qui s'est passé avant. En tant que tel, il crée de nouvelles images cohérentes avec ce qui est à l'écran.

Le communiqué de presse de Nvidia a déclaré que "cette recherche est à un stade précoce".

© 2018 Réseau Science X