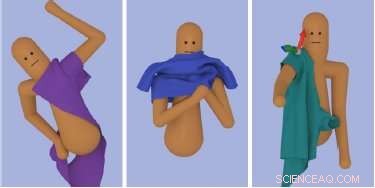

Des informaticiens du Georgia Institute of Technology et de Google Brain, la branche de recherche en intelligence artificielle de Google, ont mis au point une nouvelle méthode de calcul, entraîné par des techniques d'apprentissage automatique, pour simuler avec succès et de manière réaliste le processus en plusieurs étapes consistant à enfiler des vêtements. Crédit :SIGGRAPH Asie

Mettre des vêtements est un quotidien, tâche banale que la plupart d'entre nous accomplissent avec peu ou pas de réflexion. Nous ne prendrons peut-être jamais en considération les multiples étapes et mouvements physiques impliqués lorsque nous nous habillons le matin. Mais c'est précisément ce qui doit être exploré lorsque l'on tente de capturer le mouvement de l'habillage et de la simulation d'un tissu pour l'animation par ordinateur.

Des informaticiens du Georgia Institute of Technology et de Google Brain, la branche de recherche en intelligence artificielle de Google, ont mis au point une nouvelle méthode de calcul, entraîné par des techniques d'apprentissage automatique, pour simuler avec succès et de manière réaliste le processus en plusieurs étapes consistant à enfiler des vêtements. Une fois disséqué, la tâche de s'habiller est assez complexe, et implique plusieurs interactions physiques différentes entre le personnage et ses vêtements, principalement guidé par le sens du toucher de la personne.

Créer l'animation d'un personnage enfilant des vêtements est un défi en raison des interactions complexes entre le personnage et le vêtement simulé. La plupart des travaux d'animation de personnages hautement contraints traitent d'environnements statiques qui ne réagissent pas beaucoup au mouvement du personnage, note les chercheurs. En revanche, les vêtements peuvent réagir immédiatement et de manière drastique à de petits changements dans la position du corps; les vêtements ont tendance à se plier, coller et s'accrocher au corps, faire haptique, ou sensation tactile, indispensable à la tâche.

Un autre défi unique concernant l'habillage est que le personnage doit effectuer une séquence de mouvements prolongée impliquant un ensemble diversifié de sous-tâches, comme saisir la couche avant d'une chemise, glisser une main dans l'ouverture de la chemise et passer une main à travers une manche.

"S'habiller semble facile pour beaucoup d'entre nous car nous le pratiquons tous les jours. En réalité, la dynamique du tissu rend très difficile d'apprendre à s'habiller à partir de zéro, " dit Alexander Clegg, auteur principal de la recherche et un doctorat en informatique. étudiant au Georgia Institute of Technology. « Nous utilisons la simulation pour apprendre à un réseau de neurones à accomplir ces tâches complexes en décomposant la tâche en plus petits morceaux avec des objectifs bien définis, permettant au personnage d'essayer la tâche des milliers de fois et de fournir des signaux de récompense ou de pénalité lorsque le personnage tente des changements bénéfiques ou préjudiciables à sa politique."

La méthode des chercheurs met ensuite à jour le réseau de neurones étape par étape pour rendre les changements positifs découverts plus susceptibles de se produire à l'avenir. "De cette façon, nous enseignons au personnage comment réussir la tâche, " note Clegg.

Clegg et ses collaborateurs de Georgia Tech comprennent les informaticiens Wenhao Yu, Greg Turk et Karen Liu. En collaboration avec le chercheur de Google Brain, Jie Tan, le groupe présentera son travail au SIGGRAPH Asia 2018 à Tokyo du 4 au 7 décembre. La conférence annuelle présente les membres techniques et créatifs les plus respectés dans le domaine de l'infographie et des techniques interactives, et met en valeur la recherche de pointe en science, de l'art, jeux et animations, entre autres secteurs.

Dans cette étude, les chercheurs ont démontré leur approche sur plusieurs tâches d'habillage :enfiler un t-shirt, enfilage d'une veste et habillage robotisé d'une manche. Avec le réseau de neurones entraîné, ils ont pu réaliser une reconstitution complexe d'une variété de façons dont un personnage animé met des vêtements. Key intègre le sens du toucher dans leur cadre pour surmonter les défis de la simulation de tissu. Les chercheurs ont découvert qu'une sélection minutieuse des observations de tissu et des fonctions de récompense dans leur réseau formé est cruciale pour le succès du cadre. Par conséquent, cette nouvelle approche permet non seulement des séquences d'habillage uniques, mais un contrôleur de personnage qui peut s'habiller avec succès dans diverses conditions.

« Nous avons ouvert la porte à une nouvelle façon d'animer des tâches d'interaction en plusieurs étapes dans des environnements complexes en utilisant l'apprentissage par renforcement, " dit Clegg. " Il y a encore beaucoup de travail à faire pour continuer dans cette voie, permettant à la simulation de fournir une expérience et une pratique pour la formation aux tâches dans un monde virtuel. l'équipe collabore actuellement avec d'autres chercheurs du laboratoire de robotique médicale de Georgia Tech pour étudier l'application de la robotique pour l'assistance au pansement.