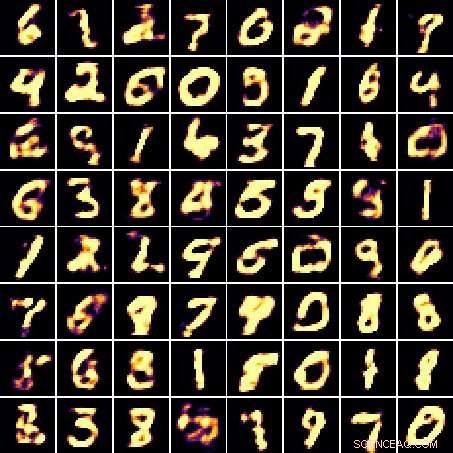

Sorties préactivées (c'est-à-dire, la valeur réelle, des valeurs intermédiaires juste avant l'opération de binarisation; voir la section 2.2) pour le modèle proposé mis en œuvre par les MLP et formé avec l'objectif WGAN-GP. Modèle proposé avec DBN (préactivé). Crédit :Dong et Yang.

Chercheurs du Centre de recherche pour l'innovation informatique de l'Academia Sinica, Dans Taiwan, ont récemment développé un nouveau réseau antagoniste génératif (GAN) qui a des neurones binaires à la couche de sortie du générateur. Ce modèle, présenté dans un article pré-publié sur arXiv, peut générer directement des prédictions à valeur binaire au moment du test.

Jusque là, Les approches GAN ont obtenu des résultats remarquables dans la modélisation des distributions continues. Néanmoins, appliquer des GAN à des données discrètes a été quelque peu difficile jusqu'à présent, en particulier en raison des difficultés d'optimisation de la distribution du modèle vers la distribution des données cible dans un espace discret de grande dimension.

Hao-Wen Dong, l'un des chercheurs qui a mené l'étude, Raconté Tech Xplore , "Je travaille actuellement sur la génération musicale au sein du Music and AI Lab de l'Academia Sinica. À mon avis, composer peut être interprété comme une série de décisions - par exemple, concernant l'instrumentation, accords et même les notes exactes à utiliser. Pour avancer vers la réalisation de la grande vision d'un compositeur d'IA solide, Je suis particulièrement intéressé à savoir si les modèles génératifs profonds tels que les GAN sont capables de prendre des décisions. Par conséquent, ce travail a examiné si nous pouvons entraîner un GAN qui utilise des neurones binaires pour prendre des décisions binaires en utilisant la rétropropagation, l'algorithme d'entraînement standard."

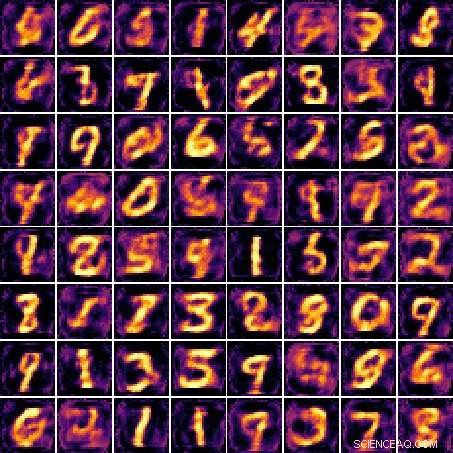

Dong et son conseiller Yi-Hsuan Yang ont développé un modèle qui peut générer directement des prédictions à valeur binaire au moment du test. Ils l'ont ensuite utilisé pour générer des chiffres MNIST binarisés et comparer les performances de différents types de neurones binaires, Objectifs du GAN et architectures réseau.

Exemples de chiffres générés et de sorties préactivées (c'est-à-dire, la valeur réelle, des valeurs intermédiaires juste avant l'opération de binarisation; voir la section 2.2) pour le modèle proposé mis en œuvre par les MLP et formé avec l'objectif WGAN-GP. Modèle proposé avec SBN (pré-activé). Crédit :Dong et Yang.

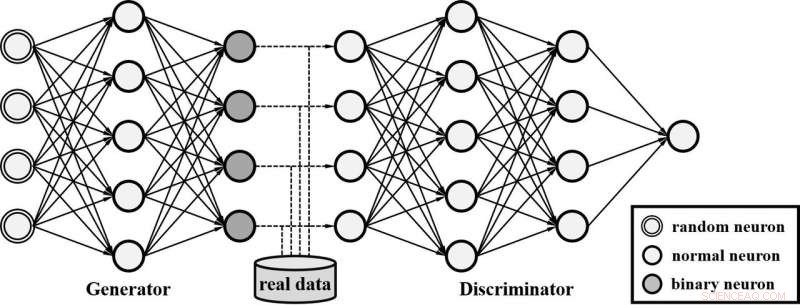

"En un mot, BinaryGAN est un GAN qui adopte des neurones binaires, les neurones qui produisent un un ou un zéro, à la couche de sortie du générateur, " Dit Dong. " Un GAN a deux composants principaux :le générateur et le discriminateur. Le générateur vise à produire de faux échantillons de données capables de tromper le discriminateur en classant les échantillons générés comme réels. D'autre part, le but du discriminateur est de distinguer les données fausses des données réelles. Le retour fourni par le discriminateur est ensuite utilisé pour améliorer le générateur. Après la formation, le générateur peut ensuite être utilisé pour générer de nouveaux échantillons de données."

Les chercheurs ont pu former efficacement BinaryGAN, leur modèle génératif avec des neurones binaires. Leurs résultats suggèrent également que l'utilisation d'estimateurs de gradient pourrait être une approche prometteuse pour modéliser des distributions discrètes avec des GAN.

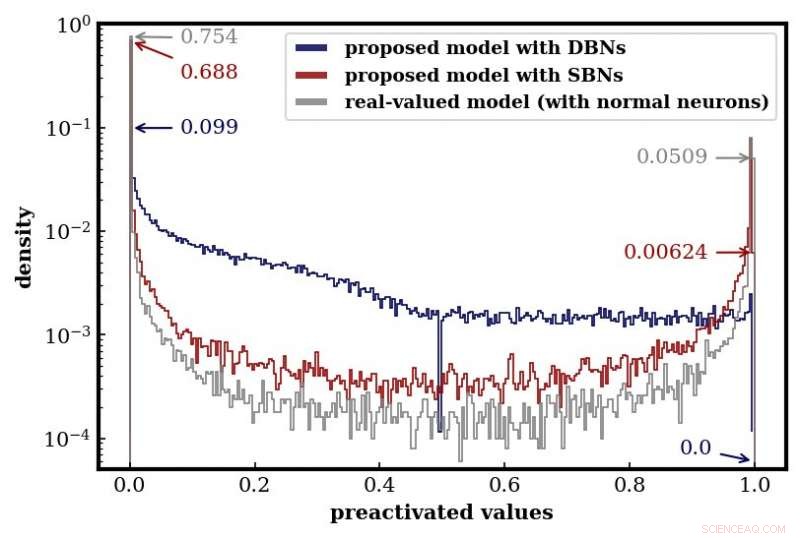

Histogrammes des sorties préactivées pour le modèle proposé et des prédictions probabilistes pour le modèle à valeur réelle. Les deux modèles sont tous deux mis en œuvre par les MLP et formés avec l'objectif WGAN-GP. Crédit :Dong et Yang.

"Avec l'utilisation d'estimateurs de gradient, nous avons pu former BinaryGAN, en utilisant l'algorithme de rétropropagation, " dit Dong. " De plus, la binarisation adoptée dans le modèle a entraîné des caractéristiques distinctes des représentations intermédiaires apprises par les réseaux de neurones profonds. Cela souligne également l'importance d'inclure des opérations de binarisation dans la formation, afin que ces opérations de binarisation puissent également être optimisées."

Dong et Yang cherchent maintenant à appliquer un GAN qui adopte des neurones binaires à la réalisation d'un graphe de calcul conditionnel. Dans ce cas, certains composants seraient activés et désactivés, selon les décisions prises par les neurones binaires du réseau.

Schéma du système du modèle proposé mis en œuvre par les MLP. Notez que les neurones binaires ne sont utilisés qu'au niveau de la couche de sortie du générateur. Crédit :Dong et Yang.

"C'est important car cela nous permet de construire un modèle plus complexe qui repose sur des décisions prises aux premières couches du réseau, " a dit Dong. " Par exemple, nous pourrions construire un compositeur IA qui apprend d'abord à décider de l'instrumentation et des accords, puis compose en conséquence."

© 2018 Tech Xplore