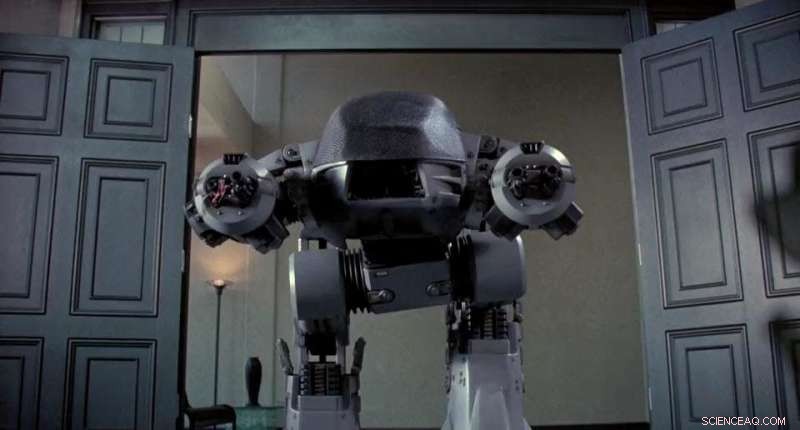

Le robot ED-209 du film RoboCop n'a pas fonctionné comme prévu. Crédit :IMDB/RoboCop

Imaginez que vous vivez dans une ville intelligente qui connaît votre visage et suit chacun de vos mouvements - les endroits où vous allez, les gens que tu vois, et toutes les choses que vous faites en cours de route.

Heures supplémentaires, l'intelligence artificielle (IA) autonome crée un profil qui indique votre probabilité de commettre un crime. Lorsque ce risque est élevé, la police prend des mesures préventives. Bienvenue dans l'hyper-surveillance et la prochaine génération de police prédictive.

L'Inde et la Chine mettent actuellement en œuvre ce niveau de surveillance pour réduire les taux de criminalité et détecter les terroristes avant qu'ils ne frappent.

Le Japon envisage également des systèmes prédictifs avant les Jeux olympiques de Tokyo en 2020. Londres et ailleurs au Royaume-Uni utilisent une technologie similaire depuis un certain temps.

Cela se produit peut-être déjà dans la ville où vous habitez.

Envahissant, une surveillance en temps réel comme celle-ci est possible car plus puissante, les ordinateurs de calcul peuvent traiter les torrents de données de reconnaissance faciale et d'analyse de la démarche provenant de milliers de caméras vidéo, le tout coordonné par une IA avancée qui peut donner un sens à tout cela.

Il n'y a pas si longtemps, nous nous sommes appuyés sur des patrouilles policières aux yeux d'aigle pour assurer la sécurité publique. C'était à l'époque où nous vivions dans des communautés assez petites où les gens se connaissaient de vue.

Mais alors que les villes continuaient de croître, devenir trop grand pour le policier seul, télévision en circuit fermé (CCTV), la reconnaissance faciale et les systèmes prédictifs de génération précédente ont été utilisés.

La morale de l'hyper-surveillance

Les avis sont partagés sur l'éthique de la police prédictive.

Les défenseurs de la vie privée et les défenseurs des libertés civiles ont des inquiétudes, sinon des objections, à ce niveau de surveillance – craignant qu'il ne devienne un instrument de discrimination.

Pendant ce temps, Les défenseurs de la sécurité publique et de la lutte contre le terrorisme soutiennent que la technologie prédictive a un grand potentiel pour contrecarrer les attaques terroristes et d'autres menaces à la sécurité publique.

Les deux arguments ont force et validité, alors la question est où exactement tracer la ligne entre l'intérêt public et la liberté individuelle ?

La réponse sera différente au cas par cas. Chaque juridiction doit négocier la réponse en tenant compte de toutes les préoccupations des parties prenantes.

Depuis l'attaque des terroristes aux États-Unis le 11 septembre, 2001, le degré de surveillance et de recherche dans les aéroports a considérablement augmenté.

À l'heure, le public voyageur en est venu à accepter la situation comme étant dans son propre intérêt et celui de ses compagnons de voyage.

La confidentialité commence et se termine à la porte d'entrée

Il est généralement admis que vous avez droit à la vie privée dans votre propre maison. Lorsque vous fermez la porte d'entrée, vous pouvez raisonnablement vous attendre à ce que personne ne regarde et n'écoute.

L'exception est lorsque vous êtes à la maison mais que vous êtes engagé dans une activité criminelle qui menace la communauté. C'est ici que nous traçons la ligne de démarcation entre les droits individuels et le bien commun.

Mais quand tu vas dehors, n'importe qui peut vous regarder s'il le souhaite. Ils pourraient également entendre la conversation que vous avez. Il n'y a pas de droit à la vie privée du regard du public, et ne l'a jamais été.

Mais regarder est différent de faire des prédictions - et la vérité inconfortable est que la technologie de police prédictive a le potentiel d'être utilisée comme un outil d'oppression. Gérer ce risque dans un environnement ouvert, la société démocratique est certainement un défi, mais pas insurmontable avec des freins et contrepoids.

Peser les risques et les avantages

Compte tenu de l'expérience globale de la police prédictive, il semble qu'il existe de solides arguments en faveur de son utilisation continue.

En Australie, par exemple, 15 attentats terroristes auraient été déjoués au cours des trois dernières années grâce au travail de la police appuyé par des algorithmes informatiques.

La question est, comment minimiser les risques à un niveau acceptable ?

La réponse courte est d'établir un cadre juridique qui garantit la transparence éthique dans toutes les méthodes de police prédictive de l'IA, y compris la façon dont les algorithmes sont assemblés.

Cela garantirait également de manière rigoureuse que les données introduites dans les systèmes prédictifs sont exactes et impartiales. Comme pour tout système informatique, la sortie est seulement aussi bonne que l'entrée - poubelle, les ordures, comme on dit.

Cela est nécessaire pour répondre aux préoccupations actuelles concernant les biais inhérents aux systèmes prédictifs.

Il a été observé que toutes les forces de police ne sont pas créées égales. Aux Etats-Unis il n'y en a pas moins de 12, 000 forces de police locales. Il y a forcément des différences, se reflète dans la qualité du leadership et la disponibilité des ressources.

Partenariat homme/IA

Les services de police ne sont pas parfaits et les agents humains ne font pas les choses correctement tout le temps.

Mais en ce qui concerne l'IA dans la police, Je crois qu'il devrait toujours y avoir une place dans l'application de la loi pour les instincts finement aiguisés d'un officier humain expérimenté tempéré par un système de freins et contrepoids.

La technologie doit toujours être subordonnée à l'humain, jouer le rôle d'aide à la décision.

De cette façon, quand l'ère de l'hyper-surveillance arrive dans votre ville natale, ce sera un humain responsable, pas une machine – aussi intelligente soit-elle – qui décide si une personne représente un risque grave pour la sécurité publique.

Cet article a été initialement publié sur The Conversation. Lire l'article original.