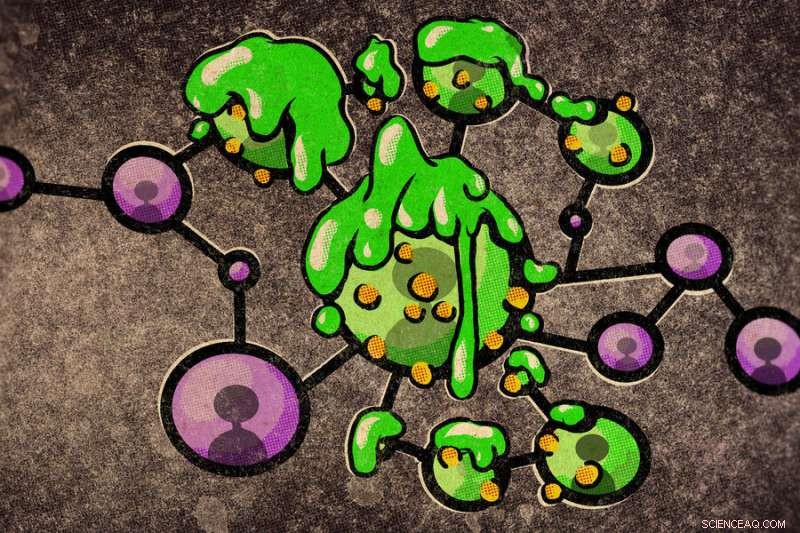

Les chercheurs du MIT ont construit un modèle théorique pour étudier comment les nouvelles se propagent sur un réseau social de type Twitter et ont découvert que lorsqu'un réseau est hautement connecté ou lorsque les opinions de ses membres sont fortement polarisées, les fausses nouvelles se répandent plus largement que les nouvelles considérées comme plus crédible. Crédit :Jose-Luis Olivares, MIT

La propagation de la désinformation sur les réseaux sociaux est un problème de société urgent auquel les entreprises technologiques et les décideurs continuent de se débattre, mais ceux qui étudient ce problème ne comprennent toujours pas pourquoi et comment les fausses nouvelles se propagent.

Pour faire la lumière sur ce sujet trouble, des chercheurs du MIT ont développé un modèle théorique de réseau social de type Twitter pour étudier comment les informations sont partagées et explorer les situations où une information non crédible se propagera plus largement que la vérité. Les agents du modèle sont motivés par le désir de persuader les autres de partager leur point de vue :l'hypothèse clé du modèle est que les gens prennent la peine de partager quelque chose avec leurs abonnés s'ils pensent que c'est persuasif et susceptible de rapprocher les autres de leur point de vue. état d'esprit. Sinon, ils ne partageront pas.

Les chercheurs ont découvert que dans un tel contexte, lorsqu'un réseau est fortement connecté ou que les opinions de ses membres sont fortement polarisées, les informations susceptibles d'être fausses se répandent plus largement et pénètrent plus profondément dans le réseau que les informations plus crédibles.

Ce travail théorique pourrait éclairer des études empiriques sur la relation entre la crédibilité des informations et la taille de leur diffusion, ce qui pourrait aider les entreprises de médias sociaux à adapter les réseaux pour limiter la propagation de fausses informations.

"Nous montrons que, même si les gens sont rationnels dans la façon dont ils décident de partager les nouvelles, cela pourrait toujours conduire à l'amplification d'informations avec une faible crédibilité. Avec ce motif de persuasion, aussi extrêmes que soient mes convictions, étant donné que les plus extrêmes plus je gagne à faire bouger les opinions des autres - il y a toujours quelqu'un qui amplifierait [l'information] ", déclare l'auteur principal Ali Jadbabaie, professeur et chef du Département de génie civil et environnemental et membre principal du corps professoral de l'Institut pour les données, les systèmes et la société (IDSS) et chercheur principal au Laboratoire des systèmes d'information et de décision (LIDS).

Rejoindre Jadbabaie sur l'article sont le premier auteur Chin-Chia Hsu, un étudiant diplômé du programme des systèmes sociaux et d'ingénierie de l'IDSS, et Amir Ajorlou, un chercheur du LIDS. La recherche sera présentée cette semaine à la conférence IEEE sur la décision et le contrôle.

Méditer la persuasion

Cette recherche s'appuie sur une étude de 2018 de Sinan Aral, professeur de gestion David Austin à la MIT Sloan School of Management; Deb Roy, professeure agrégée d'arts médiatiques et de sciences au Media Lab; et l'ancien postdoc Soroush Vosoughi (maintenant professeur adjoint d'informatique à l'Université de Dartmouth). Leur étude empirique des données de Twitter a révélé que les fausses nouvelles se propagent plus largement, plus rapidement et plus profondément que les vraies nouvelles.

Jadbabaie et ses collaborateurs ont voulu comprendre pourquoi cela se produit.

Ils ont émis l'hypothèse que la persuasion pourrait être un puissant motif de partage d'informations (peut-être que les agents du réseau veulent persuader les autres de partager leur point de vue) et ont décidé de construire un modèle théorique qui leur permettrait d'explorer cette possibilité.

Dans leur modèle, les agents ont une croyance préalable sur une politique, et leur objectif est de persuader les suiveurs de rapprocher leurs croyances du côté de l'agent du spectre.

Une nouvelle est initialement diffusée à un petit sous-groupe aléatoire d'agents, qui doivent décider de partager ou non cette nouvelle avec leurs abonnés. Un agent évalue la pertinence de l'article et sa crédibilité, et met à jour sa croyance en fonction de la façon dont la nouvelle est surprenante ou convaincante.

"Ils feront une analyse coûts-avantages pour voir si, en moyenne, cette nouvelle va rapprocher les gens de ce qu'ils pensent ou les éloigner. Et nous incluons un coût nominal pour le partage. Par exemple, prendre des mesures, si vous faites défiler les réseaux sociaux, vous devez vous arrêter pour le faire. Pensez à cela comme un coût. Ou un coût de réputation peut survenir si je partage quelque chose qui est embarrassant. Tout le monde a ce coût, donc le plus extrême et le plus intéressant le l'actualité, plus vous voulez la partager", déclare Jadbabaie.

Si la nouvelle confirme le point de vue de l'agent et a un pouvoir de persuasion supérieur au coût nominal, l'agent partagera toujours la nouvelle. Mais si un agent pense que l'actualité est quelque chose que d'autres ont peut-être déjà vu, l'agent n'est pas incité à le partager.

Étant donné que la volonté d'un agent de partager des nouvelles est le produit de son point de vue et de la persuasion de la nouvelle, plus la perspective d'un agent est extrême ou plus la nouvelle est surprenante, plus l'agent est susceptible de la partager.

Les chercheurs ont utilisé ce modèle pour étudier comment l'information se propage au cours d'une cascade de nouvelles, qui est une chaîne de partage ininterrompue qui imprègne rapidement le réseau.

Connectivité et polarisation

L'équipe a constaté que lorsqu'un réseau a une connectivité élevée et que les nouvelles sont surprenantes, le seuil de crédibilité pour démarrer une cascade de nouvelles est plus bas. Une connectivité élevée signifie qu'il existe plusieurs connexions entre de nombreux utilisateurs du réseau.

De même, lorsque le réseau est largement polarisé, de nombreux agents aux opinions extrêmes souhaitent partager l'actualité, déclenchant une cascade d'informations. Dans ces deux cas, les informations peu crédibles créent les cascades les plus importantes.

"Pour toute information, il existe une limite de vitesse naturelle du réseau, une gamme de connectivité, qui facilite une bonne transmission de l'information où la taille de la cascade est maximisée par de vraies nouvelles. Mais si vous dépassez cette limite de vitesse, vous entrerez dans des situations où des nouvelles inexactes ou peu crédibles ont une plus grande taille de cascade", explique Jadbabaie.

Si les opinions des utilisateurs du réseau se diversifient, il est moins probable qu'une nouvelle peu crédible se répande plus largement que la vérité.

Jadbabaie et ses collègues ont conçu les agents du réseau pour qu'ils se comportent de manière rationnelle, de sorte que le modèle capture mieux les actions que de vrais humains pourraient entreprendre s'ils veulent persuader les autres.

"Quelqu'un pourrait dire que ce n'est pas la raison pour laquelle les gens partagent, et c'est valable. La raison pour laquelle les gens font certaines choses fait l'objet d'un débat intense dans les sciences cognitives, la psychologie sociale, les neurosciences, l'économie et les sciences politiques", dit-il. "Selon vos hypothèses, vous finissez par obtenir des résultats différents. Mais j'ai l'impression que cette hypothèse selon laquelle la persuasion est le motif est une hypothèse naturelle."

Leur modèle montre également comment les coûts peuvent être manipulés pour réduire la propagation de fausses informations. Les agents effectuent une analyse coûts-avantages et ne partageront pas d'actualités si le coût de le faire l'emporte sur les avantages du partage.

"Nous ne faisons aucune prescription politique, mais une chose que ce travail suggère est que, peut-être, avoir un certain coût associé au partage des nouvelles n'est pas une mauvaise idée. La raison pour laquelle vous obtenez beaucoup de ces cascades est que le coût du partage des nouvelles est en fait très faible », dit-il.