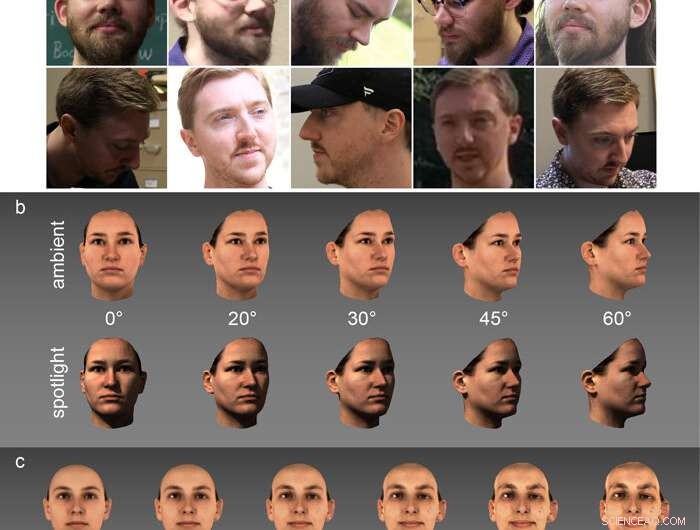

Monde réel, des images sans contraintes comme celles-ci (a) sont utilisées pour former des réseaux de reconnaissance faciale. Les tests de l'étude ont été effectués sur des données de balayage laser hautement contrôlées variant selon le point de vue (b, Colonnes), éclairage (b, rangées) et une force identitaire caricaturale (c). Crédit :Université du Texas à Dallas

La technologie de reconnaissance faciale a progressé rapidement au cours des cinq dernières années. Alors que les chercheurs de l'Université du Texas à Dallas tentent de déterminer comment les ordinateurs sont devenus aussi bons que les gens à cette tâche, ils mettent également en lumière la façon dont le cerveau humain trie les informations.

Les scientifiques de l'UT Dallas ont analysé les performances du dernier échelon des algorithmes de reconnaissance faciale, révélant le fonctionnement surprenant de ces programmes, basés sur l'apprentissage automatique. Leur étude, publié en ligne le 12 novembre dans Nature Machine Intelligence , montre que ces programmes informatiques sophistiqués, appelés réseaux de neurones à convolution profonde (DCNN), ont découvert comment identifier les visages différemment de ce que les chercheurs attendaient.

« Depuis 30 ans, les gens ont supposé que les systèmes visuels informatisés se débarrassaient de toutes les informations spécifiques à l'image - angle, éclairage, expression et ainsi de suite, " a déclaré le Dr Alice O'Toole, auteur principal de l'étude et professeur Aage et Margareta Møller à l'École des sciences du comportement et du cerveau. "Au lieu, les algorithmes conservent cette information tout en rendant l'identité plus importante, qui est une façon fondamentalement nouvelle de penser le problème. »

En apprentissage automatique, les ordinateurs analysent de grandes quantités de données afin d'apprendre à reconnaître des modèles, dans le but de pouvoir prendre des décisions avec un minimum d'intervention humaine. O'Toole a déclaré que les progrès réalisés par l'apprentissage automatique pour la reconnaissance faciale depuis 2014 ont "tout changé à pas de géant".

"Des choses qui n'étaient jamais faisables auparavant, qui ont entravé la technologie de vision par ordinateur pendant 30 ans, est devenu non seulement faisable, mais assez facile, " O'Toole a dit. " Le hic, c'est que personne n'a compris comment ça marche. "

Les algorithmes de la génération précédente étaient efficaces pour reconnaître les visages qui n'avaient que des changements mineurs par rapport à l'image qu'ils connaissaient déjà. Technologie actuelle, cependant, connaît suffisamment une identité pour surmonter les changements d'expression, point de vue ou apparence, comme enlever les lunettes.

"Ces nouveaux algorithmes fonctionnent plus comme vous et moi, " O'Toole a déclaré. "C'est en partie parce qu'ils ont accumulé une énorme quantité d'expérience avec des variations dans la façon dont une identité peut apparaître. Mais ce n'est pas tout."

L'équipe d'O'Toole s'est mise à apprendre comment fonctionnent les algorithmes d'apprentissage, à la fois pour étayer la confiance placée dans leurs résultats et, comme l'a expliqué l'auteur principal Matthew Hill, pour faire la lumière sur la façon dont le cortex visuel du cerveau humain effectue la même tâche.

"La structure de ce type de réseau neuronal a été inspirée à l'origine par la façon dont le cerveau traite les informations visuelles, " dit Hill, doctorant en cognition et neurosciences. "Parce qu'il excelle à résoudre les mêmes problèmes que le cerveau, cela peut donner un aperçu de la façon dont le cerveau résout le problème."

Les origines du type d'algorithme de réseau de neurones que l'équipe a étudié remonte à 1980, mais la puissance des réseaux de neurones a augmenté de façon exponentielle plus de 30 ans plus tard.

« Au début de cette décennie, deux choses se sont produites :Internet a donné à ce programme des millions d'images et d'identités avec lesquelles travailler - des quantités incroyables de données facilement disponibles - et la puissance de calcul a augmenté, pour que, au lieu d'avoir deux ou trois couches de « neurones » dans le réseau de neurones, vous pouvez avoir plus de 100 couches, comme ce système le fait maintenant, " dit O'Toole.

Malgré le but recherché par l'algorithme, l'échelle de ses calculs – qui se comptent au moins en dizaines de millions – fait que les scientifiques sont incapables de comprendre tout ce qu'il fait.

"Même si l'algorithme a été conçu pour modéliser le comportement des neurones dans le cerveau, nous ne pouvons pas garder une trace de tout ce qui se passe entre l'entrée et la sortie, " dit Connor Parde, auteur de l'article et doctorant en cognition et neurosciences. "Nous devons donc concentrer nos recherches sur la sortie."

Pour démontrer les capacités de l'algorithme, l'équipe a utilisé des caricatures, versions extrêmes d'une identité, dont Y. Ivette Colón BS'17, un assistant de recherche et un autre auteur de l'étude, décrit comme "la version la plus 'vous' de vous".

"Les caricatures exagèrent votre identité unique par rapport à celle des autres, " O'Toole a dit. " D'une certaine manière, c'est exactement ce que l'algorithme veut faire :mettre en évidence ce qui vous rend différent des autres."

A la surprise des chercheurs, le DCNN excellait en fait à relier les caricatures à leurs identités correspondantes.

« Vu ces images déformées aux traits disproportionnés, le réseau comprend que ce sont les mêmes caractéristiques qui rendent une identité distinctive et relie correctement la caricature à l'identité, " O'Toole a déclaré. "Il voit cette identité distinctive d'une manière qu'aucun de nous n'avait anticipée."

Donc, à mesure que les systèmes informatiques commencent à égaler - et, à l'occasion, surpasser—les performances de reconnaissance faciale des humains, la base de l'algorithme pour trier les informations pourrait-elle ressembler à ce que fait le cerveau humain ?

Découvrir, une meilleure compréhension du cortex visuel humain est nécessaire. Les informations les plus détaillées disponibles sont via les images obtenues par IRM fonctionnelle, qui peut être utilisé pour imager l'activité du cerveau pendant qu'un sujet exécute une tâche mentale. Hill a décrit l'IRMf comme "trop bruyante" pour voir les petits détails.

"La résolution d'une IRMf est loin de ce dont vous avez besoin pour voir ce qui se passe avec l'activité des neurones individuels, " Hill a déclaré. "Avec ces réseaux, vous avez tous les calculs. Cela nous permet de nous demander :les identités pourraient-elles être organisées de cette façon dans nos esprits ? »

Le laboratoire d'O'Toole s'attaquera ensuite à cette question, grâce à une récente subvention de plus de 1,5 million de dollars sur quatre ans du National Eye Institute des National Institutes of Health.

« Le NIH nous a chargé de la question biologique :dans quelle mesure ces résultats sont-ils pertinents pour la perception visuelle humaine ? » elle a dit. "Nous avons quatre ans de financement pour trouver une réponse."