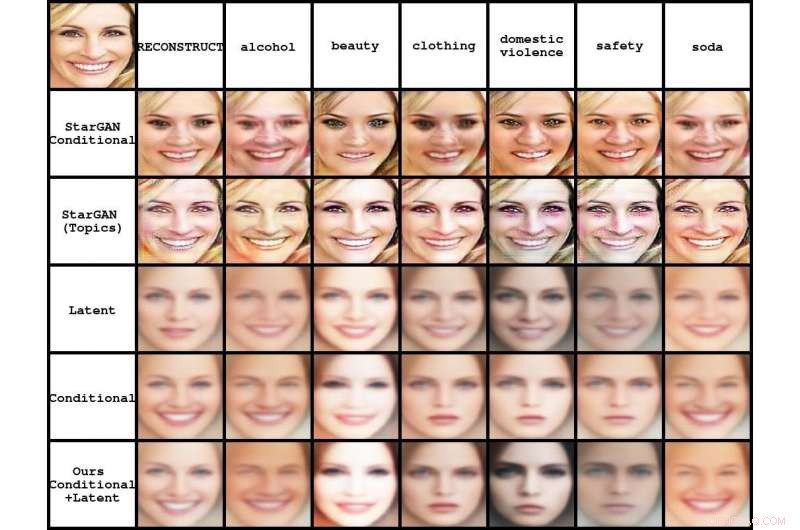

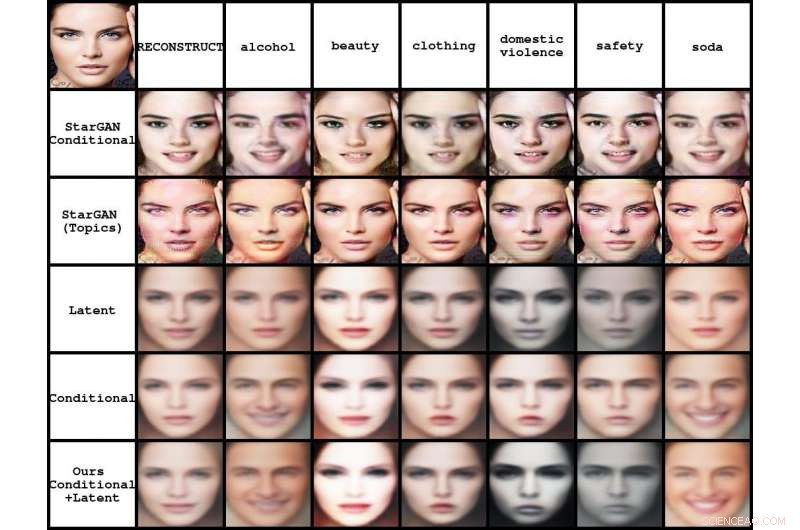

Faces publicitaires transformées en 5 catégories différentes. Crédit :Thomas &Kovashka

Des chercheurs de l'Université de Pittsburgh ont récemment développé un auto-encodeur variationnel conditionnel qui peut produire des visages uniques pour les publicités. Leur étude est fondée sur leurs travaux antérieurs, qui a exploré des méthodes automatisées pour mieux comprendre la publicité.

« Dans notre précédent projet, nous voulions voir si les machines pouvaient décoder la rhétorique visuelle complexe trouvée dans les publicités, " Christophe Thomas, l'un des chercheurs qui a mené l'étude, a déclaré Tech Xplore. "Les annonces contiennent des jeux de mots, métaphores, et d'autres dispositifs rhétoriques persuasifs qui sont difficiles à comprendre pour les machines. Dans ce document, nous ne voulions pas seulement comprendre les publicités, mais nous voulions voir si un tel contenu persuasif pouvait être généré automatiquement par des ordinateurs."

La mission principale de l'industrie de la publicité est de promouvoir des produits ou de transmettre des idées en utilisant un langage et des images persuasifs. Visages, un aspect clé des annonces, sont souvent présentés différemment selon le produit annoncé et le message communiqué.

En collaboration avec sa collègue Adriana Kovashka, Thomas a utilisé l'apprentissage automatique pour générer des visages persuasifs qui fonctionneraient bien pour différents types de publicités. Ils ont utilisé des autoencodeurs variationnels conditionnels, ou "modèles génératifs, " des modèles d'apprentissage automatique qui apprennent à générer des données synthétiques similaires à celles sur lesquelles elles sont formées.

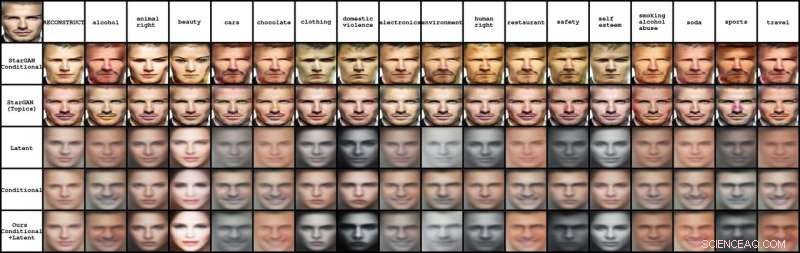

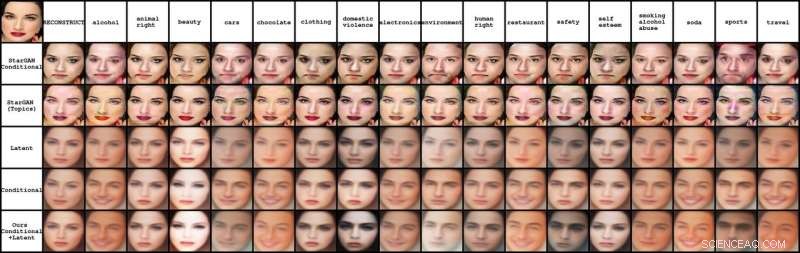

Faces publicitaires transformées en 17 catégories différentes. Crédit :Thomas &Kovashka

"En vision par ordinateur, les autoencodeurs fonctionnent en prenant une image et en apprenant à représenter cette image sous forme de quelques nombres, " dit Thomas. " Alors, une deuxième pièce du modèle, le décodeur, apprend à prendre ces chiffres et à en reproduire l'image originale. Vous pouvez presque le considérer comme une forme de compression, dans laquelle une grande image est représentée par quelques chiffres."

Lorsque ce type de modèle de machine learning est entraîné sur un ensemble de données suffisamment volumineux, il commence à représenter des aspects sémantiques dans les nombres. Par exemple, dans le modèle développé par Thomas et Kovashka, un nombre contrôlerait la forme d'un visage, un autre l'ombre de la peau, et ainsi de suite pour les autres caractéristiques sémantiques.

Cependant, si les chercheurs voulaient que le modèle capture si une personne porte des lunettes, mais l'ensemble de données d'entraînement ne contenait pas suffisamment de photos de personnes portant des lunettes, cette propriété serait perdue lors de la reconstruction de l'image. Ainsi, ils ont développé un auto-encodeur conditionnel, signifiant qu'ils pouvaient ajouter d'autres nombres au modèle qu'il n'avait pas acquis seul, représentant des caractéristiques sémantiques qui pourraient être pertinentes pour des publicités particulières.

"Ce qui est cool, c'est qu'une fois que nous avons entraîné le modèle à représenter des visages en 100 nombres, si nous modifions ensuite certains de ces nombres et les « décodions », nous pouvons changer de visage, " dit Thomas. " On peut ainsi transformer des visages existants pour qu'ils se ressemblent mais qu'ils aient des attributs différents, comme des lunettes, souriant ou pas, etc., juste en changeant certains des nombres que notre modèle utilise pour les représenter."

Faces publicitaires transformées en 5 catégories différentes. Crédit :Thomas &Kovashka

La formation de modèles génératifs pour la vision par ordinateur peut être une tâche difficile, nécessitant de grands ensembles de données d'images et échouant souvent lorsqu'ils sont entraînés sur des données très diverses, comme les publicités. Thomas et Kovashka ont surmonté ces limitations en utilisant un encodeur automatique qui nécessitait moins de données et pouvait faire face à la variance importante trouvée dans la publicité.

"Toutefois, parce qu'il n'y avait pas assez de données, il n'a pas toujours capturé les concepts que nous voulions dans ses représentations, " dit Thomas. " Ainsi, nous avons volontairement injecté de la sémantique dans sa représentation, ce qui a considérablement amélioré les résultats."

Leurs conclusions suggèrent qu'à l'avenir, les annonceurs pourront créer des publicités personnalisées et ciblées adaptées aux clients individuels. Par exemple, ils pourraient générer des visages avec des traits du visage qui correspondent à ceux du spectateur, afin qu'ils s'identifient davantage au sujet.

"Ce genre d'automatique, la personnalisation fine des annonces pourrait avoir d'énormes implications pour les annonceurs en ligne, " dit Thomas. " De plus, un annonceur qui ne souhaite pas embaucher un modèle supplémentaire pour son annonce ou effectuer des modifications manuelles peut être en mesure de transformer un visage existant d'une autre annonce en un visage approprié à son type d'annonce."

Faces publicitaires transformées en 17 catégories différentes. Crédit :Thomas &Kovashka

Les chercheurs explorent maintenant des moyens d'améliorer leurs images générées afin qu'elles correspondent à la qualité de celles produites à l'aide de plus grandes quantités de données. Pour faire ça, ils devront concevoir d'autres modèles génératifs plus robustes lorsqu'ils sont entraînés sur des données très variées et limitées.

"Un autre axe de recherche possible est de générer d'autres objets en plus des visages, ou même générer des publicités entières qui sont significatives et intéressantes, " explique Thomas. " Cela nécessiterait le développement de nouvelles techniques de modélisation de la structure rhétorique dans un cadre génératif, combiné avec la compréhension et la génération de texte."

© 2018 Tech Xplore