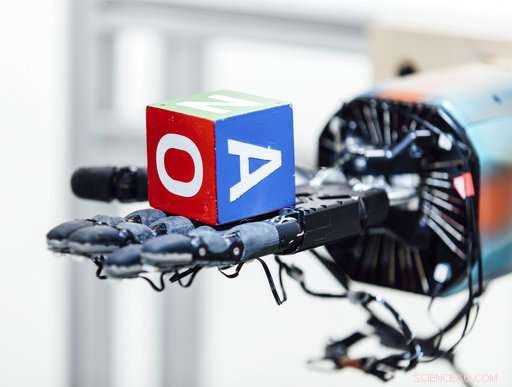

Cette photo non datée fournie par OpenAI montre une main robotique tenant un cube dans le laboratoire de recherche de l'entreprise à San Francisco. La main, appelé Dactyle, a un seul travail, et c'est pour faire tourner un cube jusqu'à ce que la lettre vers le haut corresponde à une sélection aléatoire. (Eric Louis Haines/OpenAI via AP)

Combien de temps faut-il à une main robotique pour apprendre à jongler avec un cube ?

Environ 100 ans, donner ou prendre.

C'est le temps de calcul virtuel qu'il a fallu aux chercheurs d'OpenAI, le laboratoire d'intelligence artificielle à but non lucratif financé par Elon Musk et d'autres, pour entraîner sa main désincarnée. L'équipe a payé 3 $ à Google, 500 pour exécuter son logiciel sur des milliers d'ordinateurs simultanément, réduire le temps réel à 48 heures. Après avoir entraîné le robot dans un environnement virtuel, l'équipe l'a mis à l'épreuve dans le monde réel.

La main, appelé Dactyle, appris à se déplacer, l'équipe de deux douzaines de chercheurs a révélé cette semaine. Son travail consiste simplement à ajuster le cube de sorte que l'une de ses lettres - "O, " ''P, " ''E, " ''N, " ''A" ou "I''—faces vers le haut pour correspondre à une sélection aléatoire.

Ken Goldberg, une université de Californie, professeur de robotique de Berkeley qui n'est pas affilié au projet, a déclaré que la réalisation d'OpenAI est un gros problème car elle démontre comment les robots entraînés dans un environnement virtuel peuvent fonctionner dans le monde réel. Son laboratoire essaie quelque chose de similaire avec un robot appelé Dex-Net, bien que sa main soit plus simple et les objets qu'il manipule soient plus complexes.

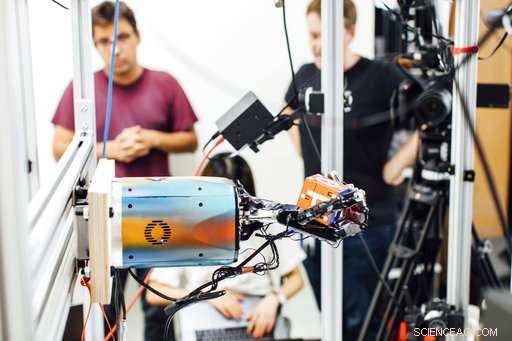

Cette photo non datée fournie par OpenAI montre une main robotique faisant tourner un cube dans le laboratoire de recherche de l'entreprise à San Francisco. La main, appelé Dactyle, a un seul travail, et c'est pour faire tourner un cube jusqu'à ce que la lettre vers le haut corresponde à une sélection aléatoire. (Eric Louis Haines/OpenAI via AP)

"La clé est l'idée que vous pouvez faire tant de progrès en simulation, " a-t-il dit. " C'est une voie à suivre plausible, quand faire des expériences physiques est très difficile."

Les doigts du monde réel de Dactyl sont suivis par des points infrarouges et des caméras. Dans la formation, chaque mouvement simulé qui rapprochait le cube du but donnait à Dactyl une petite récompense. Laisser tomber le cube lui a fait ressentir une pénalité 20 fois plus importante.

Le processus est appelé apprentissage par renforcement. Le logiciel du robot répète les tentatives des millions de fois dans un environnement simulé, essayer encore et encore pour obtenir la plus haute récompense. OpenAI a utilisé à peu près le même algorithme que celui utilisé pour battre les joueurs humains dans un jeu vidéo, "Dota 2."

Dans la vraie vie, une équipe de chercheurs a travaillé environ un an pour mettre la main mécanique à ce point.

Pourquoi?

En ce jeudi, 26 juillet 2018, photo, Le chercheur OpenAI Jonas Schneider examine la main robotique du laboratoire de recherche à San Francisco. La main, appelé Dactyle, a un seul travail, et c'est pour faire tourner un cube jusqu'à ce que la lettre vers le haut corresponde à une sélection aléatoire. (Photo AP/Ryan Nakashima)

Pour un, la main dans un environnement simulé ne comprend pas la friction. Alors même si ses vrais doigts sont caoutchouteux, Dactyl manque de compréhension humaine sur les meilleures poignées.

Les chercheurs ont injecté dans leur environnement simulé des changements de gravité, l'angle de la main et d'autres variables afin que le logiciel apprenne à fonctionner de manière adaptable. Cela a aidé à réduire l'écart entre les résultats du monde réel et ceux simulés, qui étaient bien mieux.

Les variations ont aidé la main à réussir à mettre la bonne lettre face visible plus d'une douzaine de fois de suite avant de laisser tomber le cube. En simulation, la main a généralement réussi 50 fois de suite avant que le test ne soit arrêté.

L'objectif d'OpenAI est de développer l'intelligence artificielle générale, ou des machines qui pensent et apprennent comme les humains, d'une manière sûre pour les personnes et largement distribuée.

Musk a averti que si les systèmes d'IA sont développés uniquement par des entreprises à but lucratif ou des gouvernements puissants, ils pourraient un jour dépasser l'intelligence humaine et être plus dangereux qu'une guerre nucléaire avec la Corée du Nord.

© 2018 La Presse Associée. Tous les droits sont réservés.