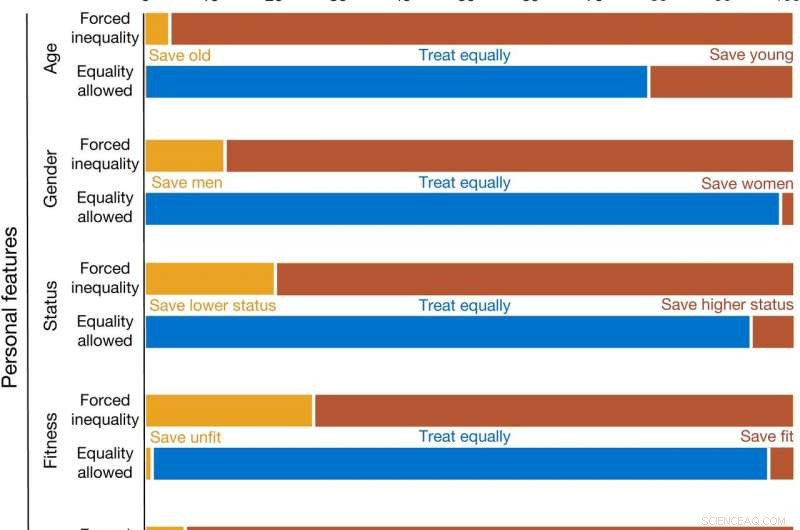

Les choix des gens sur la façon dont les véhicules autonomes devraient être programmés pour agir dans des situations où des vies humaines sont en jeu (étude 1). Crédit: La nature (2020). DOI :10.1038/s41586-020-1987-4

Une paire de chercheurs de l'Université de Caroline du Nord à Chapel Hill remet en question les conclusions de l'équipe qui a publié un article intitulé "The Moral Machine experiment" il y a deux ans. Yochanan Bigman et Kurt Gray affirment que les résultats de l'expérience étaient erronés car ils ne permettaient pas aux personnes testées de choisir de traiter les victimes potentielles de manière égale.

En 1967, Le philosophe britannique Phillippa Foot a décrit le « Problème du chariot, " qui présentait un scénario dans lequel un chariot courait vers des personnes sur les rails qui étaient sur le point d'être tuées. cette piste est remplie, également. Le problème pose alors des dilemmes moraux au conducteur, comme s'il est plus raisonnable de tuer cinq personnes plutôt que deux, ou s'il est préférable de tuer des personnes âgées plutôt que des jeunes.

Il y a deux ans, une équipe du MIT a revisité ce problème dans le cadre de la programmation d'un véhicule autonome. Si vous étiez le programmeur au lieu du conducteur du chariot, comment programmeriez-vous la voiture pour qu'elle réagisse dans diverses conditions ? L'équipe a signalé que, comme prévu, la plupart des volontaires qui ont passé le test programmeraient la voiture pour écraser des animaux plutôt que des personnes, les personnes âgées au lieu des jeunes, des hommes plutôt que des femmes, etc. Dans ce nouvel effort, Bigman et Gray contestent les conclusions de l'équipe du MIT car ils suggèrent que les réponses ne représentaient pas vraiment les souhaits des volontaires. Ils suggèrent que ne pas donner aux candidats une troisième option – traiter tout le monde sur un pied d'égalité – fausse les résultats.

Pour savoir si donner une troisième réponse aux utilisateurs a donné des résultats plus égalitaires, les chercheurs ont mené une expérience similaire à celle du MIT, mais a donné aux utilisateurs la possibilité de choisir de ne montrer aucune préférence sur qui serait écrasé et qui serait épargné. Ils ont constaté que la plupart des volontaires ont choisi la troisième option dans la plupart des scénarios. Ils suggèrent que leurs résultats indiquent que les tests à choix forcé ne révèlent pas les véritables souhaits du grand public.

© 2020 Réseau Science X