Crédit :Zhang et al.

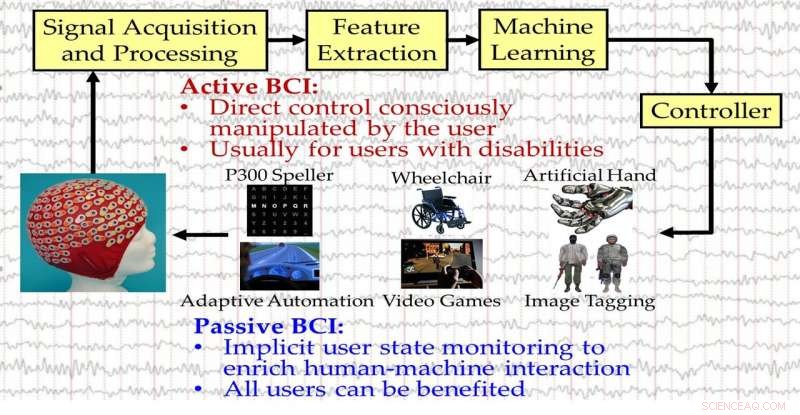

Les interfaces cerveau-ordinateur (BCI) sont des outils qui peuvent connecter le cerveau humain à un appareil électronique, utilisant généralement l'électroencéphalographie (EEG). Dans les années récentes, les progrès de l'apprentissage automatique (ML) ont permis le développement d'orthographes BCI plus avancées, dispositifs qui permettent aux gens de communiquer avec les ordinateurs en utilisant leurs pensées.

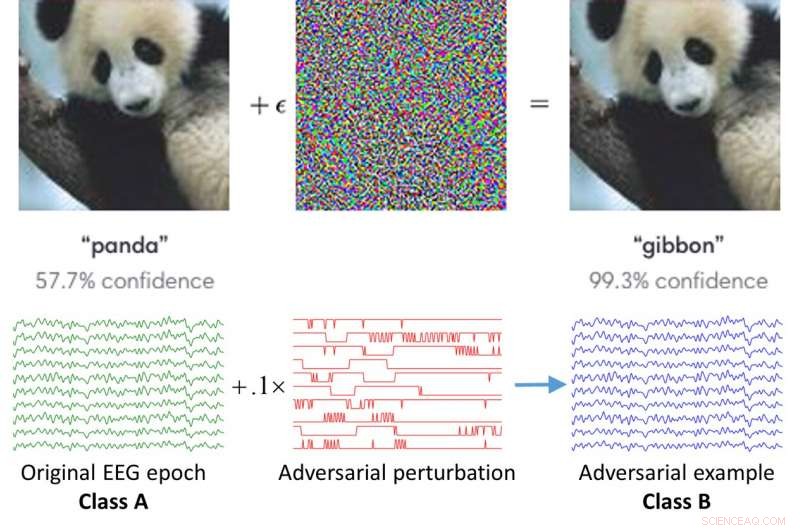

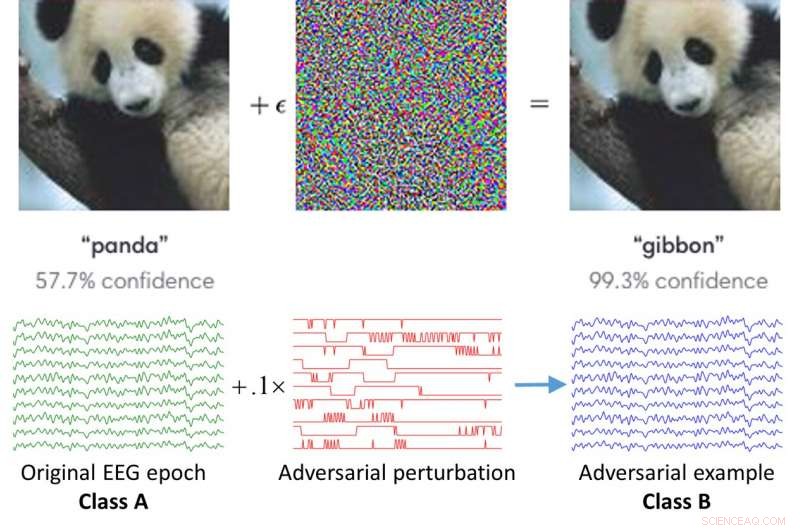

Jusque là, la plupart des études dans ce domaine se sont concentrées sur le développement de classificateurs BCI plus rapides et plus fiables, plutôt que d'enquêter sur leurs éventuelles failles de sécurité. Recherche récente, cependant, suggère que les algorithmes d'apprentissage automatique peuvent parfois être trompés par des attaquants, s'ils sont utilisés en vision par ordinateur, reconnaissance de la parole, ou d'autres domaines. Cela se fait souvent à l'aide d'exemples contradictoires, qui sont de minuscules perturbations dans les données qui sont indiscernables par les humains.

Des chercheurs de l'Université des sciences et technologies de Huazhong ont récemment mené une étude sur la sécurité des orthographes BCI basées sur l'EEG, et plus précisément, comment ils sont affectés par les perturbations accusatoires. Leur papier, prépublié sur arXiv, suggère que les orthographes BCI sont dupés par ces perturbations et sont donc très vulnérables aux attaques adverses.

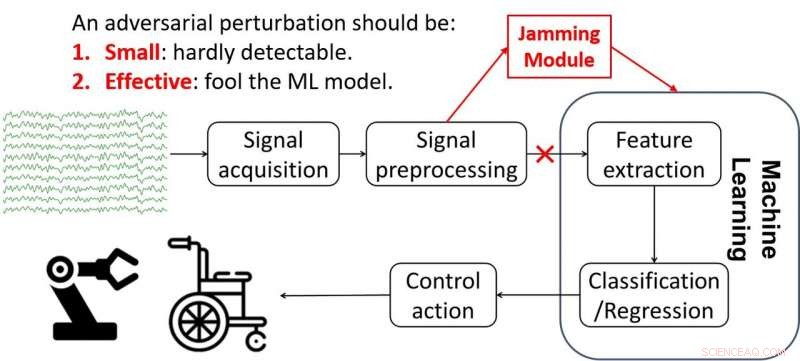

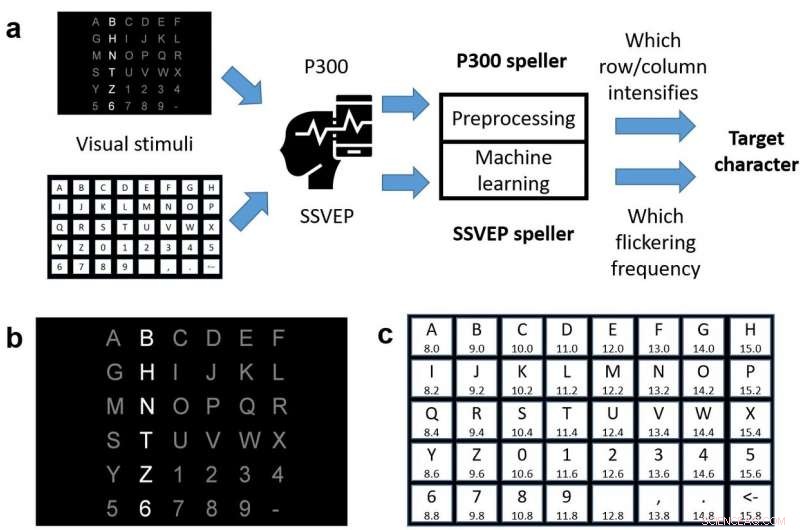

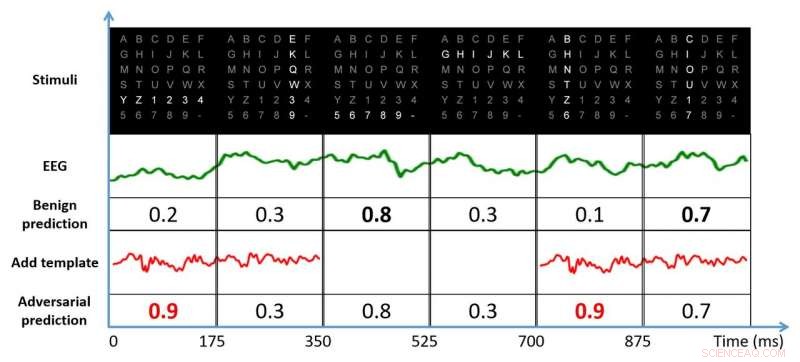

"Cet article vise à exposer un problème de sécurité critique dans les orthographes BCI basés sur EEG et plus largement, BCI basés sur l'EEG, qui a reçu peu d'attention auparavant, " Dongrui Wu, l'un des chercheurs qui a mené l'étude, a déclaré TechXplore. « Cela montre que l'on peut générer de minuscules modèles de perturbation EEG contradictoires pour les attaques de cibles pour les orthographes P300 et à potentiel évoqué visuel à l'état d'équilibre (SSVEP), c'est à dire., tromper la classification à n'importe quel personnage que l'attaquant veut, quel que soit le caractère voulu par l'utilisateur."

Crédit :Zhang et al.

Les orthographes P300 BCI sont déjà utilisées dans plusieurs contextes, y compris dans les cliniques, pour évaluer ou détecter des troubles de la conscience. Les attaques contradictoires contre les orthographes BCI pourraient ainsi avoir de nombreuses conséquences, allant de simples problèmes d'utilisation à de graves erreurs de diagnostic des patients.

"Nous pensons qu'une compréhension nouvelle et plus détaillée de la manière dont les perturbations EEG adverses affectent la classification BCI peut informer la conception des BCI pour se défendre contre de telles attaques, " expliqua Wu.

Wu et ses collègues ont découvert que pour mener à bien une attaque contradictoire contre un orthographe BCI, l'attaquant n'a besoin d'accéder qu'à certaines des données utilisées pour entraîner l'appareil. Il peut utiliser ces données pour entraîner le modèle de perturbation, ajoutant ensuite le modèle aux essais EEG bénins pour effectuer l'attaque.

Les approches actuelles pour mener des attaques contradictoires ont deux limitations principales. D'abord, ils nécessitent des échantillons EEG spécifiques au sujet pour créer le modèle de perturbation contradictoire. Seconde, pour effectuer l'attaque plus efficacement, l'attaquant doit connaître le moment exact du stimulus EEG. Si l'attaquant réussit à surmonter ces limitations, l'impact de son attaque pourrait être bien plus grand.

Crédit :Zhang et al.

« Défendre les attaques adverses est un problème de recherche courant dans de nombreuses applications de l'apprentissage automatique, par exemple., vision par ordinateur, reconnaissance de la parole, et BCI, " dit Wu. " Si nous connaissons l'approche de l'attaquant, alors nous pouvons développer des stratégies pour nous en défendre, tout comme la façon dont nous nous défendons contre les virus informatiques :un virus éclate d'abord, puis nous trouvons des moyens de le tuer."

Les attaquants essaient toujours de trouver de nouvelles façons de contourner les mesures de sécurité, il est donc important pour les chercheurs de continuer à enquêter sur les vulnérabilités du système et de proposer de nouvelles mesures de sécurité. S'il est inévitable que des solutions de sécurité ciblées soient développées après qu'une vulnérabilité spécifique a été identifiée, découvrir des problèmes généraux avec un système et prendre des précautions peut être très utile.

L'étude menée par Wu et ses collègues a permis de dévoiler les risques de sécurité généraux associés aux BCI basés sur l'EEG. Leurs résultats pourraient aider à identifier des solutions provisoires qui pourraient réduire l'impact des attaques contradictoires sur ces appareils.

Crédit :Zhang et al.

Crédit :Zhang et al.

Crédit :Zhang et al.

Wu et ses collègues espèrent que leurs recherches encourageront d'autres personnes à étudier les limites et les vulnérabilités des orthographes basées sur l'EEG ou d'autres appareils BCI. Leurs conclusions pourraient à terme ouvrir la voie au développement de techniques pour renforcer la sécurité des BCI, prévenir les erreurs de diagnostic et autres effets indésirables des attaques contradictoires.

"Nous voulons souligner que le but de cette étude n'est pas d'endommager les BCI basés sur l'EEG, mais pour démontrer que de graves attaques contradictoires contre les BCI basés sur l'EEG sont possibles et donc exposer un problème de sécurité critique qui n'a reçu que peu d'attention auparavant, " Wu a dit. " Dans nos recherches futures, nous prévoyons de développer des stratégies pour nous défendre contre de telles attaques. Pendant ce temps, nous espérons que notre étude pourra attirer l'attention de plus de chercheurs sur la sécurité des BCI basés sur l'EEG."

© 2020 Réseau Science X