Les entreprises technologiques ont un impératif économique d'éviter de se débattre trop sérieusement avec les problèmes éthiques liés à l'utilisation des données. Crédit :Shutterstock

Notre relation avec les entreprises technologiques a considérablement changé au cours des 18 derniers mois. Les violations de données en cours, et les révélations entourant le scandale Cambridge Analytica, ont soulevé des inquiétudes quant à la propriété de nos données, et comment il est utilisé et partagé.

Les entreprises technologiques se sont engagées à faire mieux. Après ses grillades par le Congrès américain et le Parlement européen, PDG de Facebook, Mark Zuckerberg, a déclaré que Facebook changera la façon dont il partage les données avec des fournisseurs tiers. Il existe des preuves que cela se produit, notamment avec les annonceurs.

Mais les entreprises technologiques ont-elles vraiment changé leurs habitudes ? Après tout, les données sont désormais un atout primordial dans l'économie moderne.

Pour déterminer s'il y a eu un réalignement significatif entre les attentes de la communauté et le comportement de l'entreprise, nous avons analysé les principes d'éthique des données et les initiatives que diverses organisations mondiales ont engagées depuis l'éclatement des divers scandales.

Ce que nous avons trouvé est préoccupant. Certaines des plus grandes organisations n'ont pas manifestement modifié leurs pratiques, au lieu de s'inscrire à des initiatives d'éthique qui ne sont ni appliquées ni exécutoires.

Comment nous avons suivi ces informations

Avant de discuter de nos conclusions, quelques précisions.

Premièrement, les problèmes de données, intelligence artificielle (IA), l'apprentissage automatique et les algorithmes sont difficiles à distinguer, et leur portée est contestée. En réalité, pour la plupart de ces organisations, les concepts sont regroupés, tandis que pour les chercheurs et les décideurs, ils présentent des défis nettement différents.

Par exemple, apprentissage automatique, tandis qu'une branche de l'IA, consiste à construire des machines pour apprendre par elles-mêmes sans supervision. En tant que tel, les décideurs politiques doivent s'assurer que les algorithmes d'apprentissage automatique sont exempts de biais et prennent en considération diverses questions sociales et économiques, plutôt que de traiter tout le monde de la même manière.

Deuxièmement, les politiques, les déclarations et les directives des entreprises que nous avons examinées ne sont pas situées au centre, présenté de manière cohérente ou simple à déchiffrer.

Tenant compte du manque d'approche cohérente de l'éthique des données adoptée par les entreprises technologiques, notre méthode consistait à recenser les étapes visibles entreprises, et d'examiner les grands principes éthiques adoptés.

Cinq grandes catégories d'éthique des données

Certaines entreprises, comme Microsoft, IBM, et Google, ont publié leurs propres principes éthiques en matière d'IA.

Plus d'entreprises, dont Facebook et Amazon, ont choisi de garder une approche indépendante de l'éthique en rejoignant des consortiums, tels que le Partenariat sur l'IA (PAI) et le Conseil de l'industrie de l'information et de la technologie (ITI). Ces deux consortiums ont publié des déclarations contenant des principes éthiques. Les principes sont volontaires, et n'ont aucune exigence de déclaration, des normes objectives ou une surveillance.

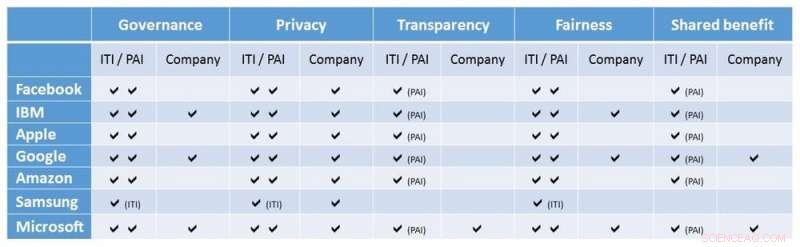

Initiatives de grandes entreprises technologiques ont souscrit à des catégories particulières d'éthique des données. Auteur fourni

Nous avons examiné le contenu des lignes directrices éthiques publiées par ces entreprises et consortiums, et a constaté que les principes se répartissaient en cinq grandes catégories.

L'équité et la transparence sont importantes

Notre recherche suggère que les conversations sur l'éthique des données sont largement axées sur la confidentialité et la gouvernance. Mais ces principes sont le minimum attendu dans un cadre légal. Si quoi que ce soit, les scandales du passé nous ont montré que cela ne suffit pas.

Facebook est remarquable en tant qu'entreprise gardant une approche indépendante de l'éthique. Il est membre du Partenariat sur l'IA et du Conseil de l'industrie de l'information et de la technologie, mais a évité la publication de ses propres principes d'éthique des données. Et bien qu'il y ait eu des rumeurs sur un soi-disant détecteur de biais d'apprentissage automatique "Fairness Flow", et les rumeurs d'une équipe d'éthique chez Facebook, les détails de l'un ou l'autre de ces développements sont sommaires.

Pendant ce temps, la mesure dans laquelle le Partenariat sur l'IA et le Conseil de l'industrie de l'information et de la technologie influencent le comportement des entreprises membres est très discutable. Le Partenariat sur l'IA, qui compte plus de 70 membres, a été formé en 2016, mais il n'a pas encore démontré de résultats tangibles au-delà de la publication de principes clés.

Une meilleure réglementation est nécessaire

Pour les entreprises technologiques, il peut y avoir un compromis entre traiter les données de manière éthique et combien d'argent ils peuvent gagner à partir de ces données. Il existe également un manque de consensus entre les entreprises sur ce à quoi ressemble la bonne approche éthique. Donc, afin de protéger le public, des conseils et une surveillance externes sont nécessaires.

Malheureusement, le gouvernement a actuellement maintenu son attention sur la nouvelle législation du gouvernement australien sur le partage et la diffusion des données sur la confidentialité – un principe qui est couvert par la législation ailleurs.

Les événements liés aux données de ces dernières années ont confirmé que nous devons nous concentrer davantage sur les données en tant que droit des citoyens, pas seulement un droit du consommateur. En tant que tel, nous devons mettre davantage l'accent sur l'équité, transparence et partage des avantages – autant de domaines qui sont actuellement négligés par les entreprises et les gouvernements.

Cet article est republié à partir de The Conversation sous une licence Creative Commons. Lire l'article original.