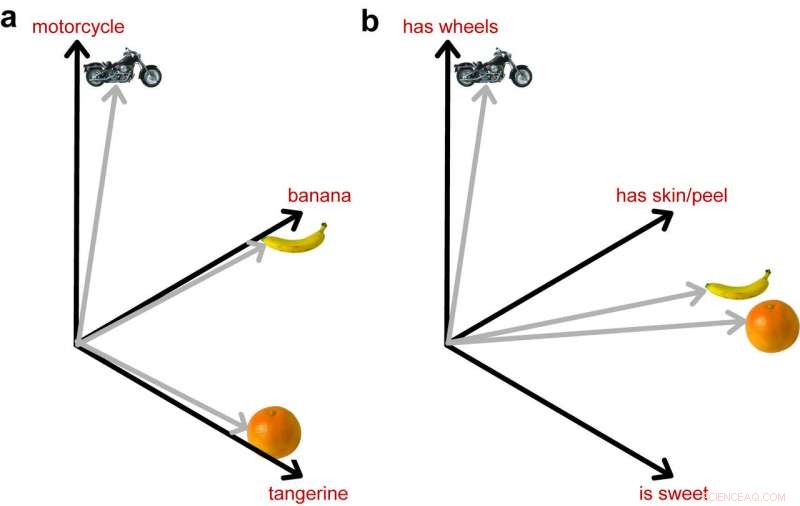

L'image de gauche montre comment les DNN formés pour identifier des objets représentent ces 3 images comme également différentes. L'image de droite montre le rôle important que joue l'information sémantique en rapprochant les deux fruits dans l'espace, car ils sont plus proches dans leur sens. Crédit :Lorraine Tyler et al.

Des chercheurs en neurosciences de l'Université de Cambridge ont combiné la vision par ordinateur avec la sémantique, développer un nouveau modèle qui pourrait aider à mieux comprendre comment les objets sont traités dans le cerveau.

La capacité humaine de reconnaître des objets implique deux processus principaux, une analyse visuelle rapide de l'objet et l'activation des connaissances sémantiques acquises tout au long de la vie. La plupart des études antérieures ont étudié ces deux processus séparément; donc, leur interaction reste largement incertaine.

L'équipe de chercheurs basés à Cambridge a étudié les processus de reconnaissance d'objets à l'aide d'une nouvelle méthode qui combine des réseaux de neurones profonds avec un modèle sémantique de réseau attracteur. Contrairement à la plupart des études précédentes, leur technique rend compte à la fois des informations visuelles et des connaissances conceptuelles sur les objets.

« Auparavant, nous avions mené de nombreuses recherches auprès de personnes en bonne santé et de patients atteints de lésions cérébrales pour mieux comprendre comment les objets sont traités dans le cerveau, " les chercheurs de Cambridge ont déclaré Tech Xplore . « L'un des apports majeurs de ce travail est de montrer que comprendre ce qu'est un objet implique que l'entrée visuelle se transforme rapidement au fil du temps en une représentation signifiante, et ce processus de transformation s'accomplit le long du lobe temporal ventral."

Les chercheurs croient fermement que l'accès à la mémoire sémantique est un élément clé pour comprendre ce qu'est un objet, les théories qui se concentrent uniquement sur les propriétés liées à la vision ne capturent donc pas pleinement ce processus complexe.

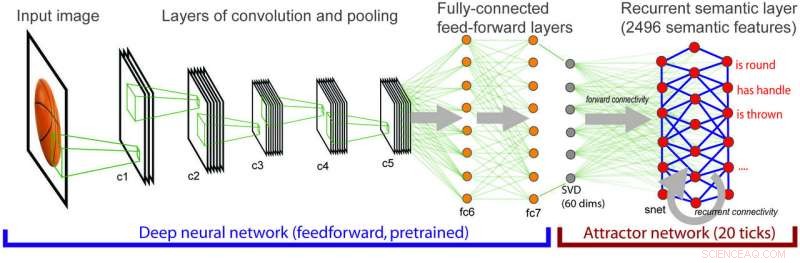

Architecture du modèle intégré où des informations visuelles de plus en plus complexes se superposent à des informations sémantiques. Crédit :Lorraine Tyler et al.

« Ce fut le déclencheur initial de la recherche actuelle, où nous voulions bien comprendre comment les entrées visuelles de bas niveau sont mappées sur une représentation sémantique de la signification de l'objet, " ont expliqué les chercheurs. Pour ce faire, ils ont utilisé un réseau de neurones profonds standard spécialisé dans la vision par ordinateur, appelé AlexNet.

"Ce modèle, et d'autres aiment ça, peut identifier des objets dans des images avec une très grande précision, mais ils n'incluent aucune connaissance explicite sur les propriétés sémantiques des objets, " expliquèrent-ils. " Par exemple, les bananes et les kiwis sont très différents dans leur apparence (couleur différente, forme, texture, etc) mais néanmoins, nous comprenons bien qu'ils sont tous deux des fruits. Les modèles de vision par ordinateur peuvent faire la distinction entre les bananes et les kiwis, mais ils n'encodent pas la connaissance plus abstraite que les deux sont des fruits."

Reconnaissant les limites des réseaux de neurones pour la vision par ordinateur, les chercheurs ont combiné l'algorithme de vision AlexNet avec un réseau de neurones qui analyse la signification conceptuelle, y compris la connaissance sémantique dans l'équation.

« Dans le modèle combiné, le traitement visuel s'aligne sur le traitement sémantique et active nos connaissances sémantiques sur les concepts, ", ont déclaré les chercheurs.

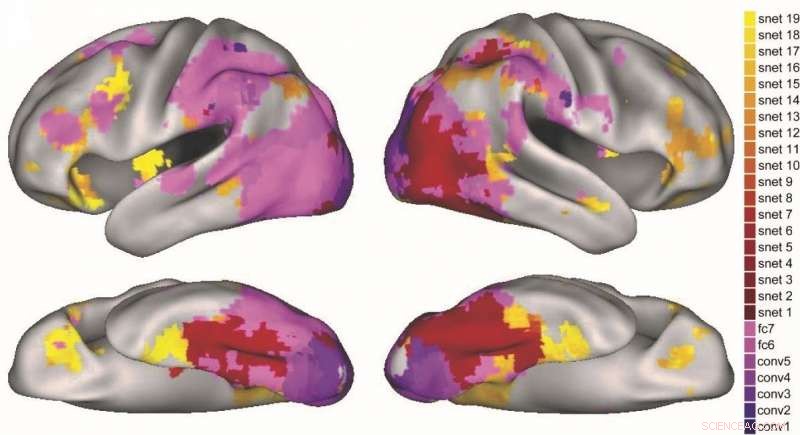

Leur nouvelle technique a été testée sur les données de neuroimagerie de 16 volontaires, à qui on avait demandé de nommer des images d'objets alors qu'ils passaient une IRMf. Par rapport aux modèles de vision traditionnels des réseaux de neurones profonds (DNN), la nouvelle méthode a permis d'identifier les zones cérébrales associées au traitement visuel et sémantique.

Comment différentes couches du DNN visuel (violet) et du réseau d'attracteurs sémantiques (rouge-jaune) correspondent à différentes régions du cerveau. Crédit :Lorraine Tyler et al.

La méthode qu'ils ont conçue a fait des prédictions sur les étapes de l'activation sémantique dans le cerveau qui sont cohérentes avec les comptes rendus précédents du traitement des objets, où un traitement sémantique plus grossier cède la place à un traitement plus fin. Les chercheurs ont également découvert que différentes étapes du modèle prédisaient l'activation dans différentes régions de la voie de traitement des objets du cerveau.

"Finalement, de meilleurs modèles de la façon dont les gens traitent les objets visuels de manière significative peuvent avoir des implications cliniques pratiques; par exemple, dans la compréhension de conditions telles que la démence sémantique, où les gens perdent leur connaissance du sens des concepts d'objets, ", ont déclaré les chercheurs.

L'étude menée à Cambridge est une contribution importante au domaine des neurosciences, car il a montré comment différentes régions du cerveau contribuent au traitement visuel et sémantique des objets.

"Il est maintenant vital d'étudier comment l'information dans une région peut être transformée en un état différent que nous voyons dans différentes régions du cerveau, " ont ajouté les chercheurs. " Pour cela, nous devons comprendre comment la connectivité, et la dynamique temporelle soutiennent ces processus neuronaux transformateurs."

La recherche a été publiée dans Rapports scientifiques récemment.

© 2018 Tech Xplore