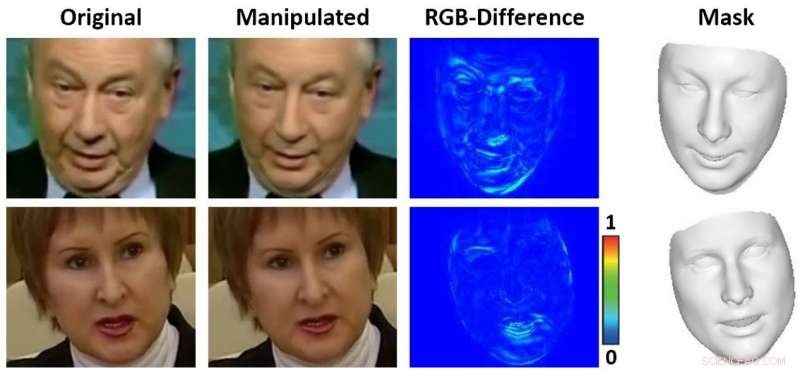

Faux ou réel ? Exemples de l'ensemble de données d'auto-reconstitution FaceForensics. De gauche à droite :image d'entrée originale, image de sortie reproduite automatiquement, tracé de différence de couleur et masque facial utilisé lors de la synthèse de l'image de sortie. Crédit :arXiv : 1803.09179 [cs.CV]

La manipulation d'images à ce stade avancé de l'ère numérique n'est pas aussi amusante mais une arme risquée, dans l'ombre des fake news, pour influencer l'opinion et déclencher des scandales.

Échange de visage, en particulier, Cela semble amusant si vous y pensez comme un rire à une table familiale pendant que les enfants et les adultes essaient différents visages sur différentes personnes. Cependant, c'est aussi un outil pour des motifs bien pires. Swapna Krishna dans Engagé a fait remarquer que « Les gens ont, bien sûr, profité de cet outil pour des usages dérangeants, y compris échanger des visages dans des vidéos pornographiques - le porno de vengeance ultime. "

Dans Examen de la technologie du MIT , la "Technologie émergente de l'arXiv" a déclaré, "des vidéos pornographiques appelées 'deepfakes' sont apparues sur des sites Web montrant des visages d'individus célèbres superposés sur des corps d'acteurs."

Des chercheurs, cependant, intéressé à explorer l'outil et comment savoir s'il est utilisé, ont mis au point un algorithme, disent les observateurs, qui peut surpasser les autres techniques disponibles. Ils ont trouvé un moyen de détecter un échange de visage via l'algorithme, ramasser les vidéos falsifiées dès leur publication.

Analytique Vidhya commenté, "Quelque chose de semblable à cet algorithme était désespérément nécessaire pour mener la bataille contre les échanges de visages utilisés pour de mauvaises raisons. En publiant le document de recherche au public, les chercheurs espèrent que d'autres prendront également le relais et travailleront sur cette étude pour la rendre plus exacte et précise. »

Andreas Rossler était le chef d'équipe des participants de l'Université technique de Munich, Université Federico II de Naples et l'Université d'Erlangen-Nuremberg.

Ils ont entraîné l'algorithme, XceptionNet, en utilisant un grand nombre d'échanges de visages, mentionné Engagé .

« Nous avons établi une base solide de résultats pour détecter une manipulation faciale avec des architectures modernes d'apprentissage en profondeur, " a déclaré Rossler et son équipe Examen de la technologie du MIT . La taille comptait.

La taille de cette base de données était une amélioration significative par rapport à ce qui était auparavant disponible. "Nous introduisons un nouvel ensemble de données de vidéos manipulées qui dépasse tous les ensembles de données médico-légales disponibles au public par des ordres de grandeur, " a déclaré Rossler.

Dans leur papier, les auteurs ont déclaré avoir introduit un ensemble de données de manipulation de visage, FaceForensics, "d'environ un demi-million d'images éditées (à partir de plus de 1000 vidéos)."

L'article est intitulé "FaceForensics:A Large-scale Video Dataset for Forgery Detection in Human Faces, " sur arXiv. Les auteurs sont Andreas Rössler, Davide Cozzolino, Luisa Verdoliva, Christian Riess, Justus Thies et Matthias Nießner.

Les auteurs ont attiré l'attention sur la difficulté - pour les humains et les ordinateurs - d'essayer de faire la distinction entre la vidéo originale et la vidéo manipulée, "surtout lorsque les vidéos sont compressées ou ont une faible résolution, comme cela arrive souvent sur les réseaux sociaux."

Ils ont également attiré l'attention sur le fait que "la recherche sur la détection des manipulations faciales a été sérieusement entravée par le manque d'ensembles de données adéquats".

Il y a une nuance dans leur succès, bien que, cela mérite aussi l'attention. L'article "Emerging Technology from the arXiv" l'appelait "la piqûre dans la queue". Qu'est-ce que c'est? "La même technique d'apprentissage en profondeur qui permet de repérer les vidéos d'échange de visage peut également être utilisée pour améliorer la qualité des échanges de visage en premier lieu, ce qui pourrait les rendre plus difficiles à détecter."

Engagé dit de même, "XceptionNet surpasse clairement ses techniques concurrentes dans la détection de ce genre de fausse vidéo, mais cela améliore également la qualité des contrefaçons. L'équipe de Rossler peut utiliser les plus grandes caractéristiques d'un échange de visage pour rendre la manipulation plus transparente. Cela ne trompe pas XceptionNet, mais sur le long terme, cela pourrait rendre plus difficile pour d'autres méthodes de détecter les vidéos truquées."

Pranav Dar, dans Analytique Vidhya , a également pesé sur ce qu'il a appelé "une mise en garde avec cet algorithme - il peut également potentiellement être utilisé pour améliorer la qualité des échanges de visages, ce qui rendra plus difficile la détection du faux. En outre, dès qu'un algorithme de détection de faux est lancé, les escrocs essaient toujours d'affiner leur modèle pour garder une longueur d'avance."

Néanmoins, les auteurs ont dit, "notre raffineur améliore principalement la qualité visuelle, mais cela n'encombre que légèrement la détection de falsification pour une méthode d'apprentissage en profondeur formée exactement sur les données de sortie falsifiées."

© 2018 Tech Xplore