La haine en ligne fait toujours rage, souvent à la vue. Crédit :maxicam/Shutterstock.com

Peu de temps après la fusillade dans la synagogue de Pittsburgh, J'ai remarqué que le mot « juifs » était à la mode sur Twitter. En tant que chercheur et éducateur en médias sociaux, J'ai eu peur que la violence ne se propage en ligne, comme par le passé.

L'activité du tireur présumé de la synagogue sur le site de médias sociaux Gab a attiré l'attention sur le rôle de ce site en tant qu'alternative haineuse aux options plus traditionnelles comme Facebook et Twitter. Celles-ci font partie des plateformes de médias sociaux qui ont promis de lutter contre les discours de haine et les abus en ligne sur leurs sites.

Cependant, alors que j'explorais l'activité en ligne à la suite de la fusillade, il est vite devenu clair pour moi que les problèmes ne sont pas seulement sur des sites comme Gab. Plutôt, le discours de haine est toujours facile à trouver sur les sites de médias sociaux grand public, y compris Twitter. J'ai également identifié quelques mesures supplémentaires que l'entreprise pourrait prendre.

Réponses incomplètes aux nouveaux termes haineux

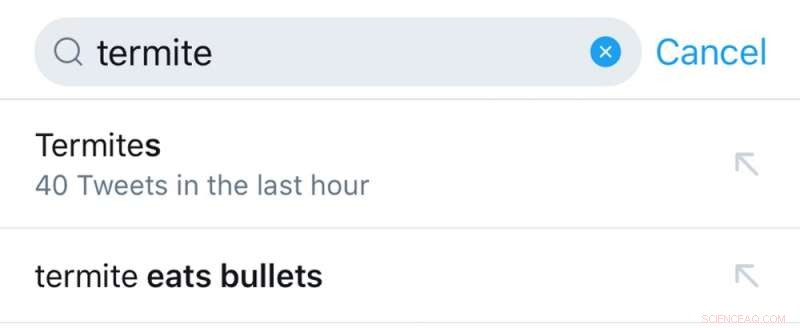

Je m'attendais à ce que de nouvelles menaces apparaissent en ligne concernant la fusillade de Pittsburgh, et il y avait des signes qui se produisaient. Lors d'une récente attaque antisémite, Le leader de Nation of Islam, Louis Farrakhan, a utilisé le mot « termite » pour décrire le peuple juif. j'ai recherché ce terme, sachant que les racistes étaient susceptibles d'utiliser la nouvelle insulte comme mot de code pour éviter d'être détectés lorsqu'ils exprimaient de l'antisémitisme.

Twitter n'avait pas suspendu le compte de Farrakhan à la suite d'une énième de ses déclarations antisémites, et la fonction de recherche de Twitter a automatiquement suggéré que je cherchais l'expression "les termites mangent des balles". Cela transforme le champ de recherche de Twitter en un panneau d'affichage de discours haineux.

La société avait, cependant, apparemment ajusté certains de ses algorithmes internes, car aucun tweet avec des utilisations antisémites du mot "termite" n'est apparu dans mes résultats de recherche.

Crédit :Jennifer Grygiel, CC BY-ND

Des articles passés inaperçus pendant des années

Alors que je poursuivais mes recherches de discours de haine et d'appels à la violence contre le peuple juif, J'ai trouvé des preuves encore plus troublantes de lacunes dans le système de modération de contenu de Twitter. À la suite des élections américaines de 2016 et de la découverte que Twitter était utilisé pour influencer les élections, la société a déclaré qu'elle investissait dans l'apprentissage automatique pour "détecter et atténuer l'effet sur les utilisateurs de faux, coordonné, et l'activité de compte automatisée." D'après ce que j'ai trouvé, ces systèmes n'ont pas identifié même très simple, menaces violentes claires et directes et discours de haine qui sont sur son site depuis des années.

Lorsque j'ai signalé un tweet publié en 2014 qui préconisait de tuer des Juifs « pour le plaisir, " Twitter l'a retiré le même jour – mais son avis automatisé standard sur Twitter n'a pas expliqué pourquoi il n'avait pas été touché pendant plus de quatre ans.

Déteste les jeux du système

Lorsque j'ai examiné des tweets haineux qui n'avaient pas été détectés après toutes ces années, J'ai remarqué que beaucoup ne contenaient aucun texte – le tweet n'était qu'une image. Sans texte, les tweets sont plus difficiles pour les utilisateurs, et les propres algorithmes d'identification de la haine de Twitter, trouver. Mais les utilisateurs qui recherchent spécifiquement les discours de haine sur Twitter peuvent alors faire défiler l'activité des comptes qu'ils trouvent, voir des messages encore plus haineux.

Twitter semble être conscient de ce problème :les utilisateurs qui signalent un tweet sont invités à examiner quelques autres tweets du même compte et à les soumettre en même temps. Cela finit par soumettre un peu plus de contenu à la révision, mais laisse encore de la place à certains pour passer inaperçus.

Aide aux géants de la technologie en difficulté

Comme j'ai trouvé des tweets qui, selon moi, enfreignaient les politiques de Twitter, Je les ai signalés. La plupart d'entre eux ont été retirés rapidement, même en une heure. Mais certains messages manifestement offensants ont mis plusieurs jours à tomber. Il y a encore quelques tweets textuels qui n'ont pas été supprimés, malgré une violation flagrante des politiques de Twitter. Cela montre que le processus d'examen du contenu de l'entreprise n'est pas cohérent.

Un exemple de tweet haineux autorisé à rester sur Twitter pendant plus de quatre ans. Crédit :Jennifer Grygiel, CC BY-ND

Il peut sembler que Twitter s'améliore pour supprimer le contenu nuisible et qu'il supprime beaucoup de contenu et de mèmes et suspend des comptes, mais une grande partie de cette activité n'est pas liée au discours de haine. Plutôt, Une grande partie de l'attention de Twitter s'est portée sur ce que l'entreprise appelle « la manipulation coordonnée, " comme les bots et les réseaux de faux profils gérés par les unités de propagande du gouvernement.

À mon avis, l'entreprise pourrait prendre une mesure importante pour solliciter l'aide des membres du public, ainsi que des chercheurs et experts comme mes collègues et moi, pour identifier les contenus haineux. Il est courant que les entreprises technologiques, y compris Twitter, proposent des paiements aux personnes qui signalent des failles de sécurité dans leurs logiciels. Cependant, tout ce que l'entreprise fait pour les utilisateurs qui signalent un contenu problématique est d'envoyer un message généré automatiquement disant "merci". La disparité dans la façon dont Twitter traite les problèmes de code et les rapports de contenu envoie un message que l'entreprise donne la priorité à sa technologie par rapport à sa communauté.

Au lieu, Twitter pourrait payer des personnes pour signaler du contenu qui enfreint les règles de sa communauté, offrir des récompenses financières pour éliminer les vulnérabilités sociales de son système, comme si ces utilisateurs l'aidaient à identifier les problèmes logiciels ou matériels. Un cadre de Facebook s'est dit préoccupé par le fait que cette solution potentielle pourrait se retourner contre elle et générer plus de haine en ligne, mais je crois que le programme de récompense pourrait être structuré et conçu de manière à éviter ce problème.

Beaucoup plus à faire

Il y a d'autres problèmes avec Twitter qui vont au-delà de ce qui est affiché directement sur son propre site. Les personnes qui publient des propos haineux profitent souvent d'une caractéristique clé de Twitter :la capacité des tweets à inclure des liens vers d'autres contenus Internet. Cette fonction est au cœur de la façon dont les gens utilisent Twitter, partager du contenu d'intérêt commun sur le Web. Mais c'est aussi une méthode de diffusion de discours haineux.

Par exemple, un tweet peut sembler totalement innocent, en disant "C'est drôle" et en fournissant un lien. Mais le lien – vers du contenu non publié sur les serveurs de Twitter – fait apparaître un message haineux.

En outre, Le système de modération de contenu de Twitter permet uniquement aux utilisateurs de signaler les tweets haineux et menaçants, mais pas les comptes dont les profils eux-mêmes contiennent des messages similaires. Certains de ces comptes - y compris ceux avec des photos de profil d'Adolf Hitler, et les noms et les pseudonymes de Twitter qui préconisent de brûler les Juifs – ne publiez même pas de tweets ou ne suivez pas d'autres utilisateurs de Twitter. Parfois, ils peuvent simplement exister pour être trouvés lorsque les gens recherchent des mots dans leurs profils, transformant à nouveau le champ de recherche de Twitter en un système de diffusion. Ces comptes peuvent également - bien qu'il soit impossible à savoir - être utilisés pour communiquer avec d'autres sur Twitter via un message direct, en utilisant la plate-forme comme canal de communication secret.

Sans tweets ou autre activité publique, il est impossible pour les utilisateurs de signaler ces comptes via le système de rapport de contenu standard. Mais ils sont tout aussi offensants et nuisibles – et doivent être évalués et modérés comme les autres contenus du site. Alors que les personnes cherchant à répandre la haine deviennent de plus en plus sophistiquées, Les directives communautaires de Twitter - mais plus important encore ses efforts d'application - doivent rattraper leur retard, et continuez.

Si les sites de médias sociaux veulent éviter de devenir - ou de rester - des vecteurs de guerre de l'information et des fléaux d'idées et de mèmes haineux, ils doivent s'intensifier beaucoup plus activement et, tout au moins, demandez à leurs milliers d'employés de modération de contenu à temps plein de rechercher comme un professeur l'a fait au cours d'un week-end.

Cet article est republié à partir de The Conversation sous une licence Creative Commons. Lire l'article original.