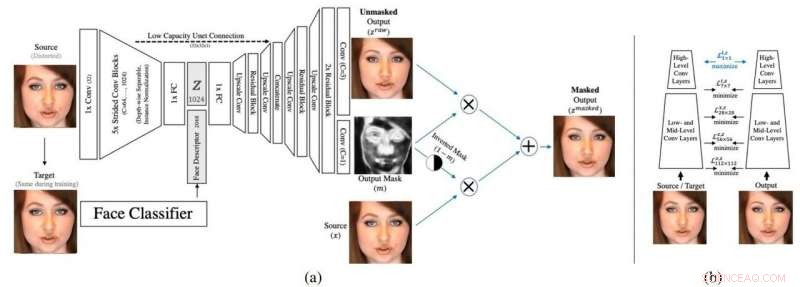

(a) L'architecture du réseau. Pour le conditionnement, un réseau de reconnaissance faciale pré-entraîné est utilisé. (b) Une illustration de la perte de perception multi-images utilisée, qui utilise deux répliques du même réseau de reconnaissance faciale. Crédit : Désidentification du visage en direct dans la vidéo, Oran Gafni et al.

Facebook a découvert la désidentification des personnes dans les vidéos. Attendre, Facebook? Les plateformes sociales ne sont-elles pas souvent critiquées pour les droits à la vie privée ? Pas cette fois, du moins pas dans les couloirs de Facebook AI Research.

Oran Gafni, un membre de l'équipe qui a travaillé sur la protection des visages contre les systèmes de reconnaissance, a posté une vidéo, "De-Identification Video Samples" le 15 octobre. Gafni, un ingénieur de recherche en Facebook AI Research, détient des diplômes en génie électrique de l'Université de Tel-Aviv, sous la direction du Prof. Lior Wolf. La thèse de Gafni portait sur l'édition de visage sémantique en direct en vidéo, en utilisant des autoencodeurs contradictoires profonds.

Leur article discutant de leur travail s'intitule "Live Face De-Identification in Video". Les auteurs sont Gafni et Lior Wolf, avec des affiliations déclarées de Facebook AI Research et de l'Université de Tel-Aviv, et Yaniv Tagman, Recherche sur l'IA sur Facebook.

Khari Johnson dans VentureBeat compris pourquoi la recherche est importante. "Des startups comme D-ID et un certain nombre de travaux antérieurs ont fait de la technologie de désidentification pour les images fixes, mais c'est le premier qui fonctionne en vidéo."

Le savoir-faire de Facebook est dans le domaine de la recherche. Spécifiquement, c'est Facebook AI Research, et le groupe n'a pas de plans, un porte-parole a dit VentureBeat , "pour appliquer la technologie à n'importe quelle partie de la famille d'applications Facebook en ce moment."

Facebook, bien que, pourraient bénéficier de tentatives pour défendre l'anonymat.

Johnson a noté la récente controverse sur les applications de la technologie de reconnaissance faciale. Facebook fait face à une menace de 35 milliards de dollars d'un recours collectif, tel que rapporté par les sites d'information, y compris TechCrunch .

Comment ça marche :L'IA est tout au sujet de la modification automatique de la vidéo. Le procédé mappe une version légèrement déformée sur le visage d'une personne, de sorte qu'il devient difficile pour la technologie de reconnaissance faciale d'identifier une personne.

Johnson a déclaré que leur méthode "associe un autoencodeur contradictoire à un réseau de classificateurs".

Johnson a poursuivi en décrivant clairement ce qui se passait :« L'IA utilise une architecture encodeur-décodeur pour générer à la fois un masque et une image. Pendant la formation, le visage de la personne est déformé puis introduit dans le réseau. Ensuite, le système génère des images déformées et non déformées du visage d'une personne pour une sortie qui peut être intégrée dans la vidéo."

Comment ça marche? Les chercheurs ont essayé de tromper les réseaux de reconnaissance faciale et ils sont apparus confiants d'avoir trouvé une technique significative. "Notre contribution est la seule adaptée à la vidéo, y compris la vidéo en direct, et présente une qualité qui dépasse de loin les méthodes de la littérature. L'approche est à la fois élégante et résolument originale, l'utilisation d'un descripteur de visage existant concaténé à l'espace d'insertion, un masque savant pour l'estompage, un nouveau type de perte de perception pour obtenir l'effet désiré, parmi quelques autres contributions."

Découvrez les chiffres dans le journal, qui sont des exemples des changements d'identité de leur méthode. Les auteurs ont souligné que seul un changement minime de l'image est important pour que la méthode soit compatible avec la vidéo. Ils ont dit que dans leur travail, le changement est mesuré à l'aide de fonctionnalités de niveau bas et moyen et non à l'aide de normes sur les pixels eux-mêmes.

Ils étaient au courant des recherches qui avaient montré que les perturbations d'image causées par des exemples contradictoires déformaient les caractéristiques de niveau intermédiaire "que nous nous efforçons de rester inchangées".

Dans une interview avec VentureBeat , Wolf a déclaré que "l'autoencodeur est tel qu'il essaie de rendre la vie plus difficile pour le réseau de reconnaissance faciale, et c'est en fait une technique générale qui peut également être utilisée si vous voulez générer un moyen de masquer quelqu'un, dire, voix ou comportement en ligne ou tout autre type d'informations identifiables."

La Conférence internationale sur la vision par ordinateur (ICCV) à Séoul, Corée du Sud, est un lieu où les chercheurs de Facebook ont été répertoriés pour rejoindre des experts en vision par ordinateur du monde entier pour discuter des dernières avancées. L'horaire de Séoul aurait la présentation de l'équipe sur le robinet, "Désidentification du visage en direct dans la vidéo."

Le résumé de leur article se lit comme suit :« Nous proposons une méthode de désidentification des visages qui permet une modification vidéo entièrement automatique à des fréquences d'images élevées. L'objectif est de décorréler au maximum l'identité tout en ayant la perception (pose, éclairage, et expression) fixe. Nous y parvenons grâce à une nouvelle architecture de réseau d'encodeur-décodeur à anticipation conditionnée par la représentation de haut niveau de l'image faciale d'une personne. Le réseau est mondial, dans le sens où il n'a pas besoin d'être recyclé pour une vidéo donnée ou pour une identité donnée, et il crée des séquences d'images naturelles avec peu de distorsion dans le temps."

Tyler Lee dans Ubergizmo reconnu à l'œil humain, toute différence entre les photos avant et après pourrait être déroutante, mais les changements étaient suffisants pour embrouiller le système. Lee a déclaré:"Cela ressemble à une sorte de deepfake inversé où il déforme très légèrement le visage de la personne au point où cela peut confondre les systèmes de reconnaissance faciale, mais en même temps conserver suffisamment de l'original pour que vous, en tant qu'humain, saura certainement qui c'est que vous voyez."

© 2019 Réseau Science X