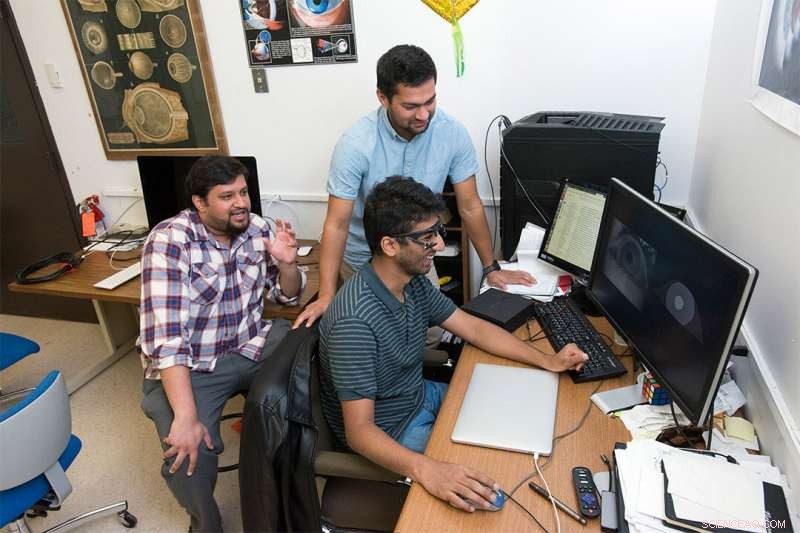

Une équipe de chercheurs du RIT a remporté la première place du défi OpenEDS de Facebook Research, une compétition internationale qui a poussé les chercheurs à développer des solutions d'eye-tracking plus efficaces. Rakshit Kothari de l'Inde (à gauche), Aayush Chaudhary du Népal (avant) et Manoj Acharya du Népal (arrière) sont titulaires d'un doctorat. étudiants qui ont mené le projet. Crédit :A. Sue Weisler

Une équipe de chercheurs du Rochester Institute of Technology a remporté le premier prix d'un concours international organisé par Facebook Research pour développer des solutions de suivi oculaire plus efficaces. L'équipe, dirigé par trois doctorants. étudiants du Chester F. Carlson Center for Imaging Science, a remporté la première place du OpenEDS Challenge axé sur la segmentation sémantique.

Les produits de réalité virtuelle tels que Oculus VR s'appuient sur le suivi oculaire pour créer des expériences immersives. Le suivi oculaire doit être précis, précis et travailler tout le temps, pour chaque personne, dans n'importe quel environnement.

« Actuellement, le suivi oculaire se fait en détectant la pupille et en ajustant un modèle bidimensionnel ou tridimensionnel sur les données, " a déclaré Aayush Chaudhary, un doctorat en sciences de l'imagerie. étudiant népalais et l'un des principaux auteurs de l'article primé. "L'objectif global de l'OpenEDS Challenge était de séparer l'iris, pupille et sclérotique dans les images de l'œil afin que les modèles 2D et 3D puissent être adaptés à un modèle compact."

Pour aider à étendre les applications où le suivi oculaire peut être utilisé, Facebook Research a lancé le défi de créer des modèles informatiques robustes pouvant fonctionner en temps réel. Ils exigeaient que la solution gagnante soit précise, robuste et extrêmement économe en énergie.

« Lorsque nous parlons de suivi oculaire sur un appareil tel que votre téléphone portable, vous avez besoin de modèles petits, qui peut fonctionner en temps réel, " dit Rakshit Kothari, un doctorat en sciences de l'imagerie. étudiant de l'Inde. "Vous devez pouvoir sortir votre téléphone portable et le faire fonctionner tout de suite, sans trop de calcul."

Avec le soutien de leurs conseillers, trois doctorats en sciences de l'imagerie. étudiants - Kothari, Chaudhary, et Manoj Acharya du Népal—ont consacré un mois de leur temps de recherche pour développer la solution. Ils ont couru d'innombrables modèles sur cette période, affinant continuellement leur approche et relevant le défi le dernier jour de la compétition. Le long du chemin, ils ont surmonté plusieurs obstacles imprévus pour construire un modèle pratique.

"Il y a des conditions que nous n'avions jamais anticipées qui peuvent apparaître dans ces images, dont notre modèle devait s'occuper intelligemment, " dit Acharya. " A titre d'exemple, si vous enseigniez à ce modèle comment trouver ces caractéristiques en utilisant des images où les gens ne portent pas de maquillage pour les yeux, et puis soudain quelqu'un arrive avec beaucoup de mascara, cela pourrait complètement le jeter. Vous avez besoin d'un modèle suffisamment intelligent et intelligent pour contourner cela."

Le projet interdisciplinaire nécessitait une collaboration entre les laboratoires et les collèges du RIT. Les trois auteurs principaux ont collaboré avec des co-auteurs dont Nitinraj Nair, un étudiant diplômé en informatique de l'Inde, et Sushil Dangi, un doctorat en sciences de l'imagerie. étudiant népalais. Ils ont travaillé en étroite collaboration avec leurs conseillers :Frederick Wiedman Professeur Jeff Pelz, Professeur adjoint Gabriel Diaz, et le professeur adjoint Christopher Kanan du College of Science, et le professeur Reynold Bailey du Golisano College of Computing and Information Sciences.

Les chercheurs travaillent dans quatre laboratoires du RIT :le Laboratoire de recherche multidisciplinaire sur la vision (MVRL), le laboratoire PerForM (Perception pour le Mouvement), le Laboratoire de Machine et Perception Neuromorphique (kLab) et le Laboratoire d'Infographie et de Perception Appliquée.

Les membres de l'équipe présenteront leur solution à l'atelier OpenEDS 2019 :Eye Tracking for VR and AR à l'International Conference on Computer Vision (ICCV) à Séoul, Corée le 2 novembre.

L'équipe a gagné 5$, 000 et fera don de l'argent du prix à la nouvelle bourse Willem "Bill" Brouwer Endowed Fellowship pour soutenir la recherche des étudiants diplômés du Chester F. Carlson Center for Imaging Science.

Plus d'informations sont disponibles sur le site Facebook Research OpenEDS Challenge.