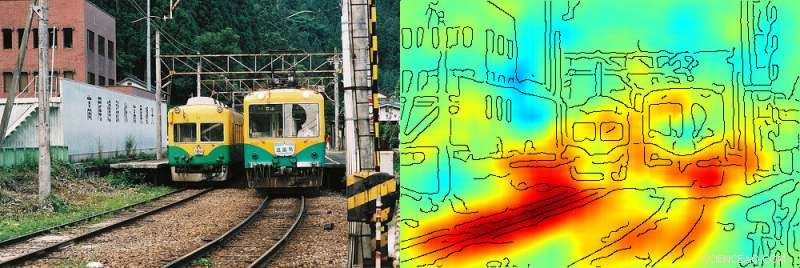

Ici, le système d'IA classe une image comme un train car des voies sont présentes. Crédit :Fraunhofer HHI

L'intelligence artificielle (IA) est déjà bien ancrée dans notre quotidien et conquiert de plus en plus de territoire. Par exemple, les assistants vocaux sont déjà un élément de tous les jours dans les smartphones de nombreuses personnes, voitures et maisons. Les progrès dans le domaine de l'IA reposent principalement sur l'utilisation des réseaux de neurones. Imitant la fonctionnalité du cerveau humain, les réseaux de neurones relient entre eux des unités définies mathématiquement. Mais dans le passé, on ne savait pas exactement comment un réseau de neurones prend des décisions. Chercheurs de l'Institut Fraunhofer pour les télécommunications, Institut Heinrich Hertz, HHI et Technische Universität Berlin ont développé une technologie qui révèle les critères que les systèmes d'IA utilisent pour prendre des décisions. La méthode innovante d'analyse de pertinence spectrale (SpRAy) basée sur la technologie de propagation de la pertinence par couche fournit un premier aperçu de la « boîte noire ».

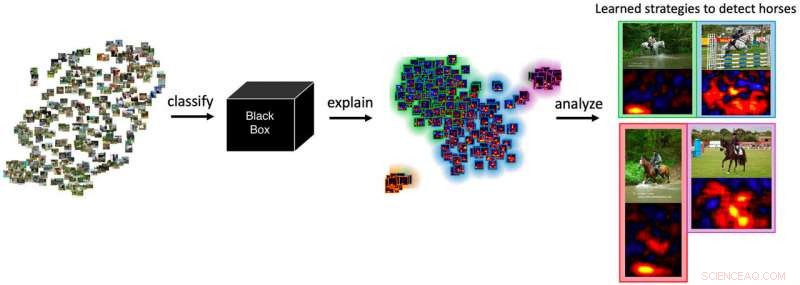

Aujourd'hui, il est presque impossible de trouver un domaine dans lequel l'intelligence artificielle n'est pas pertinente, que ce soit dans la fabrication, publicité ou communication. De nombreuses entreprises utilisent des systèmes d'apprentissage et d'IA en réseau, par exemple pour générer des prévisions de demande précises et pour prédire exactement le comportement des clients. Cette approche peut également être utilisée pour ajuster les processus logistiques régionaux. La santé utilise également des activités d'IA spécifiques, telles que la génération de pronostics sur la base de données structurées. Cela joue par exemple un rôle dans la reconnaissance d'images :les images radiographiques sont entrées dans un système d'IA qui émet ensuite un diagnostic. Une bonne détection du contenu de l'image est également cruciale pour la conduite autonome, où les panneaux de signalisation, des arbres, les piétons et les cyclistes doivent être identifiés avec une parfaite précision. Et c'est là le nœud du problème :les systèmes d'IA doivent fournir des stratégies de résolution de problèmes absolument fiables dans des domaines d'application sensibles tels que les diagnostics médicaux et dans les domaines critiques pour la sécurité. Cependant, dans le passé, la façon dont les systèmes d'IA prennent des décisions n'a pas été tout à fait claire. Par ailleurs, les prédictions dépendent de la qualité des données d'entrée. Chercheurs de l'Institut Fraunhofer pour les télécommunications, Institut Heinrich Hertz, HHI et Technische Universität Berlin ont maintenant développé une technologie, Propagation de pertinence par couche (LRP), ce qui rend les prévisions de l'IA explicables et, ce faisant, révèle des stratégies de résolution de problèmes peu fiables. Un développement ultérieur de la technologie LRP, appelée analyse de pertinence spectrale (SpRAy), identifie et quantifie un large éventail de comportements de prise de décision appris et identifie ainsi les décisions indésirables même dans d'énormes ensembles de données.

IA transparente

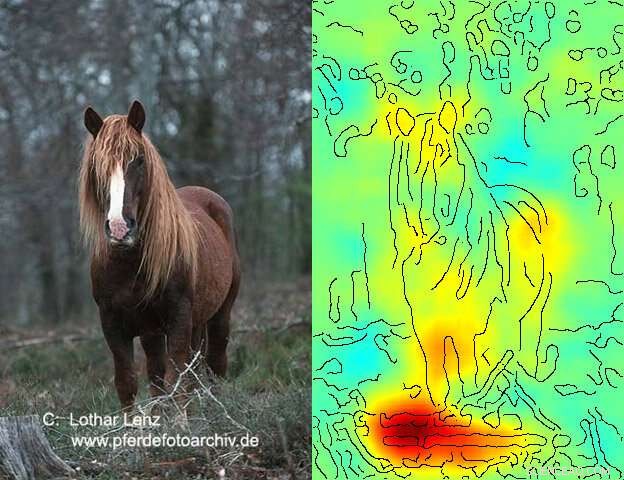

Ici, le système d'IA attribue l'image à la bonne catégorie en fonction de la bannière de copyright. Néanmoins, la stratégie de solution est défectueuse. Crédit :Fraunhofer HHI

En pratique, la technologie identifie les éléments d'entrée individuels qui ont été utilisés pour faire une prédiction. Ainsi, par exemple, lorsqu'une image d'un échantillon de tissu est entrée dans un système d'IA, l'influence de chaque pixel individuel est quantifiée dans les résultats de la classification. En d'autres termes, ainsi que de prédire à quel point le tissu imagé est « maligne » ou « bénigne », le système fournit également des informations sur la base de cette classification. "Non seulement le résultat est censé être correct, la stratégie de solution l'est aussi. Autrefois, Les systèmes d'IA ont été traités comme des boîtes noires. On faisait confiance aux systèmes pour faire les bonnes choses. Avec notre logiciel open source, qui utilise la propagation de pertinence par couche, nous avons réussi à rendre transparent le processus de recherche de solutions des systèmes d'IA, " dit le Dr Wojciech Samek, chef du groupe de recherche "Machine Learning" à Fraunhofer HHI. « Nous utilisons LRP pour visualiser et interpréter les réseaux de neurones et d'autres modèles d'apprentissage automatique. Nous utilisons LRP pour mesurer l'influence de chaque variable d'entrée dans la prédiction globale et analyser les décisions prises par les classificateurs, " ajoute le Dr Klaus-Rob-ert Müller, Professeur d'apprentissage automatique à la TU Berlin.

Stratégies de solution peu fiables

Faire confiance aux résultats des réseaux de neurones signifie nécessairement comprendre leur fonctionnement. Selon les tests de l'équipe de recherche, Les systèmes d'IA n'appliquent pas toujours les meilleures stratégies pour parvenir à une solution. Par exemple, un système d'IA bien connu classe les images en fonction du contexte. Il a attribué des photographies à la catégorie "Navire" lorsqu'une grande quantité d'eau était visible sur l'image. Cela ne résolvait pas la tâche réelle de reconnaître les images de navires, même si dans la majorité des cas il a choisi les bonnes photos. "De nombreux algorithmes d'IA utilisent des stratégies peu fiables et arrivent à des solutions très peu pratiques, " dit Samek, résumer les résultats des enquêtes.

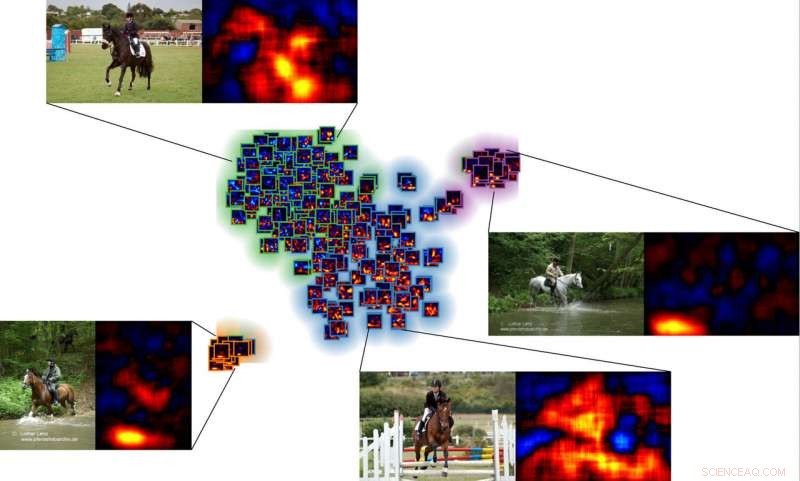

La nouvelle technologie d'analyse de pertinence spectrale rend visible les critères utilisés par les systèmes d'IA lors de la prise de décision. Crédit :Fraunhofer HHI

Regarder les réseaux de neurones penser

La technologie LRP décode la fonctionnalité des réseaux de neurones et découvre quelles caractéristiques sont utilisées, par exemple pour identifier un cheval comme un cheval et non comme un âne ou une vache. Il identifie les informations circulant dans le système à chaque nœud du réseau. Cela permet d'étudier même des réseaux de neurones très profonds.

Les équipes de recherche Fraunhofer HHI et TU Berlin élaborent actuellement de nouveaux algorithmes pour l'investigation d'autres questions afin de rendre les systèmes d'IA encore plus fiables et robustes. Les partenaires du projet ont publié leurs résultats de recherche dans la revue Communication Nature .

La propagation de la pertinence au niveau des calques donne un aperçu de la « boîte noire ». Crédit :Fraunhofer HHI

IA, apprentissage automatique et plus

L'intelligence artificielle s'intéresse au développement de systèmes capables de résoudre indépendamment des problèmes et d'agir de manière analogue aux modèles de pensée et de comportement humains. À l'heure actuelle, les plus grands progrès sont réalisés dans le domaine de l'apprentissage automatique, un sous-domaine de l'IA. L'apprentissage automatique traite des méthodes d'extraction de connaissances à partir des données et des contextes d'apprentissage indépendants contenus dans les données. Les progrès sont le résultat de l'utilisation de réseaux de neurones artificiels basés sur des connexions entre des unités de calcul mathématiques qui imitent en principe la structure neuronale du cerveau humain. Un sous-domaine de l'apprentissage automatique, l'apprentissage en profondeur, couvre une classe de nouvelles procédures qui permettent d'enseigner et de former des réseaux de neurones artificiels complexes. Ces réseaux se composent d'un grand nombre de niveaux qui sont liés les uns aux autres dans des structures à plusieurs couches.