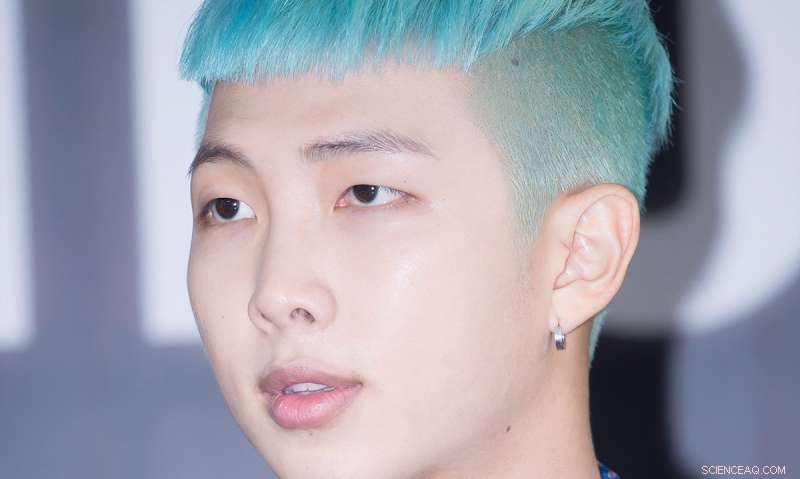

Image de l'ensemble de données PGGAN. Crédit :Karras et al.

Des chercheurs de l'Université d'État de New York en Corée ont récemment exploré de nouvelles façons de détecter à la fois de fausses images de visages créées par des machines et des humains. Dans leur papier, publié dans la bibliothèque numérique ACM, les chercheurs ont utilisé des méthodes d'ensemble pour détecter les images créées par des réseaux antagonistes génératifs (GAN) et ont employé des techniques de prétraitement pour améliorer la détection des images créées par des humains à l'aide de Photoshop.

Au cours des dernières années, des avancées significatives dans le traitement d'images et l'apprentissage automatique ont permis la génération de faux, pourtant très réaliste, images. Cependant, ces images pourraient également être utilisées pour créer de fausses identités, rendre les fake news plus convaincantes, contourner les algorithmes de détection d'images, ou tromper les outils de reconnaissance d'images.

"Les images de faux visages sont un sujet de recherche depuis un certain temps maintenant, mais les études se sont principalement concentrées sur des photos faites par des humains, à l'aide des outils Photoshop, " Shahroz Tariq, l'un des chercheurs qui a mené l'étude a déclaré à Tech Xplore. "Récemment, une étude de Karras et al. ont montré qu'un réseau accusatoire génératif (GAN) pouvait produire des images de visage humain presque réalistes. Les gens pourraient utiliser ces photos avec malveillance, par exemple, pour créer de fausses pièces d'identité sur Internet."

L'objectif de la recherche menée par Tariq et ses collègues était de détecter à la fois de fausses photos de visages générées par ordinateur et par des humains à l'aide de techniques d'apprentissage en profondeur. Pour faire ça, ils ont développé un classificateur de réseau neuronal et l'ont entraîné sur un ensemble de données d'images réelles et fausses.

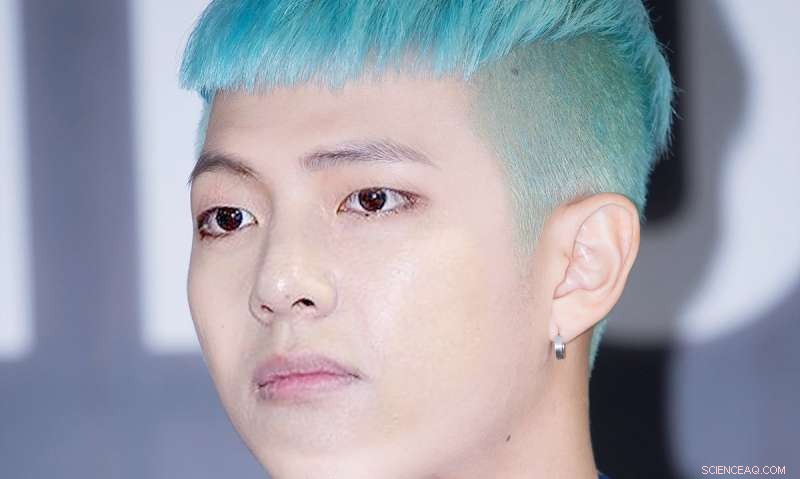

Image de l'ensemble de données CelebA. Crédit :Liu et al.

"Le classificateur de réseau neuronal apprend les caractéristiques discriminantes entre les images réelles et fausses en examinant une énorme base de données d'images fausses et réelles, " dit Tariq.

Plutôt que d'analyser les métadonnées des images, ce classificateur se concentre sur le contenu de l'image. Lors d'essais préliminaires, il a obtenu des résultats remarquables, détectant à la fois les fausses images de visages générées par les GAN et celles créées par l'homme avec une précision de 94 %.

"Même si les images générées par ordinateur semblent très réalistes à l'œil humain, le classificateur de réseau neuronal a pu repérer quelques différences infimes, ce qui lui a permis de classer correctement les images, " a déclaré Tariq. " Nous avons également constaté que les fausses photos créées par des humains à l'aide d'outils Photoshop sont beaucoup plus difficiles à détecter, car il existe de nombreuses variantes possibles."

Image réelle. Crédit :Tariq et al.

Dans le futur, le classificateur développé par Tariq et ses collègues pourrait aider à identifier les fausses images, générés par des GAN ou par des humains à l'aide de logiciels d'édition graphique, comme Photoshop. Les chercheurs envisagent maintenant de développer davantage leur classificateur, l'entraîner sur davantage d'images générées par des machines et des humains.

Image photoshopée. Crédit :Tariq et al.

« Alors que les méthodes de génération d'images synthétiques deviennent de plus en plus sophistiquées, les photos générées avec ces méthodes deviendront plus réalistes et il sera plus difficile pour le classificateur de réseau de neurones de détecter leurs différences, " explique Tariq. " Nous voulons donc continuer à améliorer nos méthodes, pour mieux détecter de telles photos."

© 2018 Réseau Science X