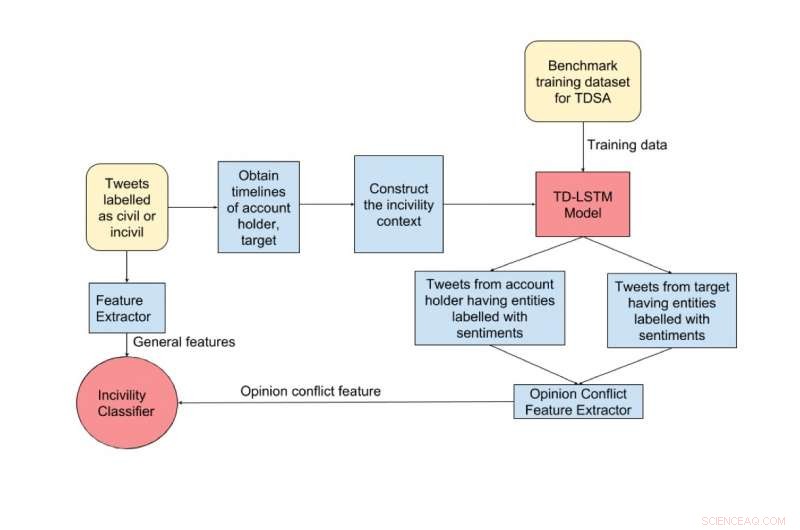

Schéma des étapes de détection d'incivilités. Les blocs de couleur jaune représentent les entrées, les blocs de couleur rouge représentent les classificateurs et les blocs de couleur bleue représentent les étapes intermédiaires. Crédit :Maity et al.

Chercheurs de l'Université Northwestern, Université McGill, et l'Institut indien de technologie de Kharagpur ont récemment développé un modèle de réseau de neurones convolutifs (CNN) au niveau des caractères qui pourrait aider à détecter les messages abusifs sur Twitter. Ce modèle s'est avéré surpasser plusieurs méthodes de base, atteindre une précision de 93,3 pour cent.

Dans les années récentes, les comportements abusifs sur les plateformes en ligne ont augmenté de façon exponentielle, notamment sur Twitter. Les entreprises de médias sociaux recherchent donc de nouvelles méthodes efficaces pour identifier ce comportement afin d'intervenir et d'éviter qu'il ne cause de graves dommages.

"Twitter, qui a été initialement conçu comme une « place de la ville électronique, ' se transforme en un mosh pit, " Animesh Mukherjee, l'un des chercheurs qui a mené l'étude, Raconté Tech Xplore . « Un nombre croissant de cyber-agressions, des cas de cyberintimidation et d'incivilités sont signalés chaque jour, dont beaucoup affectent gravement les utilisateurs. En réalité, c'est l'une des principales raisons pour lesquelles Twitter perd sa base d'abonnés actifs."

Les contenus en ligne peuvent se diffuser rapidement et toucher de très larges publics, ainsi, les cas d'abus en ligne se prolongent souvent pendant de longues périodes avec des effets très néfastes. La ou les victimes, ainsi que d'autres passants sensibles, pourrait finir par lire les mots du délinquant d'innombrables fois avant qu'ils ne disparaissent finalement de Twitter. C'est pourquoi il est important que les plateformes de réseaux sociaux détectent efficacement et rapidement ces contenus, effectuer des interventions opportunes pour le supprimer.

« Nous nous sommes fixés pour objectif de développer un mécanisme capable de détecter automatiquement et rapidement les tweets incivils, avant qu'ils ne puissent causer de graves dommages, " a déclaré Mukherjee. "Nous avons observé que le plus souvent, une victime/cible est attaquée après avoir exprimé des sentiments forts envers certaines entités nommées. Cela nous a conduit à l'idée centrale d'exploiter les conflits d'opinion pour détecter les tweets incivils."

Mukherjee et ses collègues ont réalisé que les messages abusifs sont souvent corrélés à des divergences d'opinion entre le délinquant et la cible, en particulier des opinions sur une personnalité ou une entité publique de renom. Ils ont donc incorporé des informations de sentiment spécifiques à l'entité dans leur modèle CNN, en espérant que cela améliorerait ses performances dans la détection de contenu abusif.

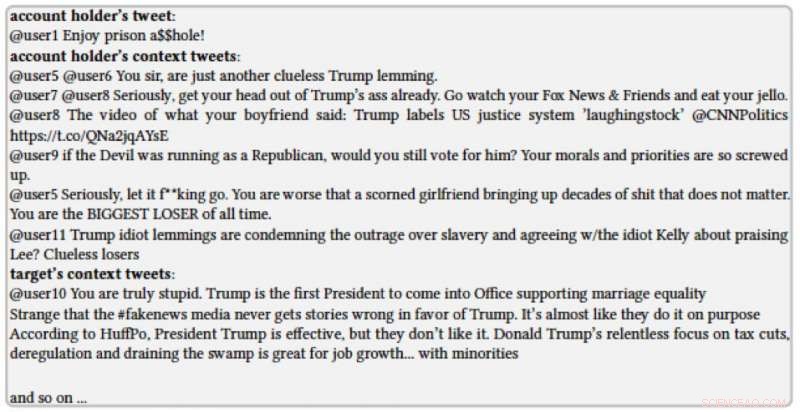

Dans l'exemple de contexte d'incivilité cité ci-dessous, on observe que la cible tweete positivement sur Donald Trump et l'économie américaine. Cependant, le délinquant (titulaire du compte) tweete négativement sur Trump et positivement sur le président Obama. Nous pouvons observer qu'il existe un conflit d'opinion entre la cible et le titulaire du compte car les sentiments exprimés envers l'entité nommée commune Donald Trump sont opposés. En passant par tout l'échange de messages, nous constatons que ce conflit d'opinion mène finalement à un poste incivil. Crédit :Maity et al.

"Le niveau de caractère CNN essaie d'extraire automatiquement des modèles de tweets incivils qui les distinguent des autres tweets, " Pawan Goyal, un autre chercheur qui a mené l'étude, a déclaré Tech Xplore. "Nous avons également choisi d'utiliser l'intégration au niveau des personnages, plutôt que l'incorporation au niveau du mot. Comme les tweets sont généralement petits, ne contient que quelques mots, et ont beaucoup de variations orthographiques, Les modèles au niveau des caractères se sont avérés plus robustes que les modèles au niveau des mots. »

Ce modèle CNN au niveau des caractères a surpassé la meilleure méthode de référence de 4,9%, atteindre une précision de 93,3% dans la détection des tweets incivils. Les chercheurs ont également effectué une analyse post-hoc, examiner de plus près les aspects comportementaux des délinquants et des victimes sur Twitter, dans l'espoir de mieux comprendre les incidents d'incivilités.

Cette analyse a révélé qu'une partie importante des utilisateurs étaient des récidivistes qui avaient harcelé des cibles plus de 10 fois. De la même manière, certaines cibles avaient été harcelées par différents délinquants à plusieurs reprises. "Le résultat le plus intéressant de cette étude est que les conflits d'opinion sont fortement corrélés avec un comportement incivil sur Twitter, ", a déclaré Mukherjee. "Cette fonctionnalité unique liée au modèle neuronal profond basé sur char-CNN peut être très efficace pour identifier les tweets incivils dès le début."

À l'avenir, le modèle CNN conçu par Mukherjee et ses collègues pourrait aider à contrer et à réduire les contenus abusifs sur Twitter. Les chercheurs tentent maintenant de développer des modèles similaires pour détecter les discours de haine sur Twitter, ainsi que sur d'autres plateformes de médias sociaux.

"Pendant ce temps, nous étudions également comment le discours de haine se propage sur les réseaux sociaux, ainsi que d'étudier comment différentes méthodes de lutte contre le discours de haine pourraient aider à lutter contre ce phénomène en ligne vicieux, " a déclaré Mukherjee.

© 2018 Tech Xplore