Les chercheurs de la CMU ont développé une méthode pour identifier automatiquement les mèmes et appliquer des modèles pré-écrits pour ajouter un texte alternatif descriptif, les rendant intelligibles via des technologies d'assistance comme les lecteurs d'écran. Crédit :Université Carnegie Mellon

Les personnes malvoyantes utilisent les réseaux sociaux comme tout le monde, souvent à l'aide d'un logiciel de lecture d'écran. Mais cette technologie échoue lorsqu'elle rencontre des mèmes, qui n'incluent pas de texte alternatif, ou texte alternatif, pour décrire ce qui est représenté dans l'image.

Pour contrer cela, des chercheurs de l'Université Carnegie Mellon ont développé une méthode pour identifier automatiquement les mèmes et appliquer des modèles pré-écrits pour ajouter un texte alternatif descriptif, les rendant intelligibles via les technologies d'assistance existantes.

Les mèmes sont des images qui sont copiées puis superposées avec de légères variations de texte. Ils sont souvent humoristiques et véhiculent une expérience partagée, mais "si tu es aveugle, vous manquez cette partie de la conversation, " a déclaré Cole Gleason, un doctorat étudiant à l'Institut d'Interaction Homme-Machine (HCII.) de la CMU

"Les mèmes peuvent ne pas sembler être le problème le plus important, mais une partie essentielle de l'accessibilité n'est pas de choisir pour les gens ce qui mérite leur attention, " a déclaré Jeff Bigham, professeur agrégé au HCII. "Beaucoup de gens utilisent des mèmes, et donc ils devraient être rendus accessibles.

Les mèmes vivent en grande partie sur les plateformes de médias sociaux qui ont des obstacles à l'ajout de texte alternatif. Twitter, par exemple, permet aux gens d'ajouter du texte alternatif à leurs images, mais cette fonctionnalité n'est pas toujours facile à trouver. Sur 9 millions de tweets examinés par les chercheurs de la CMU, un million d'images incluses et, de celles, seulement 0,1 % incluaient du texte alternatif.

Gleason a déclaré que les techniques de vision par ordinateur de base permettent de décrire les images sous-jacentes à chaque mème, que ce soit une célébrité, un bébé qui pleure, un personnage de dessin animé ou une scène comme un bus renversé dans un gouffre. Des techniques de reconnaissance optique de caractères sont utilisées pour déchiffrer le texte superposé, qui peut changer à chaque itération du mème. Pour chaque type de mème, il suffit de créer un modèle décrivant l'image, et le texte superposé peut être ajouté pour chaque itération de ce mème.

Mais écrire ce que le mème est censé transmettre s'est avéré difficile.

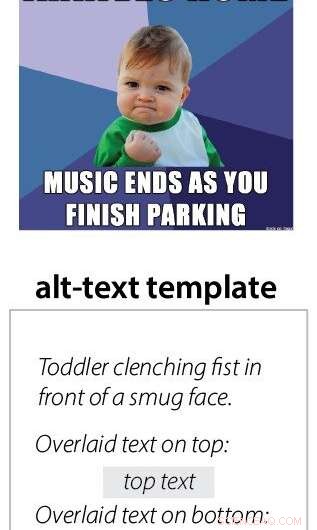

"Cela dépendait du mème si l'humour se traduisait. Certains visuels sont plus nuancés, " a déclaré Gleason. " Et parfois, c'est explicite et vous pouvez simplement le décrire. " Par exemple, le texte alternatif complet pour le soi-disant « enfant à succès » indique « Un tout-petit serrant le poing devant un visage suffisant. Texte superposé en haut :Était un mauvais garçon toute l'année. Texte superposé en bas :J'ai toujours reçu des cadeaux géniaux du Père Noël. »

L'équipe a également créé une plate-forme pour traduire les mèmes en son plutôt qu'en texte. Les utilisateurs recherchent dans une bibliothèque de sons et glissent-déposent des éléments dans un modèle. Ce système a été conçu pour traduire les mèmes existants et transmettre le sentiment à travers de la musique et des effets sonores.

"L'une des raisons pour lesquelles nous avons essayé les mèmes audio était que nous pensions que le texte alternatif tuerait la blague, mais les gens ont quand même préféré le texte parce qu'ils y sont tellement habitués, " a déclaré Gleason.

Le déploiement de la technologie sera un défi. Même s'il était intégré à un site Web générateur de mèmes, ce texte alternatif ne serait pas automatiquement copié lorsque l'image était partagée sur les réseaux sociaux.

"Il faudrait convaincre Twitter d'ajouter une nouvelle fonctionnalité, " a déclaré Gleason. Cela pourrait être quelque chose ajouté à un smartphone personnel, mais il a noté que cela mettrait le fardeau sur l'utilisateur. Les chercheurs de la CMU travaillent actuellement sur des projets connexes, y compris une extension de navigateur pour Twitter qui tente d'ajouter du texte alternatif pour chaque image et pourrait inclure un système de meme. Un autre projet cherche à intégrer du texte alternatif dans les métadonnées des images qui resteraient avec l'image où qu'elle soit publiée.

Ce travail a été présenté plus tôt cette année à la conférence ACCESS à Pittsburgh. Parmi les autres chercheurs impliqués dans le projet, citons Amy Pavel, boursière postdoctorale du HCII, Xingyu Liu, premier cycle de la CMU, Professeur assistant HCII Patrick Carrington, et Lydia Chilton de l'Université Columbia.