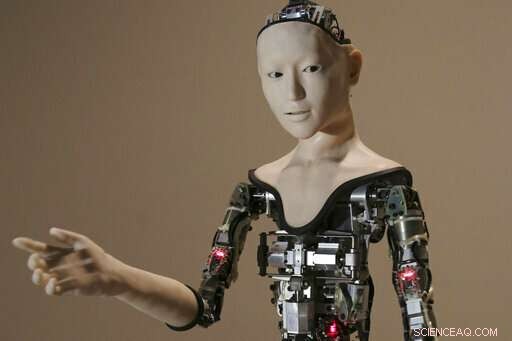

Ce lundi, 1er août La photo d'archive de 2016 montre le robot humanoïde "Alter" exposé au Musée national des sciences émergentes et de l'innovation à Tokyo. Comprendre l'humour est peut-être l'une des dernières choses qui séparent les humains de machines toujours plus intelligentes, disent les informaticiens et les linguistes. (Photo AP/Koji Sasahara)

Un robot entre dans un bar. Ça fait CLANG.

Alexa et Siri peuvent raconter des blagues extraites d'une base de données d'humour, mais ils ne les comprennent pas.

Les linguistes et les informaticiens disent que c'est quelque chose à considérer le jour du poisson d'avril :l'humour est ce qui rend les humains spéciaux. Quand les gens essaient d'apprendre aux machines ce qui est drôle, les résultats sont parfois risibles mais pas de la manière prévue.

"L'intelligence artificielle n'aura jamais de blagues comme les humains, " a déclaré Kiki Hempelmann, un linguiste informaticien qui étudie l'humour à la Texas A&M University-Commerce. « En eux-mêmes, ils n'ont pas besoin d'humour. Ils manquent complètement le contexte."

Et quand il s'agit d'humour, les personnes qui l'étudient - parfois jusqu'à ce que tout rire en soit vaincu - disent que le contexte est la clé. Même les linguistes experts ont du mal à expliquer l'humour, dit Tristan Miller, informaticien et linguiste à l'Université de technologie de Darmstadt en Allemagne.

"Le langage créatif - et l'humour en particulier - est l'un des domaines les plus difficiles à appréhender pour l'intelligence informatique, " dit Miller, qui en a analysé plus de 10, 000 jeux de mots et j'ai appelé ça de la torture. « C'est parce qu'il repose beaucoup sur les connaissances du monde réel – les connaissances de base et les connaissances de bon sens. Un ordinateur n'a pas ces expériences du monde réel sur lesquelles s'appuyer. Il ne sait que ce que vous lui dites et de quoi il s'inspire. »

Allison Bishop, un informaticien de l'Université de Columbia qui interprète également des comédies debout, ledit apprentissage informatique recherche des modèles, mais la comédie se nourrit de choses proches d'un motif et s'écartant un peu pour être drôle et énervé.

Humour, elle a dit, « doit être suffisamment cohérent et suffisamment surprenant. »

Pour les comédiens, c'est la sécurité de l'emploi. Bishop a déclaré que ses parents étaient heureux lorsque son frère est devenu scénariste de comédie à temps plein, car cela signifiait qu'il ne serait pas remplacé par une machine.

"J'aime croire qu'il y a quelque chose de très naturellement humain dans ce qui rend quelque chose de drôle, ", a déclaré l'évêque.

Heather Knight, informaticienne de l'Oregon State University, a créé le robot de comédie Ginger pour l'aider à concevoir des machines qui interagissent mieux avec les humains et surtout répondent aux humains. Elle a dit qu'il s'avère que les gens apprécient le plus l'humour effacé d'un robot.

Gingembre, qui utilise des blagues et des histoires écrites par des humains, parle un peu de Shakespeare et des machines, demander, "Si tu me piques dans ma batterie, est-ce que je ne saigne pas de liquide alcalin ?" dans une référence à "Le marchand de Venise".

L'humour et l'intelligence artificielle sont un domaine en pleine croissance pour les universitaires.

En ce lundi, 18 juin photo d'archive 2018, Dr Noam Slonim, chercheur principal, se tient avec l'IBM Project Debater avant un débat entre l'ordinateur et deux humains à San Francisco. Slonim a mis de l'humour dans la programmation, en pensant qu'une seule ligne de temps en temps pourrait aider dans un débat. Mais dans les premiers tests internes, il s'est retourné contre lui lorsque le système a fait une remarque humoristique à un moment et de manière inappropriée. "Nous savons que l'humour, du moins la bonne humeur, repose sur la nuance et le timing, " a déclaré Slonim. " Et ceux-ci sont très difficiles à déchiffrer par un système automatique. " (AP Photo/Eric Risberg)

Certains ordinateurs peuvent générer et comprendre des jeux de mots - l'humour le plus basique - sans l'aide des humains, car les jeux de mots sont basés sur des significations différentes de mots à consonance similaire. Mais ils tombent après ça, a déclaré Julia Rayz, informaticienne de l'Université Purdue.

"Ils les obtiennent - en quelque sorte, " Rayz a dit. " Même si nous regardons les jeux de mots, la plupart des jeux de mots nécessitent d'énormes quantités d'arrière-plan."

Toujours, avec des jeux de mots, il y a quelque chose de mathématique que les ordinateurs peuvent saisir, dit l'évêque.

Rayz a passé 15 ans à essayer de faire comprendre l'humour aux ordinateurs, et parfois les résultats étaient, bien, ridicule. Elle se souvint d'une fois où elle avait donné à l'ordinateur deux groupes de phrases différents. Certaines étaient des blagues. Certains ne l'étaient pas. L'ordinateur a classé quelque chose comme une blague que les gens pensaient que ce n'était pas une blague. Quand Rayz a demandé à l'ordinateur pourquoi il pensait que c'était une blague, sa réponse avait du sens techniquement. Mais le matériel n'était toujours pas drôle, ni mémorable, elle a dit.

IBM a créé une intelligence artificielle qui bat les adversaires aux échecs et "Jeopardy!" Sa dernière tentative, Débatteur de projet , est plus difficile car il est basé sur le langage et vise à gagner des arguments structurés avec les gens, a déclaré le chercheur principal Noam Slonim, un ancien scénariste de comédie pour une version israélienne "Saturday Night Live".

Slonim a mis de l'humour dans la programmation, en pensant qu'un one-liner occasionnel pourrait aider dans un débat. Mais cela s'est retourné contre lui lors des premiers tests lorsque le système a fait des blagues au mauvais moment ou de la mauvaise manière. Maintenant, Project Debater se limite à une tentative d'humour par débat, et cet humour est souvent effacé.

"Nous savons que l'humour, du moins la bonne humeur, repose sur la nuance et le timing, " dit Slonim. " Et ceux-ci sont très difficiles à déchiffrer par un système automatique. "

C'est pourquoi l'humour peut être la clé des futurs tests de Turing, le test ultime de l'intelligence artificielle, qui est de voir si un évaluateur indépendant peut dire s'il interagit avec une personne ou un ordinateur, dit Slonim.

Il y a toujours « un écart très important entre ce que les machines peuvent faire et ce que font les humains, " tant dans le langage que dans l'humour, dit Slonim.

Il y a de bonnes raisons pour que l'intelligence artificielle essaie d'apprendre à avoir de l'humour, a déclaré Miller de l'Université de Darmstadt. Cela rend les machines plus faciles à comprendre, surtout si vous pouvez leur faire comprendre le sarcasme. Cela peut également aider avec les traductions automatisées de différentes langues, il a dit.

Hempelmann de Texas A&M n'est pas sûr que ce soit une bonne idée.

"Enseigner l'humour aux systèmes d'IA est dangereux car ils peuvent le trouver là où il ne l'est pas et ils peuvent l'utiliser là où c'est inapproprié, " Hempelmann a déclaré. " Peut-être qu'une mauvaise IA commencera à tuer des gens parce qu'elle pense que c'est drôle. "

Le comédien et informaticien Bishop a une blague sur l'intelligence artificielle :elle dit qu'elle est d'accord avec tous les experts qui nous avertissent qu'un jour l'IA dépassera l'intelligence humaine.

"Je ne pense pas que ce soit parce que l'IA devient plus intelligente, " L'évêque plaisante, puis elle ajoute :" Si l'IA obtient cela, Je pense que nous avons un problème."

© 2019 La Presse Associée. Tous les droits sont réservés.