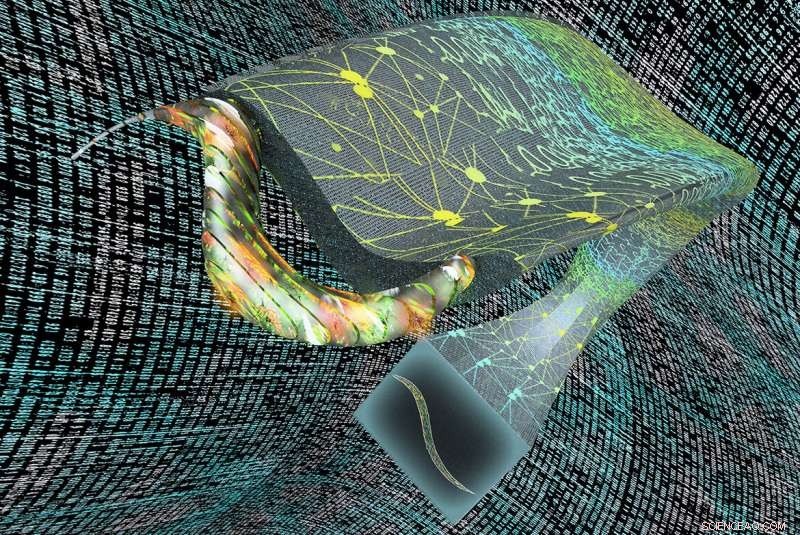

L'illustration représente Deep-Z, un cadre basé sur l'intelligence artificielle qui peut refocaliser numériquement une image de microscope à fluorescence 2D (en bas) pour produire des tranches 3D (à gauche). Crédit :Ozcan Lab/UCLA

Une équipe de recherche de l'UCLA a mis au point une technique qui étend les capacités de la microscopie à fluorescence, qui permet aux scientifiques d'étiqueter avec précision des parties de cellules et de tissus vivants avec des colorants qui brillent sous un éclairage spécial. Les chercheurs utilisent l'intelligence artificielle pour transformer des images bidimensionnelles en piles de tranches virtuelles tridimensionnelles montrant l'activité à l'intérieur des organismes.

Dans une étude publiée dans Méthodes naturelles , les scientifiques ont également signalé que leur cadre, appelé "Deep-Z, " a pu corriger des erreurs ou des aberrations dans les images, comme lorsqu'un échantillon est incliné ou courbé. Plus loin, ils ont démontré que le système pouvait prendre des images 2D d'un type de microscope et créer virtuellement des images 3D de l'échantillon comme si elles étaient obtenues par un autre, microscope plus avancé.

« Il s'agit d'une nouvelle méthode très puissante qui est activée par l'apprentissage en profondeur pour effectuer une imagerie 3D de spécimens vivants, avec le moins d'exposition à la lumière, qui peut être toxique pour les échantillons, " a déclaré l'auteur principal Aydogan Ozcan, Professeur de génie électrique et informatique de l'UCLA et directeur associé du California NanoSystems Institute à l'UCLA.

En plus d'épargner aux spécimens des doses de lumière potentiellement dommageables, ce système pourrait offrir aux biologistes et chercheurs en sciences de la vie un nouvel outil d'imagerie 3D plus simple, plus rapide et beaucoup moins cher que les méthodes actuelles. La possibilité de corriger les aberrations peut permettre aux scientifiques qui étudient des organismes vivants de collecter des données à partir d'images qui seraient autrement inutilisables. Les enquêteurs pourraient également avoir un accès virtuel à des équipements coûteux et compliqués.

Cette recherche s'appuie sur une technique antérieure développée par Ozcan et ses collègues qui leur a permis de restituer des images de microscope à fluorescence 2D en super-résolution. Les deux techniques font progresser la microscopie en s'appuyant sur l'apprentissage en profondeur, en utilisant des données pour « entraîner » un réseau de neurones, un système informatique inspiré du cerveau humain.

Deep-Z a été enseigné en utilisant des images expérimentales d'un microscope à fluorescence à balayage, qui prend des photos focalisées à plusieurs profondeurs pour obtenir une imagerie 3D des échantillons. Dans des milliers de courses d'entraînement, le réseau de neurones a appris à prendre une image 2D et à déduire des coupes 3D précises à différentes profondeurs dans un échantillon. Puis, le framework a été testé à l'aveugle - nourri d'images qui ne faisaient pas partie de sa formation, avec les images virtuelles comparées aux coupes 3D réelles obtenues à partir d'un microscope à balayage, offrant un excellent match.

Ozcan et ses collègues ont appliqué Deep-Z aux images de C. elegans, un ver rond qui est un modèle courant en neurosciences en raison de son système nerveux simple et bien compris. Conversion d'un film 2D d'un ver en 3D, image par image, les chercheurs ont pu suivre l'activité de neurones individuels dans le corps du ver. Et à partir d'une ou deux images 2D de C. elegans prises à différentes profondeurs, Deep-Z a produit des images virtuelles en 3D qui ont permis à l'équipe d'identifier des neurones individuels dans le ver, correspondant à la sortie 3D d'un microscope à balayage, sauf avec une exposition beaucoup moins lumineuse à l'organisme vivant.

Les chercheurs ont également découvert que Deep-Z pouvait produire des images 3D à partir de surfaces 2D où les échantillons étaient inclinés ou incurvés, même si le réseau neuronal n'était formé qu'avec des tranches 3D parfaitement parallèles à la surface de l'échantillon.

"Cette fonctionnalité était en fait très surprenante, " dit Yichen Wu, un étudiant diplômé de l'UCLA qui est co-premier auteur de la publication. "Avec ça, vous pouvez voir à travers la courbure ou toute autre topologie complexe qui est très difficile à imager."

Dans d'autres expériences, Deep-Z a été entraîné avec des images provenant de deux types de microscopes à fluorescence :grand champ, qui expose l'ensemble de l'échantillon à une source lumineuse ; et confocale, qui utilise un laser pour numériser un échantillon pièce par pièce. Ozcan et son équipe ont montré que leur cadre pouvait ensuite utiliser des images d'échantillons au microscope à grand champ en 2D pour produire des images en 3D presque identiques à celles prises avec un microscope confocal.

Cette conversion est précieuse car le microscope confocal crée des images plus nettes, avec plus de contraste, par rapport au grand champ. D'autre part, le microscope à grand champ capture des images à moindre coût et avec moins d'exigences techniques.

"Il s'agit d'une plate-forme généralement applicable à différentes paires de microscopes, pas seulement la conversion grand champ en confocal, " a déclaré le co-premier auteur Yair Rivenson, Professeur adjoint adjoint à l'UCLA en génie électrique et informatique. "Chaque microscope a ses propres avantages et inconvénients. Avec ce cadre, vous pouvez tirer le meilleur parti des deux mondes en utilisant l'IA pour connecter numériquement différents types de microscopes."

Les autres auteurs sont les étudiants diplômés Hongda Wang et Yilin Luo, stagiaire postdoctoral Eyal Ben-David et Laurent Bentolila, directeur scientifique du Laboratoire avancé de microscopie et de spectroscopie lumineuse du California NanoSystems Institute, l'ensemble de l'UCLA ; et Christian Pritz de l'Université hébraïque de Jérusalem en Israël.