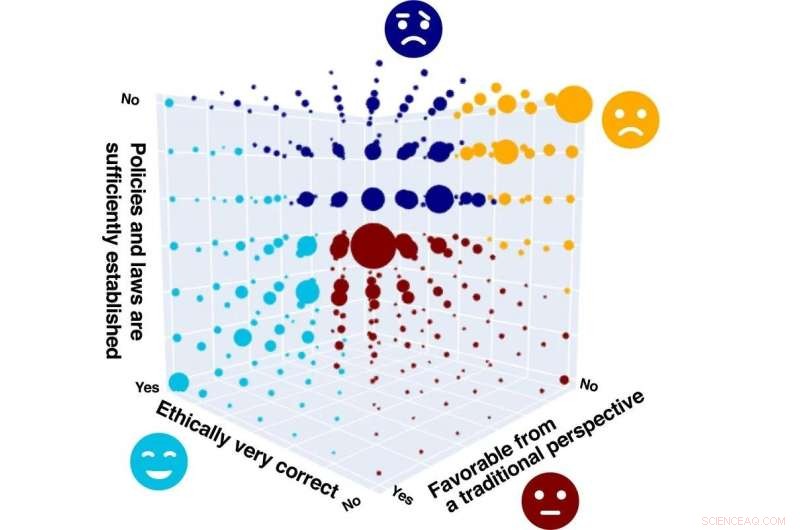

Les réponses des répondants au Japon, aux États-Unis et en Allemagne ont été séparées en réponses éthiques, juridiques et traditionnelles. Au moyen de la segmentation, les réponses peuvent être codées par couleur selon que la réponse du répondant était positive (bleu clair), négative (orange), préoccupée par les questions juridiques (marine) ou non préoccupée par les questions juridiques (cramoisi). Crédit :Ikkatai et al./Kavli IPMU

Selon une nouvelle étude publiée dans AI and Ethics, les Japonais, les États-Unis et l'Allemagne expriment des préoccupations différentes concernant l'utilisation de l'intelligence artificielle (IA) dans les divertissements, les services d'achat ou pour aider à trouver des criminels. .

Selon l'étude, les Japonais ont tendance à se préoccuper davantage de l'IA utilisée pour lutter contre le crime, tandis que les Allemands et les Américains ont tendance à se préoccuper davantage des aspects éthiques et sociaux de l'utilisation de l'IA dans le divertissement.

"Nous avons constaté qu'il existe une différence dans les niveaux de compréhension de l'IA et de l'ELSI [questions éthiques, juridiques et sociales] entre les pays. Je pense qu'il deviendra important de mener des discussions approfondies sur les questions juridiques et politiques entourant l'IA", a d'abord déclaré auteur et professeur agrégé de l'Université de Kanazawa Yuko Ikkatai.

L'IA est actuellement utilisée dans un large éventail de domaines, ce qui a suscité des attitudes positives et négatives dans le grand public. Les politiques d'éthique diffèrent d'un pays à l'autre, comme au Japon où les directives mettent l'accent sur la réglementation de l'IA et la diminution des préoccupations des gens, tandis qu'aux États-Unis, elles soulignent la nécessité de maximiser les avantages sociaux de l'IA et mentionnent les risques à long terme, tandis qu'en Europe, les directives mettent l'accent sur les droits et responsabilités des personnes.

Une équipe de recherche dirigée par le professeur Hiromi Yokoyama, Ikkatai, de l'Institut Kavli pour la physique et les mathématiques de l'univers (Kavli IPMU), et le professeur adjoint Tilman Hartwig de l'Institut de physique de l'intelligence de l'Université de Tokyo, ont remarqué les attitudes éthiques envers l'IA, un outil universel et avancé. technologie, variait d'un pays à l'autre. Les chercheurs affirment qu'il sera de plus en plus important de reconnaître les attitudes du public à l'égard de l'IA dans différents pays avant de déployer de nouvelles technologies d'IA.

Leur étude consistait à mener une enquête en ligne au Japon, aux États-Unis et en Allemagne, demandant aux répondants d'examiner quatre scénarios d'IA différents et de répondre à trois questions sur chacun d'eux, en tenant compte des questions éthiques, juridiques et sociales (ELSI) . Le premier scénario impliquait l'utilisation de l'IA pour les chanteurs générés par l'IA, le deuxième scénario, les achats des clients de l'IA, le troisième, les armes autonomes de l'IA et enfin les prédictions d'activités criminelles par l'IA. Environ 1 000 personnes interrogées dans chaque pays ont été choisies, reflétant la population de leur propre pays en termes d'âge, de sexe et de lieu.

Après avoir analysé leurs résultats, les chercheurs ont pu séparer les réponses en quatre groupes :les personnes ayant des opinions optimistes, les personnes ayant des opinions négatives, les personnes préoccupées par les questions juridiques et celles qui ne se préoccupent pas des questions juridiques. L'équipe l'a nommé le segment AI et ELSI.

Les chercheurs avaient précédemment développé une métrique visuelle octogonale, analogue à un système de notation, qui pourrait être utile aux chercheurs en IA qui souhaitaient savoir comment leur travail pourrait être perçu par le public. Le développement du segment IA et ELSI s'explique par le fait que les chercheurs ont constaté que la métrique visuelle octogonale était limitée en termes de polyvalence lorsqu'elle était appliquée à de nouvelles technologies autres que l'IA.

Dans l'étude la plus récente de l'équipe, ils ont constaté que, dans l'ensemble, plus le répondant était âgé, plus il était préoccupé par les problèmes d'IA et d'ELSI, tandis que les répondants plus familiers avec l'IA ont déclaré qu'ils étaient plus préoccupés par les problèmes juridiques.

En ce qui concerne chaque scénario, les répondants allemands et américains étaient les plus préoccupés par les problèmes éthiques et sociaux concernant les chanteurs générés par l'IA.

Concernant l'utilisation de l'IA à des fins d'achat, les répondants allemands étaient plus préoccupés par les questions éthiques, tandis que les répondants japonais étaient plus préoccupés par les problèmes juridiques.

En ce qui concerne les armes autonomes IA, les répondants japonais et allemands étaient les plus préoccupés par les questions éthiques, et les répondants japonais étaient également les plus préoccupés par les problèmes sociaux et juridiques.

Enfin, en ce qui concerne l'utilisation de l'IA pour capturer des criminels, les répondants américains étaient plus préoccupés par les questions éthiques, sociales et juridiques.

"C'est excitant que nous puissions segmenter les réponses si clairement en quatre groupes, et la caractéristique la plus distinctive est la perception des problèmes juridiques liés à l'IA. Ceci est robuste parmi les trois pays et montre que la communication sur les lois et les politiques liées à l'IA est très importante ", a déclaré Hartwig.

Les détails de leur étude ont été publiés dans AI and Ethics le 1er septembre. + Explorer plus loin